|

THÈSE

En vue de l'obtention du

|

DOCTORAT DE L'UNIVERSITÉ DE TOULOUSE

Délivré par

Université Toulouse 1 Capitole (UT1 Capitole)

Discipline ou

spécialité

INFORMATIQUE

Présenté et soutenue par :

Christian BELBÈZE

le 5 avril 2012

Titre :

Agrégats de mots sémantiquement

cohérents issus d'un grand graphe de terrain

Ecole doctorale :

Mathématiques Informatique

Télécommunications de Toulouse (MITT)

Unité de recherche :

Institut de Recherche en Informatique de Toulouse (IRIT)

Directeur(s) de Thèse :

Mme Chantal Soulé-Dupuy, Professeur, Directrice des

recherches, Univ. Toulouse 1 Capitole

M. Max Chevalier, Maître de

Conférences, Co-encadrant, Univ. Toulouse 3 Paul Sabatier

Rapporteurs :

Mme Thérèse Libourel, Professeur des

Universités, Univ. Montpellier 2 - Montpellier

Mme Christine Verdier,

Professeur des Universités, Univ. Joseph Fourier - Grenoble

Examinateurs :

M. Claude Chrisment, Professeur des Universités, Univ.

Toulouse 3 Paul Sabatier

Mme Frédérique Laforest, Professeur

des Universités, Univ. Jean Monnet - Saint Etienne

2

Remerciements

Je remercie M. Claude Chrisment pour m'avoir accueilli au sein de

l'équipe SIG de l'IRIT.

Je suis reconnaissant à Mme Thérèse

Libourel, Professeur à l'Université Montpellier 2 et à Mme

Christine Verdier, Professeur à l'Université Joseph Fourier

à Grenoble d'avoir accepté d'être rapporteurs de ce

mémoire, de leurs observations qui ont permis d'améliorer ce

rapport de thèse ainsi que de l'honneur qu'elles me font en participant

au jury de thèse.

Je remercie M. Claude Chrisment, Professeur à

l'Université Toulouse 3 Paul Sabatier et Mme Frédérique

Laforest, Professeur à l'Université Jean Monnet à

Saint-Etienne de m'honorer de leur présence en tant qu'examinateurs

à ce jury.

Toute ma gratitude va à Mme Chantal Soulé-Dupuy,

Professeur à l'Université des Sciences Sociales Toulouse 1, pour

avoir accepté d'être mon directeur de recherche me donnant ainsi

une chance rare.

Je remercie également M. Max Chevalier, Maître de

Conférences à l'Université Toulouse 3 Paul Sabatier, pour

sa disponibilité, pour toute l'aide qu'il m'a prodiguée ainsi que

pour sa participation à ce jury.

D'autre-part, je voudrais saluer l'intérêt que M.

Matthieu Latapy, Directeur de Recherche au CNRS affecté au LIP6, a bien

voulu porter à mon travail avec une généreuse

disponibilité et remercier Jeremy Ozog et Claude Flottes pour leur aide

en mathématiques.

J'ai aussi une pensée pour mes « cobayes »

Internautes : Annie, Marie, Jean, Yasmina, Lou, Paul, Guillaume, Céline

et Georges qui sont à l'origine de ce travail.

Je me dois enfin de remercier plus particulièrement ma

Directrice de Recherche Chantal Soulé Dupuy et ma femme Sylvie Flottes.

Sans leurs qualités de coeur, leur intelligence, leur incroyable

patience et enfin leur ancrage dans une réalité qui parfois

m'échappe, rien de tout ceci n'aurait été possible.

Je vais avoir 53 ans dans quelques semaines. Cette

thèse est aussi le résultat de toutes les rencontres et de toutes

les expériences qui m'ont construit durant ces années. Il y a

donc tant de personnes à remercier pour avoir contribué à

l'accomplissement de ces travaux que je ne tente pas d'en faire une liste

exhaustive. Mais que tous ceux qui m'ont respecté, encouragé,

écouté, aidé et (ré) éduqué sachent

que je les remercie sincèrement.

3

Résumé

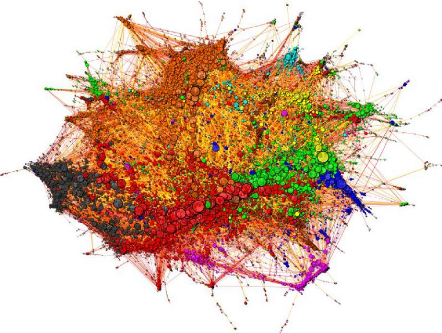

L'observation d'internautes en situation de recherche

d'informations a permis de mettre en évidence un besoin, celui

d'échanges immédiats. Une telle relation instantanée peut,

dans le cadre qui nous occupe, revêtir différents aspects et

notamment l'aspect coopératif permettant à un internaute de

bénéficier, à un instant critique, des recherches des

autres utilisateurs par des recommandations dynamiques. Selon le principe des

réseaux sociaux, une communauté est un ensemble d'internautes

pouvant tirer parti de liens, prédéfinis ou non, sur la base de

centres d'intérêts communs, de pratiques communes...

Repérer ces liens dynamiquement et provoquer des rencontres entre

internautes nous a semblé être un vrai défi à

relever.

Il s'agit donc de faire en sorte que se créent

dynamiquement des communautés d'internautes à partir de

recherches en cours via des moteurs de recherche (fichiers de log par exemple).

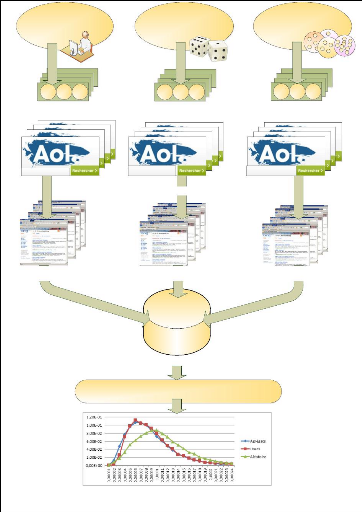

Le processus de génération dynamique de communautés repose

en grande partie sur l'extraction des thèmes de recherche (centres

d'intérêts) des internautes présents sur le réseau

à un instant donné (ou pendant un laps de temps donné).

Les thèmes de recherche permettant la connexion entre internautes

constituent le noyau de la communauté dynamique. L'ensemble des

communautés se présente alors comme un graphe de termes (extraits

des thèmes) s'apparentant à un grand graphe de terrain dans

lequel les connexions représentent les cooccurrences.

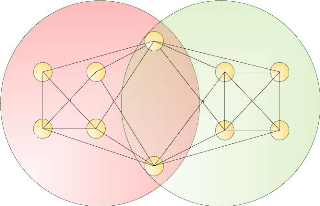

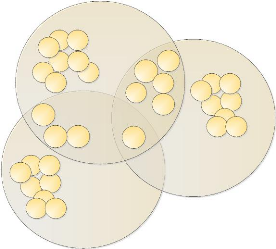

Dans cette thèse, nous proposons une démarche de

création et de validation du graphe communautaire. Cette démarche

consiste à agréger les noeuds du graphe pour que chaque

agrégat présente la plus forte cohérence sémantique

possible. Les problématiques suivantes doivent être

résolues:

- créer des agrégats de mots pouvant contenir des

parties en recouvrement (une orthographe peut appartenir à plusieurs

thématiques) ;

- choisir ou définir une technique de regroupement

garantissant une forte cohérence sémantique ; -

caractériser les agrégats pour comprendre les différences

de cohérence sémantique ;

- proposer des techniques de validation de la cohérence

sémantique des agrégats.

Dans une première partie constituant un état de

l'art, nous étudions de nombreuses méthodes de création de

communautés au sein des graphes. Cependant aucune ne satisfait

totalement à l'ensemble des critères nécessaires.

Dans une deuxième partie nous présentons notre

contribution. Celle-ci est constituée de plusieurs méthodes

d'agrégation et de plusieurs méthodes de validation

sémantiques.

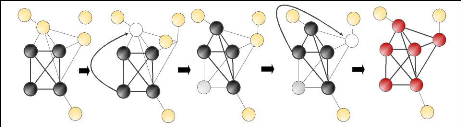

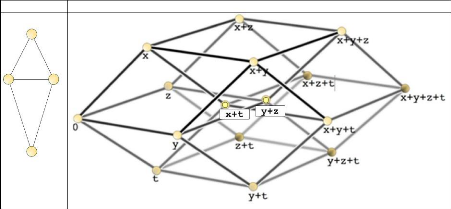

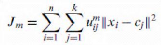

Nous proposons quatre méthodes d'agrégation :

Détection de Cliques (agglomération de clique), Rigidification

Simple (recherche de points de rupture dans le graphe), Rigidification

Régulée (recherche de points de rupture en s'appuyant sur

l'étude de populations spécifiques, mots vides et

monosémique) et une Méthode d'Enrichissement d'Agrégat par

Gravité (la méthode détermine un coefficient d'attraction

pour chaque mot vers chaque agrégat).

Nous proposons, ensuite, trois méthodes de validation

de la cohérence sémantique des agrégats : la

Méthode de Coefficient de Validation Sémantique Comparé

(estimation de la valeur sémantique des agrégats par comparaison

du comportement de moteur de recherche sur Internet en utilisant

différents jeux de test et les agrégats), la Méthode

Trec-Eval par enrichissement de requête (les agrégats sont

utilisé pour préciser des requêtes utilisateurs) et une

Méthode de Comparaison de Cohérence de Documents Retournés

(comparaison de la cohérence sémantique des documents

retournés par des requêtes provenant de jeux de test

spécifiques et des agrégats). Nous utiliserons aussi des

validations manuelles réalisées par des experts du domaine des

espaces sémantiques manipulés incluant la comparaison avec

d'autres méthodes.

Les différentes propositions et méthodes

d'expérimentations apportent la preuve de l'importance de

pondérer les noeuds et les liaisons, ainsi que de diriger les graphes.

La limitation de la taille des agrégats de mots est aussi un

élément majeur de leur cohérence sémantique. Les

différentes méthodes de regroupement peuvent encore

évoluer. La combinaison de plusieurs types de liaisons au sein d'un

même graphe, par exemple, permettrait d'affiner le contenu des

agrégats.

Mots-clés

Graphes, Agrégats de termes, Communautés et

communautés d'utilisateurs, Graphes de terrain, Petits

Mondes.

4

Summary

The observation of internet users in a situation of

information research has helped to highlight a general need to immediate

exchange. The immediacy of the exchanges may take different aspects and in

particular the fact for a surfer, at a given moment, to be able to benefit from

the research of other surfers by dynamic recommendation. According to the

principle of social networks, a community is a set of Internet surfers who can

take advantage of links, predefined or not, on the basis common interests,

common practices... Identifying these links dynamically and causing meetings

between Surfers seemed to be a true challenge.

Then we have to dynamically create communities of internet

users from ongoing research via search engines (log files for example). The

process of dynamic generation of communities is largely based on the extraction

of the research themes (centers of interests) of Internet users present on the

network at a given moment (or during a given period of time). The themes of

research allowing the connection between Internet users constitute the core of

the Community dynamic. The community is then presented as a Large complex

network graph of words (extracts of themes) in which the connections represent

the cooccurrences.

In this thesis, we propose an approach for creation and

validation of the graph community. This approach involves the aggregation of

the nodes of the graph so that each aggregate has the highest semantics

consistency possible. The following issues must be resolved:

- creating clusters of words that can contain overlap (a spelling

may belong to several thematic);

- choosing or defining a grouping technique that guarantees a

high degree of semantics consistency; - characterizing the aggregates to

understand the differences of semantics consistency;

- proposing techniques to validate semantics consistency of

aggregates.

In a first part constituting a state of the art, we are

studying many methods of creating communities in the graphs. However no one

fulfills all of the necessary criteria.

In a second part we present our contribution. The latter is

constituted of several methods of aggregation and several methods of semantic

validations.

We offer 4 methods of aggregation: cliques Detection

(agglomeration of clique), Simple Ratification (search for points of rupture in

the graph), Regulated Regasification (search for points of rupture in relying

on the study of specific populations, empty words and monosemic) and a method

of Enrichment of Aggregate by Gravity (the method determines a coefficient of

attraction for each word toward each aggregate).

We then propose three methods to validate the semantic

consistency of aggregates : Method of Compared Coefficient of Semantics

Validation (estimate of the value semantics of aggregates by comparing the

behavior of search engine on the Internet by using different test sets and

aggregates), Trec-Eval method for requests enrichment (the aggregates are used

to specify user requests) and a method of consistency comparison of documents

returned (comparison of the semantics consistency of documents returned by

queries from test specific sets and aggregate ). We will also use the manual

validation by experts in the field of semantic spaces handled including

comparison with other methods.

The various proposals and methods of experiments provide

evidence of the importance of weighted nodes and links, as well as to direct

the graphs. Limiting the size of the aggregates of words is also a major

element of semantics consistency. The different clustering methods can still

evolve. The combination of several types of links in a graph, for example,

would refine the content of the aggregates.

Key-words

Graphs, Term aggregates, Communities and user communities,

Complex networks, Small words.

5

Table des matières

Résumé 3

Summary 4

Table des matières 5

Avant-propos 8

I. La solitude du chercheur d'informations 8

II. L'observation d'internautes en recherche d'informations

10

III. Pourquoi briser la solitude du chercheur d'informations '

17

IV. Comment briser la solitude du chercheur d'informations '

18

V. Dernière justification... 22

Introduction générale 23

I. Contexte et motivation 23

II. Approche et principaux objectifs 24

III. Plan du mémoire 25

Première Partie - Définitions et

état de l'art 26

Chapitre 1 - État de l'art, notions,

définitions et vocabulaire sur les graphes 27

1.1 Introduction 27

1.2 Historique 28

1.2.1 Le problème 28

1.2.2 La réponse par le graphe 28

1.3 Notions et définitions 30

1.4 Grands graphes de terrain 39

1.4.1 Définition 39

1.4.2 Caractéristiques 40

1.4.3 Contexte 41

1.4.4 Des petits mondes ou la légende des six

poignées de mains 42

1.5 Les communautés 43

1.5.1 Définition et choix de la terminologie : clusters,

communautés ou agrégats ? 43

1.5.2 Recherche et détection de communautés dans

les graphes 46

1.6 Conclusion 47

1.6.1 Vocabulaire et terminologie 47

1.6.2 Caractéristiques et valeurs 47

Chapitre 2 - Les algorithmes de création de

communautés 49

2.1 Introduction 49

2.2 Les partitions ou communautés sans recouvrement 50

2.2.1 Les algorithmes séparatistes 51

2.2.2 Les algorithmes de scission 53

2.2.3 Les algorithmes de recherche de zones de forte

modularité 54

2.3 Les différentes méthodes de recherche de

communautés avec recouvrement 55

2.3.1 Méthodes de recherche de formes : la percolation de

cliques 56

2.3.2 Les méthodes en plusieurs phases 58

2.3.3 Les méthodes par déplacement d'objets 64

2.3.4 Méthodes modifiées pour permettre le

recouvrement 71

2.4 Les méthodes de validation des communautés

74

2.4.1 Validation qualitative 74

2.4.2 Évaluation de la complexité 78

2.5 Synthèse 79

2.5.1 Caractéristiques importantes 79

2.5.2 Méthodes créant des communautés sans

recouvrement 82

2.5.3 Méthodes créant des communautés avec

recouvrement 83

2.5.1 Conclusion 84

2.6 Conclusion 85

6

Deuxième Partie - Nos propositions pour la

création d'agrégats par rigidification et

enrichissement 87

Chapitre 3 - Les méthodes d'agrégations

proposées 89

3.1 Introduction 89

3.2 Méthode 1 : Détection de cliques 90

3.2.1 La clique ou une densité maximale 90

3.2.2 Mécanisme de regroupement des mots-clés en

cliques 91

3.3 Méthode 2 : Rigidification Simple 92

3.3.1 Définition des problèmes de satisfaction

de contraintes géométriques G.C.S.P (Geometric Constraint

Satisfaction Problem) 93

3.3.2 Présentation de HLS 93

3.3.3 Les étapes de la méthode HLS 94

3.3.4 Implantation et adaptation de la méthode HLS 94

3.4 Méthode 3 : Rigidification Régulée

100

3.4.1 Dans quel but une nouvelle méthode

améliorée ? 101

3.4.2 Présentation de l'algorithme « Rigidification

Régulée » 106

3.5 Méthode 4 : Méthode d'enrichissement

d'agrégats par gravité 113

3.5.1 Les objectifs d'une méthode d'enrichissement des

agrégats. 114

3.5.2 Présentation de la méthode d'Enrichissements

par gravité 116

3.6 Conclusion 118

Chapitre 4. - Expérimentations, validations

sémantiques et résultats de mesure 121

4.1 Introduction 121

4.2 Présentation des réseaux testés 121

4.2.1 Les réseaux AOL 122

4.2.2 Les réseaux eDonkey 125

4.2.3 TREC-Eval 74

4.3 Les méthodes de validation sémantique 128

4.3.1 Méthode MCCVS ou « Méthode Comparative

de Coefficient de Validation Sémantique » 128

4.3.2 Méthode TREC-Eval : enrichissement de requêtes

136

4.3.3 Méthode MCCDR ou « Méthode de

Comparaison de Cohérence de Documents Retournés » 139

4.1.1 Conclusion sur les méthodes de validation 149

4.4 Résultats des regroupements et validation

sémantique 151

4.4.1 Agrégation par regroupement en cliques sur

réseau AOL-17/04/2006 et validation manuelle 151

4.4.2 Agrégation par la méthode de

Rigidification Simple sur réseaux AOL-17/04/2006 et AOL-17/03/2006 -

Validation

par MCCVS 152

4.4.3 Rigidification Régulée sur le réseau

« 100 mots dans AOL » avec validation par MCCVS 164

4.4.4 Rigidification Régulée sur le réseau

« 100 mots dans AOL » avec validation par MCSDR. 168

4.4.5 Rigidification Régulée sur réseau

eDonkey-10-semaine et validation manuelle 172

4.4.6 Méthode de Rigidification Régulée sur

réseau TREC-Eval-5 et validation par méthode TREC-Eval 175

4.4.7 Méthode d'enrichissement des agrégats AGGR

sur réseau « eDonkey-5 mois » et validation manuelle

(challenge)

179

4.5 Conclusion 180

Conclusion générale et perspectives

184

Bibliographie 193

Index 200

7

« Tout le monde savait que c'était impossible. Il

est venu un imbécile qui ne le savait pas et qui l'a fait.

»

Marcel Pagnol

Ce travail est dédicacé aux exclus du

système scolaire et à tous ceux qui n'ont pas, ou pas eu,

accès à l'éducation.

I. La solitude du chercheur d'informations 8

Avant-propos

Avant-propos

« Ou comment créer des communautés

dynamiques en utilisant des agrégats de

mots dans les grands graphes de terrain.

»

Les graphes représentent un espace d'étude

passionnant dont l'intérêt suffirait à justifier ce

travail. Mais telle ne fût pas notre motivation. Ce travail a

commencé par l'observation d'internautes recherchant des informations.

De cette observation est né le désir de trouver des solutions

pouvant aider les internautes à acquérir, comprendre et assimiler

l'information. Internet est devenu un conteneur d'informations dont la

dimension et la richesse semblent donner à ceux qui en dominent les

accès un don d'omniscience. Cependant, Internet est aussi vécu

comme une zone anxiogène. L'observateur ne trouvera pas surprenant que

la manipulation d'outils comme les moteurs de recherche soit difficile pour les

débutants ou les utilisateurs occasionnels. D'ailleurs, certaines

informations retournées, comme les url, sont codées et absconses

pour un grand nombre d'internautes. En fait, les mécanismes de blocage

sont étrangement semblables chez ceux-ci quelle que soit leur

expérience.

I. La solitude du chercheur d'informations

Suivant un protocole précis mélangeant des

recherches choisies et imposées, cinq adultes et quatre enfants ont

été observés.

Les utilisateurs présentaient des niveaux de

connaissance sur l'usage d'Internet très divers. Le matériel

disponible pour cette expérimentation était un PC connecté

à Internet, une interface homme-machine adaptée à la

personne, une caméra vidéo filmant le sujet (Webcam) et un

logiciel enregistrant les écrans permettant l'incrustation de la

caméra dans l'enregistrement. Ceci a permis de garder une trace

complète des observations.

Chaque observation présentée est une recherche

sur Internet ayant eu un but bien précis : soit la réponse

à une question soit la recherche d'un document. Elle a donné le

plus

I. La solitude du chercheur d'informations 9

Avant-propos

souvent lieu à une ou plusieurs requêtes (une

requête est comptabilisée chaque fois qu'un internaute clique sur

« rechercher » dans un moteur de recherche).

Dans cette expérience réalisée en 2006,

nous avons essayé de choisir un échantillon représentatif

de la société, en âge, genre et niveau social.

|

Prénom

|

|

Âge

|

Usage

|

Exp. sur

|

Temps

|

Situation

|

Commentaire

|

|

|

|

d`Internet

|

Internet

|

max.

théorique

|

perso.

|

|

- Les adultes

|

Jean

|

|

16

ans

|

Quotidien

|

> 5 ans

|

15

minutes

|

Lycéen

|

Utilisateur référent, Jean utilise Internet

plusieurs heures par jour (chat, recherche, ...), il a grandi avec Internet. Il

s'y connecte depuis 1995 ! Il est de la génération Internet !

|

|

Annie

|

72

ans

|

Mensuel

|

> 5 ans

|

25

minutes

|

PDG

retraitée

|

Annie n'utilisait Internet que coachée .... Ce sont ici

ses premiers pas en solo.

|

|

Georges

|

49

ans

|

Jamais

|

Nulle

|

15

minutes

|

Artisan

|

Georges est vraiment un débutant complet. Internet lui

fait peur, mais son intérêt pour la moto est un bon moteur.

|

|

Marie

|

|

37

ans

|

Rare

|

< 1 an

|

15

minutes

|

Infirmière

|

Marie à une double

personnalité elle est artiste par passion et scientifique

de profession. Internet la fascine, mais elle n'est qu'une internaute

occasionnelle.

|

|

Yasmina

|

|

20

ans

|

Mensuel

|

> 5 ans

|

15

minutes

|

Employée

|

Yasmina est une jeune fille qui n'utilise Internet que pour faire

des recherches sur des paroles de chanson. Yasmina malgré ses

engagements ne poursuivra pas le protocole.

|

- Les enfants

|

Guillaume

|

|

11

ans

|

Hebdo

|

Entre 1

et 5 ans

|

15

minutes

|

Collégien

|

Guillaume est passionné

d'informatique. Il est à l'aise

avec la machine.

Patient, posé, il va trouver ce qu'il cherche.

|

|

Céline

|

|

11

ans

|

Rare

|

< 1 an

|

15

minutes

|

Collégienne

|

Céline est une enfant rêveuse qui ne manque pourtant

pas de ténacité.

|

|

Lou

|

7 ans

|

Hebdo

|

Entre 1

et 5 ans

|

15

minutes

|

Scolaire

|

Lou est une enfant appliquée et bonne

élève.

|

|

Paul

|

7 ans

|

Rare

|

Jamais

|

15

minutes

|

Scolaire

|

Paul est un enfant dont on dit

qu'il est souvent « dans la

lune ». Il devra

faire beaucoup d'efforts pour se concentrer sur ses recherches.

|

Tableau AVP.1 : Les participants au protocole

d'observation. NOTE : Une présentation vidéo des internautes

ayant participé à l'étude est consultable sur le site

http://sissiprojet.free.fr.

II. L'observation d'internautes en recherche d'informations 10

Avant-propos

II. L'observation d'internautes en recherche

d'informations

Deux protocoles d'observation sont définis : un pour

l'observation des adultes, un autre concernant les enfants. Certains enfants

étant très jeunes et sans expérience, un protocole

spécifique, plus léger est préférable.

Le protocole des adultes

Il est composé de cinq recherches (deux libres et trois

imposées) : Recherches imposées :

1 Un texte : les paroles de la chanson « All Blues »

2 La distance entre Toulouse et Rodez

3 Une partition de musique : la partition de l'hymne national

roumain

Recherches libres : L'adulte doit fournir deux sujets sur

lesquels il devra, autant que possible rechercher une réponse à

une question ou un document dans un format particulier.

Le protocole des enfants

Le protocole des enfants est composé de deux recherches

(une libre et une imposée) : Recherche imposée : La durée

de vie d'un dauphin.

Recherche libre : L'enfant doit fournir un sujet de recherche

sur lequel il devra, autant que possible, trouver une réponse à

une question ou un document dans un format particulier.

Mesures

Pour chacune des observations des marqueurs sont choisis. Ces

marqueurs ont essentiellement pour but de mesurer le sentiment global de

l'utilisateur et de nous permettre de rattacher ce sentiment à des

éléments mesurables. On recherche ainsi, par le typage des

difficultés rencontrées et des comportements, à mieux

comprendre quelles situations peuvent créer un sentiment d'échec

ou de stress.

II. L'observation d'internautes en recherche d'informations 11

Avant-propos

Cinq valeurs sont mesurées pour toutes les

observations.

|

Valeur mesurée pour

chaque

recherche

|

Règles

|

|

Le temps complet de l'observation

|

Ce temps comptabilisera seulement le temps (format h : min :

sec) de recherche effective pendant l'observation. Les temps de

présentation de la recherche et d'auto-notation ne sont donc pas

comptabilisés (En cas de dépassement notable (100%) du temps

maximal donné par l'utilisateur, l'observateur lui propose de mettre un

terme à la séance).

|

|

Le nombre de sites visités

|

On comptabilise le nombre de fois où l'internaute

clique sur un lien dans le moteur de recherche ou clique sur un lien dans un

site envoyant sur un autre site. Si le site à déjà

été visité préalablement il est quand même

comptabilisé.

|

|

Le nombre de requêtes

|

On comptabilise le nombre de fois où l'internaute

envoie une requête au moteur de recherche. Les requêtes

renvoyées plusieurs fois sont comptabilisées plusieurs fois.

|

|

Le nombre de pages consultées dans les moteurs de

recherche

|

On comptabilise le nombre de fois où l'internaute

demande à afficher les sites retournés par le moteur de

recherche.

|

|

Si l'information, le document ou la réponse à la

question recherchée ont été trouvés

|

Valeurs possibles :

? oui,

? certains éléments ++,

? certains éléments --,

? non.

|

Quatre marqueurs sont enregistrés pour chaque

requête effectuée pendant l'observation.

|

Marqueurs enregistrés pour

chaque

requête

|

Explication

|

|

Les mots clés utilisés

|

La requête est archivée à l'identique, les

fautes d'orthographe et les caractères spéciaux sont

conservés.

|

|

Le nombre de mots clés utilisés

|

Chaque mot est comptabilisé. Les expressions entre

guillemets sont comptabilisées comme mots-clés.

|

|

Le nombre de sites « retournés »

|

On note le nombre de sites théoriques retournés

par le moteur de recherche. C'est en fait le nombre de sites affiché

comme le nombre de sites trouvés sur internet pour cette

requête.

|

|

Le caractère multi-langue des mots clés

utilisés

|

Si une requête contient des mots de langues

différentes elle est notée comme une requête

multi-langues.

|

Pour chacune des observations (résolues ou pas) le

sujet s'exprimera sur 5 caractéristiques subjectives qu'il notera de 0

à 10 : 0 signifiant « très mauvais », 10 «

excellent ».

|

Objet de l'auto-notation

|

Explication

|

|

Capacité à comprendre l'information

|

Ressenti sur la clarté des documents parcourus.

|

|

Intérêt des sites rencontrés

|

Ressenti sur la qualité informative des documents.

|

|

Longueur subjective de la recherche

|

Ressenti du temps passé sur Internet.

|

|

Ressenti général

|

Ressenti sur le plaisir éprouvé à surfer sur

le Web.

|

En cas de blocage ou de découragement, si le temps

maximum donné par l'utilisateur n'est pas dépassé,

l'intervention d'une tierce personne est possible de façon à ne

pas arrêter l'expérience. Ces interventions qui ont le plus

souvent pour but de guider l'utilisateur (replacer un utilisateur dans un

moteur de recherche, lui apprendre la notion de lien hyper texte,

répondre à une question technique, ...) sont toutes

notifiées.

II. L'observation d'internautes en recherche d'informations 12

Avant-propos

Résultats et exploitation

Les difficultés rencontrées par les utilisateurs

se situent au niveau de chacune des tâches élémentaires qui

composent la tâche globale de recherche d'information sur le Web. Ces

difficultés sont principalement de quatre ordres :

? Trouver les mots-clés efficaces

? Faire un choix dans une liste longue et

hétérogène

? Extraire de l'information des sites web proposés

? Gérer le temps (temps réel de recherche et de

perception)

Ces difficultés sont détaillées dans les

sections qui suivent.

Difficultés pour trouver des mots-clés

efficaces

Avec un nombre moyen de 7 millions de sites Web trouvés

par recherche, nous pouvons certifier que les 3,44 mots-clés

employés dans les requêtes ne sont pas assez efficaces pour

filtrer le Web. Les utilisateurs ont des difficultés pour employer

davantage de mots-clés et pour choisir ces mots. Lorsqu'ils le font,

cela devient même contre-productif : le taux de satisfaction

décroît. Cet état de fait provient d'un problème de

compétences des utilisateurs sur la nature même de la recherche.

En effet, en général les utilisateurs ne connaissent pas assez le

sujet pour enrichir la demande. Ceci provient également d'un

mélange entre atonie et manque de compétence sur le

fonctionnement du moteur de recherche. Le moteur de recherche est un outil avec

lequel l'interaction est limitée. On l'interroge et comme par magie, la

réponse est retournée. D'autre part, l'utilisateur ne manie pas

de mots dans une langue inconnue, par exemple, pour rechercher de l'information

sur la musique roumaine, personne n'a employé de mots-clés

roumains (même si des outils de traduction étaient connus). Un

seul des utilisateurs observés (Jean), a utilisé des mots de la

chanson anglaise à retrouver. Bilingue, il a su mélanger le

français et l'anglais. Ainsi on peut remarquer que l'utilisateur choisit

les mots-clés de sa requête en fonction de sa connaissance du

sujet et de sa connaissance du moteur de recherche utilisé. Il faut

également prendre en considération que les mots-clés

peuvent être mal orthographiés. De fait, les jeunes utilisent de

plus en plus le langage SMS. On a pu observer lors des expérimentations

que les enfants trouvaient (par erreur ?) l'information en formulant leurs

requêtes en langage SMS.

Difficultés pour faire un choix dans une liste

longue et hétérogène

La liste des informations retournées par un moteur de

recherche en réponse à une requête comprend un certain

nombre d'éléments. Avec Google, par exemple, comme le montre la

figure AVP.1, chaque item de la liste retournée intègre :

? Le titre du site. Mais comme tous les sites n'ont

pas un titre, dans ce cas, les moteurs, comme Google, utilisent d'autres

métadonnées (metatags) telles que

II. L'observation d'internautes en recherche d'informations 13

Avant-propos

le titre de la page, l'auteur, l'URL,... pour construire une

sorte de titre. De plus, lorsque ce titre est trop long, il est

tronqué.

· Un extrait (« snippet »). Il s'agit

en fait de bouts de phrases (quelques mots), entourant les mots-clés,

extraits du site. L'extrait constitué en assemblant ces bouts de phrases

n'a globalement pas de sens.

· L' URL (Uniform Resource Locator) de la page ou

du site.

On peut facilement imaginer un débutant

déstabilisé face à une telle liste. Par exemple, Annie, 70

ans, a soumis à Google la requête suivante « Natura 2000

marais de Gabarret » où « Natura 2000 » est une

organisation écologiste française et Gabarret est un petit

village français. Elle a obtenu la réponse suivante...

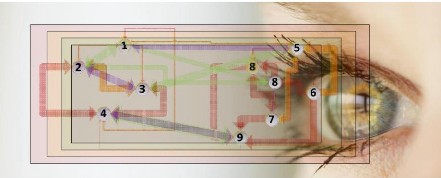

Figure AVP. 1 : Snippet et Information d'un site

retourné par Google dans une liste de résultats.

Le titre est en anglais, l'extrait est en français et

parle de la Tour Eiffel, l'URL est une adresse IP (Internet Protocol).

Difficultés pour extraire de l'information des

sites web proposés

A partir d'une page HTML : il est difficile

pour les utilisateurs d'extraire l'information présente dans la page.

Tous les utilisateurs peuvent « rater » des informations sur une

page. Ceci pour plusieurs raisons :

· ils cessent de lire la page avant que l'information

« pertinente », ou du moins intéressante, ait

été atteinte, la page leur paraît trop longue ;

· ils ne lisent que la partie affichée de la page

(effet fenêtre) ;

· la page est trop chargée, comme par exemple par

une présence excessive de publicité ;

· Ils confondent pages retournées et moteur de

recherche. Ils utilisent une fonction de recherche sur un site (Quid,

Amazon...) au lieu d'utiliser le moteur de recherche choisi ;

· ils « tournent en rond sur un document », le

scénario est alors le suivant : l'utilisateur fait défiler un

document, il trouve un lien qui pointe en réalité sur ce

même document clique et recommence l'opération (cela peut se

produite quatre ou cinq fois sans que l'utilisateur ne remarque que le document

parcouru est toujours le même) ;

II. L'observation d'internautes en recherche d'informations 14

Avant-propos

? ils cessent de lire si la page ou une partie de cette page

est dans une langue inconnue.

À partir d'un fichier : l'information

à extraire peut se trouver dans un fichier et non dans une page Web. Il

faut alors savoir exploiter ce fichier, qu'il s'agisse d'une image (comme pour

les partitions musicales par exemple) ou de tout autre type de fichier. Par

exemple, Jean recherchait une partition de musique ; il a trouvé un

fichier MIDI (son). Mais il ne savait pas qu'il était possible

d'extraire la partition à partir d'un fichier MIDI (Musical Instrument

Digital Interface) et a abandonné déçu.

Difficultés pour gérer le temps de

recherche et sa perception

La majorité des utilisateurs a déclaré

que le temps passé sur une recherche n'excédait pas 15 minutes.

Or il se trouve que le temps moyen calculé pour une recherche, est de 18

minutes et 45 secondes. De plus, 50% des recherches ont largement

dépassé les 15 minutes (Annie cherchera 1 heure 5 minutes et 30

secondes la partition de l'hymne national roumain). Si le temps consacré

à la recherche est moins important que le succès ou

l'échec dans l'attribution de la note générale moyenne,

au-delà de 15 minutes, l'appréciation fait

systématiquement apparaître une certaine déception

(seulement 5,5/10).

Conclusion sur les observations

Les utilisateurs d'Internet sont déçus par le

processus de recherche d'informations. Ils ont des difficultés pour

trouver les mots-clés efficaces, pour utiliser un moteur de recherche et

pour extraire l'information pertinente à partir de la liste

restituée, comme à partir des sites eux-mêmes. Au regard

des observations, des questions et des difficultés des internautes, il

apparaît que :

? le choix des mots-clés dans un

référentiel sémantique ne semble pas suffisant pour

retourner un nombre raisonnable de sites et pour garantir un ordonnancement

lié à ce champ sémantique ;

? les internautes ne savent pas formuler des requêtes

dans des langues étrangères, et lorsque les informations

retournées sont dans une langue qui leur est inconnue, ils se

considèrent en situation d'échec ;

? les internautes ne comprennent pas forcément les

textes retournés par les moteurs de recherche ;

? les formats des informations ou des fichiers

retournés ne leur permettent pas toujours d'extraire ni d'exploiter

l'information pertinente.

Ce qui frappe l'observateur d'internautes en situation de

recherche d'informations est évidemment le besoin de réponses

à une multitude de questions posées par la recherche

elle-même, par les outils et leurs usages. La méconnaissance de la

structure du réseau Internet est

Avant-propos

elle aussi un élément qui transforme Internet et

ses outils en un environnement mystérieux et donc ressenti comme

potentiellement dangereux.

Les moteurs de recherche sont des outils qui ne guident pas

l'internaute. En fonction de sa connaissance des mécanismes de ces

moteurs et de ses propres compétences (à la fois sur le sujet

recherché et sur le format de l'information), l'internaute fournit un

référentiel de mots clés qui lui est propre, le plus

souvent différent de celui (ou de ceux) utilisé(s) par les

auteurs des informations. Dans une requête sans résultat, par

exemple, un internaute aguerri et parlant anglais va rapidement élargir

sa recherche par l'usage de mots clés dans cette langue. Mais cela est

rare dans un contexte grand public.

Les internautes sont confrontés aux limites de leurs

compétences. Les questions qui doivent être exprimées en

utilisant un vocabulaire spécifique au domaine de recherche ou une

langue appropriée restent sans réponse. Le vocabulaire est donc

une des clés. Mais comment trouver les mots quand

précisément ce sont eux qui permettent de trouver les documents

qui contiennent ces mots ?

De plus quand les questions sont complexes ou relatives

à l'usage du moteur de recherche ou qu'elles se posent dans un domaine

où les concepts de bases ne sont pas connus l'internaute interpelle

l'observateur.

Dans la liste ci-dessous, nous présentons quelques

situations où précisément, les internautes en recherche

d'informations sont confrontés à des difficultés d'usage,

de compréhension ou de situations appelant à un dialogue.

II. L'observation d'internautes en recherche d'informations 15

Annie pendant une recherche se demande soudain «

Comment savoir quelle crédibilité je peux donner à ces

informations ? ».

http://www.mysissi.com/anniemarais.wmv

Georges dit, qu'il n'arrive pas à taper en anglais.

À la question « C'est anxiogène, Georges ?

», la réponse est immédiate "Oui ! je tape des mots

que je ne comprends pas, je ne comprends pas les réponses et je ne

comprends pas comment marche le système. »

http://www.mysissi.com/georgesallblues.wmv

Marie est gênée par toute la codification. Elle

essaie de cliquer sur tous les mots dans la page. Je devrai par la suite, lui

expliquer la notion de lien hypertexte.

http://www.mysissi.com/marieallblues.wmv

Jean n'arrive pas à utiliser des mots en roumain, il

revient plusieurs fois sur le même site exactement comme Georges notre

débutant. L'expert de 16 ans a le même comportement que le

débutant de 49 ans.

http://www.mysissi.com/jeanhymneroumain

media/jeanhymneroumain.wmv

Yasmina, après avoir écouté une chanson

et en avoir noté quelques paroles, recherche le texte complet sur

Internet. Elle n'a jamais utilisé les mots notés pendant

l'écoute comme mots-clés dans le moteur de recherche : «

Je ne pensais pas que ce soit possible ».

http://www.mysissi.com/yasminaprez

media/yasminaprez.wmv

II. L'observation d'internautes en recherche d'informations 16

Avant-propos

|

Lou est perdue à la lecture des sites retournés par

Google.

http://www.mysissi.com/loulilymedia\loulily.wmv

Guillaume recherche un clip vidéo en sachant que c'est

une chanson très populaire. Il utilise des mots clés comme "mini

clip" sans savoir vraiment pourquoi : « Une fois ça a marché

! ». Guillaume va battre le record du nombre de sites retournés

avec 230 millions de sites pour la requête « clip vidéo

». Il va finir par trouver ce qu'il cherchait dans une

publicité.

http://www.mysissi.com/guillaumepakitomedia/guillaumepakito.wmv

Paul a beaucoup de mal pour retrouver une information dans les

pages trop riches. Paul se perd aussi dans le moteur de recherche interne

à un site. En fait, il a le réflexe de taper des mots clés

dès qu'il voit un champ « recherche ».

http://www.mysissi.com/pauldauphinmedia/pauldauphin.wmv

Céline utilise comme tous les autres enfants de

l'observation des requêtes en langage « naturel » : «

combien de temps vit un dauphin ? » (sic) ou encore « un dauphin

vit-il longtemps? ». Elle va même jusqu'à taper le point

d'interrogation.

http://www.mysissi.com/celinedauphin

media/celinedauphin.wmv

|

|

Le lecteur peut avoir à priori le sentiment que seuls

les débutants ou les gens d'un certain âge vont se trouver en

proie à des difficultés. Il n'en est rien et des internautes

ayant 50 ans de différence peuvent rencontrer les mêmes

problèmes. Par exemple, Annie, une débutante âgée de

70 ans et Yasmina, une utilisatrice confirmée de 20 ans, vont se

retrouver confrontées aux mêmes troubles dans le repérage.

Jean, notre expert de 16 ans, va « bloquer » sur l'usage d'une langue

inconnue (alors qu'il manipule les outils de traduction sans problème)

exactement comme Georges. Ce dernier utilise un moteur de recherche pour la

première fois dans cette observation et il a 49 ans.

Comment s'approprier l'information ?

Trouver une information est donc parfois facile, parfois

difficile. Le vrai problème réside dans l'appropriation de

l'information qui nécessite une phase d'échange et de

confrontation. Or, les recherches se font le plus souvent dans une totale

solitude. La question d'Annie « Comment savoir quelle

crédibilité je peux donner à ces informations ? »

restera sans réponse à moins de rompre l'isolement.

Si l'information est le plus souvent immédiatement

disponible il n'en est pas de même pour la rencontre et l'échange

avec d'autres internautes concernés par le même sujet. Nous avons

choisi de nommer cette difficulté : « la solitude du chercheur

d'informations ». Les vidéos et les conclusions de ce travail

d'observation sont disponibles sur le site

http://www.mysissi.com. Ces

travaux sont également présentés dans l'article

[Belbeze&al-2007-3].

III. Pourquoi briser la solitude du chercheur d'informations ?

17

Avant-propos

III. Pourquoi briser la solitude du chercheur

d'informations ?

L'échange entre pairs est, dans le processus

d'acquisition de l'information, étudié sous le nom de

conflit-cognitif ou conflit sociocognitif. Un conflit sociocognitif est

défini par Tania Zittoun comme « conflit de points de vue

socialement expérimenté et cognitivement résolu »

[Zittoum-1997].

En partant des travaux de Piaget dans le domaine de la

psychologie cognitive, Vygotsky a mené des études sur les

interactions sociales (dans « Psychologie et pédagogie

», Piaget analyse comment les groupes d'enfants sont capables de

résoudre collectivement des problèmes et, ce faisant, de

progresser cognitivement [Piaget-1969]). Vygotsky a fortement

contribué à l'élaboration du courant socioconstructiviste.

En conférant une dimension sociale essentielle aux processus cognitifs

régissant l'apprentissage, Vygotsky a ouvert une nouvelle voie. Pour

lui, « la vraie direction du développement ne va pas de

l'individuel au social, mais du social à l'individuel »

[Vygotsky-1932].

Aujourd'hui les modes d'apprentissage recourant aux

échanges entre pairs sont fréquents. Ces échanges dans un

but pédagogique sont vus par Christophe Gaignon comme de la

réciprocité transformatrice ou transformation réciproque:

« Les identités aidant/aidé dialoguent entre elles et

l'aide est reçue tantôt par l'un, tantôt par l'autre : la

transformation sera réciproque grâce au mouvement circulaire de

donner-recevoir. En effet, il n'y a pas d'aidant qui donne et un aidé

qui reçoit, parfois nous recevons et parfois nous donnons. »

[Gaignon-2006].

Philipe Meirieu est, quant à lui, très sceptique

sur le fait que le travail de groupe puisse permettre une avancée

individuelle. Il considère par exemple que « les pratiques

(pédagogiques) de groupe n'apparaissent pas vraiment comme une

méthode capable de promouvoir des apprentissages repérables dans

le domaine cognitif. ». Ce que Meirieu veut signifier, c'est que dans

un travail de groupe où l'objectif est commun, chacun va travailler dans

son champ d'expertise. Il n'y a pas, dans ce cas, de nouveaux apprentissages

individuels. Il y a même le risque que celui qui ne sait rien faire, ne

fasse rien. Son jugement est différent s'il s'agit de groupes

d'apprentissage tels que lui-même les définit. Pour lui, le groupe

d'apprentissage a « sa raison d'être qu'en tant qu'il est

l'occasion pour chaque participant, d'atteindre un objectif nommé.

». Il déclare que dans les groupes d'apprentissage «... le

sujet [y] acquiert la capacité de mettre en correspondance son point de

vue ou son apport avec les effets qu'ils entraînent et de conserver, de

modifier ou d'abandonner ses propositions à l'issue de l'échange.

La confrontation extérieure joue le rôle de régulateur et

permet les ajustements que la réflexion solitaire du sujet n'aurait pas

toujours autorisés. » [Meirieu-1996].

Effectivement, si chacun possède un but qui lui est

propre, l'échange sera bénéfique pour tous. Les

communautés d'internautes que nous nous proposons de créer,

communautés « d'identités aidant/aidé »,

correspondraient alors à la définition du groupe de travail

donnée

IV. Comment briser la solitude du chercheur d'informations ?

18

Avant-propos

par Meirieu. En effet, dans une rencontre où chaque

participant a déjà entamé une recherche préalable

de manière indépendante sur un sujet proche voire commun, chaque

participant, aurait bien pour but individuel « d'atteindre un objectif

nommé ».

IV. Comment briser la solitude du chercheur

d'informations ?

Devant les difficultés et la solitude du chercheur

d'informations, la tentation pour un informaticien à proposer des outils

technologiques est grande [Belbeze&al-2007-1]

[Belbeze&al-2007-2]. Cependant la nature même de ces outils

technologiques en fait des éléments supplémentaires

à appréhender et à intégrer. Ils sont alors autant

de nouvelles sources potentielles de difficultés pour les

internautes.

Pour combattre cette solitude et atténuer cette tension

qui peut aller jusqu'à l'angoisse et donc au renoncement, la solution la

plus naturelle est la recherche d'un échange avec un pair. Cet usage

permet à la fois d'exprimer son besoin ou sa difficulté, de mieux

le ou la définir. L'échange est aussi propice à la

réflexion et bien sûr à l'acquisition de nouveaux

éléments.

À ce jour, il n'existe pas à notre connaissance,

d'outil générique permettant de rencontrer et converser

immédiatement avec des internautes concernés par une même

thématique. Les outils de messagerie instantanée, voix sur IP et

vidéoconférence ne permettent la connexion qu'avec des personnes

déjà connues. Les réponses aux recherches d'aide

principalement effectuées dans des forums sont données dans un

temps décalé qui ne règle en rien cette « solitude

» de l'instant. De plus, la durée de vie d'un thème de

recherche peut être très courte. C'est le cas, par exemple, pour

des thèmes liés à l'actualité ou à un

problème professionnel ponctuel.

L'échange par le biais de nos réseaux sociaux

actuels, le plus souvent en temps décalé, par mail ou forum,

présente l'avantage d'un contenant forçant le plus souvent une

forme de qualité (on réfléchit et on relit son message

avant de le poster). Richard Faebert déclare : «

Indéniablement, la place que laissent ces outils de communication

(Forum, listes de distribution) à une phase réflexive tire la

teneur vers le haut. » [Faebert-2002].

Certes, mais en « tirant vers le haut » le contenu ne va-t-on

justement pas rendre l'utilisation de ces outils encore plus exigeante,

notamment pour ceux qui ont des difficultés avec l'écrit ? Il

manque aussi à ce type de messagerie, la force de l'échange dans

le temps de la discussion orale. De plus, ils ont la forme d'une bouteille

jetée à la mer. On n'a jamais la certitude d'avoir une

réponse ni même d'être lu. Les « conflits cognitifs

» sont donc moins nombreux et moins forts puisque tempérés

par la relecture et le temps différé voire souvent éteints

par une non réponse.

Dans le même article que celui cité plus haut

Richard Faebert déclare à propos de la messagerie

instantanée : « Le temps de les taper (les mots) au clavier,

vos interlocuteurs ont

IV. Comment briser la solitude du chercheur d'informations ?

19

Avant-propos

déjà dérivé sur un autre

sujet. ». Le problème est que bien souvent, il n'y a en fait

pas de sujet. Si l'on se retrouve autour de la messagerie instantanée

comme autour d'un verre dans une conversation phatique, sans réel

désir de partager une thématique commune, il n'est pas surprenant

que les sujets glissent de l'un à l'autre. C'est alors l'absence de

volonté de débattre ou de partager une thématique et non

le média qui est à remettre en cause.

Il n'est pas question ici de juger de l'efficacité d'un

type de communication par rapport à un autre. Remarquons cependant que

si Internet propose de l'information immédiatement disponible, la

rencontre et l'échange entre internautes autour de cette même

information (sur des forums), ne possèdent pas, elles, cette «

immédiateté » qui serait pourtant parfois souhaitable.

Ainsi, la spontanéité du promeneur qui, se sentant perdu,

interroge un passant pour retrouver son chemin, ou celle du voisin qui nous

interpelle pour échanger un sentiment sur une actualité locale,

ou encore celle qui conduit des étudiants à partager leurs

interrogations à propos d'un travail scolaire, sont des attitudes

impossibles sur le réseau Internet sans connaitre l'interlocuteur.

De plus, les outils de messagerie instantanée sont eux

aussi en perpétuelle évolution : intégrant la vidéo

et la voix sur IP ils permettent aujourd'hui des échanges en groupe de

plus en plus simples.

Nous recherchons donc une solution permettant de trouver des

pairs et de créer des espaces d'échange le plus rapidement

possible. Cette solution permettra la création de ce que nous nommerons

des « Communautés Dynamiques ».

B

Lou en ligne

A

D I

E

U

C

Agrégat n°1

F

G

Internaute Anonyme en ligne

ID: 2-16.25.45.5

z

Marie en ligne

Agrégat n°2

Annie: hors-ligne

annie@mysissi.com

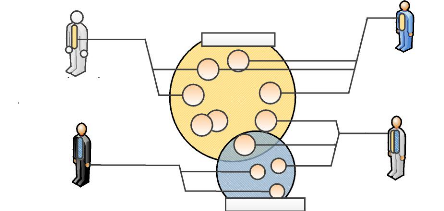

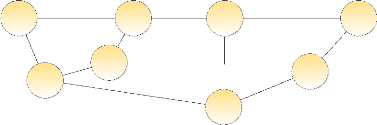

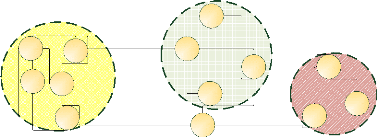

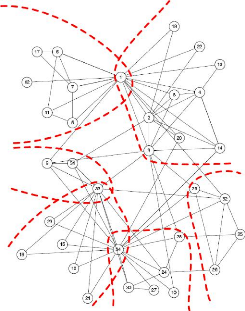

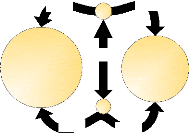

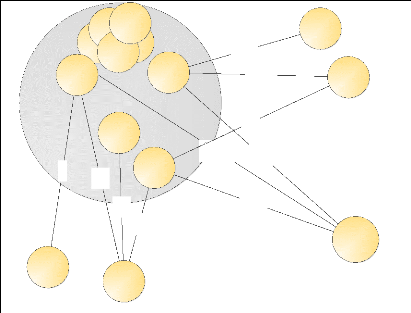

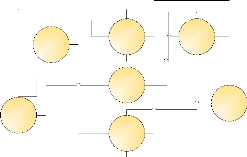

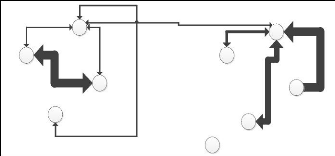

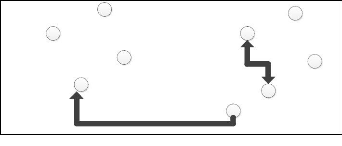

Figure AVP. 2 : Attachement des internautes à un

agrégat en fonction de leurs recherches.

y

Les rencontres entre utilisateurs se feront sur la base d'un

attachement à une thématique commune. Le repérage et la

construction des thèmes seront automatisés pour permettre la

création de communautés d'utilisateurs de type «

génération spontanée » ou communautés

dynamiques.

IV. Comment briser la solitude du chercheur d'informations ?

20

Avant-propos

Les communautés dynamiques donneront aux internautes la

capacité de communiquer entre eux de manière instantanée

ou différée. Les utilisateurs emploieront comme outil de

recherche de lien social le même moteur de recherche que celui servant

à la recherche d'information. Ils n'auront pas d'opération

supplémentaire ou nouvelle à apprendre.

Nous pouvons définir une Communauté

Dynamique comme constituée de deux types

d'éléments :

? Premièrement, un objet contenant un certain nombre de

mots, l'agrégat. Celui-ci est construit à partir

des usages conjoints de mots effectués par les utilisateurs dans une

requête. Le principe de la construction d'un agrégat doit

permettre de s'assurer d'une cohérence sémantique.

L'évaluation de cette cohérence sémantique est un

élément majeur.

? Deuxièmement, des internautes qui

sont rattachés à un agrégat (les internautes auront

utilisé suffisamment de mots de l'agrégat pour se voir

rattachés à celui-ci).

La création de communautés dynamiques

d'utilisateurs pourrait donc être exploitée afin de permettre

à un utilisateur de coopérer avec d'autres sans avoir ni à

s'authentifier, ni à se décrire, ni même à

s'inscrire dans ces espaces. Il n'en reste pas moins que la signature ou un

élément de communication permanent, comme une adresse de

messagerie électronique, permettront un fonctionnement asynchrone du

système.

1

Lou tape la requête

Marie, pouvons-nous

passer en mode Audio/

vidéo si tu as un micro

et une caméra ?

Lou en ligne

3

Attachement de Lou avec

L'agrégat 1

2

Envoi de la requête

4

Retour des résultats

5

Communication entre Marie et Lou

D

A B

Moteur de recherche et de

création de communautés

dynamiques

C

1

E

F G

I

2

4

Retour des résultats

2

Envoi de la requête

3

Attachement de

Marie avec les agrégats 1 et

2

suis passée en mode

Audio/Vidéo.

- Connais tu A B E ?

1

Marie tape la requête

Marie en ligne

Bonjour Lou c'est

- Bonjour Marie, je

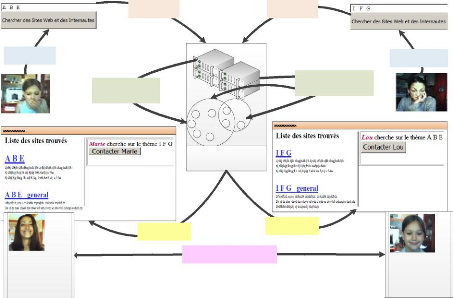

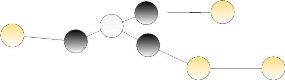

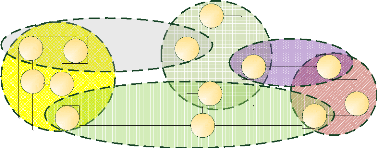

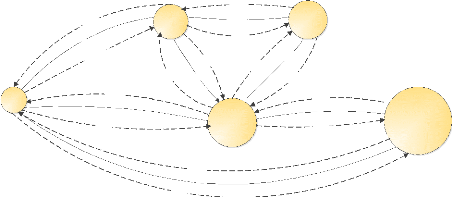

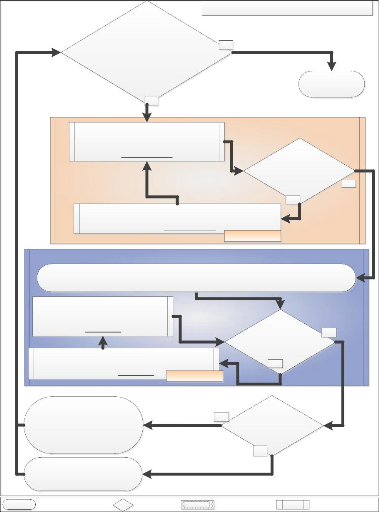

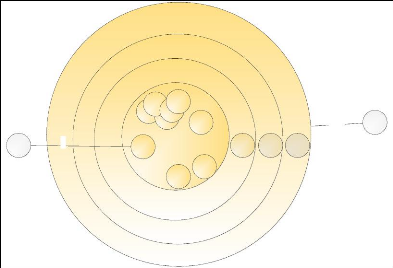

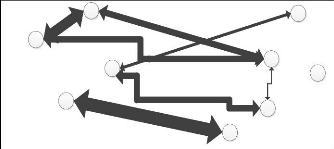

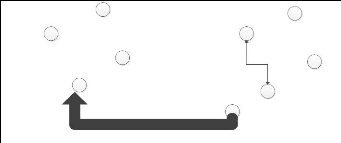

Figure AVP.3 : Exemple d'utilisation des nouveaux

services de communication au sein de la communauté dynamique avec des

utilisateurs en ligne.

IV. Comment briser la solitude du chercheur d'informations ?

21

Avant-propos

Annie en ligne

Annie hors-ligne

3

Création

de l'agrégat 2

et attachement d'Annie

avec

l'agrégat 2

6

Annie se déconnecte

2

Envoi de la requête

Annie laisse un message

4

Retour des résultats

création de

communautés

dynamiques

Moteur de recherche et de

10

Marie répond à

Annie

A

C

2

F

I

8

Enrichissement de l'agrégat 2 et

attachement

de Marie à l' agrégats

2

9

Le système avertit Marie du message

d'Annie

7

Marie tape la requête

Marie en ligne

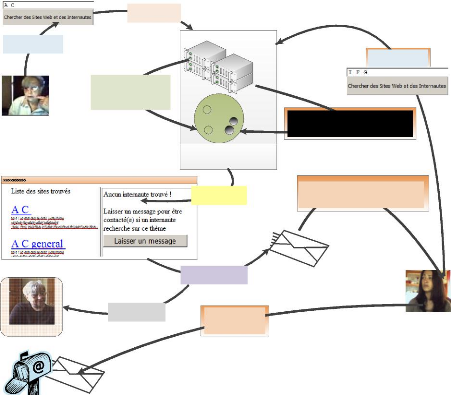

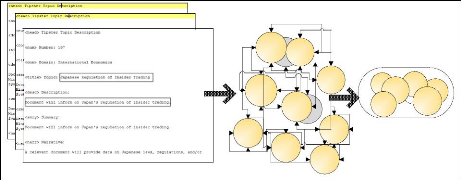

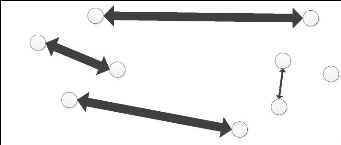

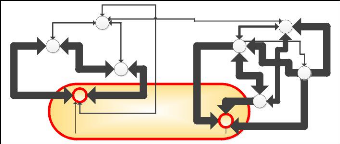

Figure AVP.4 : Exemple d'utilisation des nouveaux

services de communication au sein de la communauté dynamique avec des

utilisateurs hors-ligne.

5

Dans l'exemple présenté dans les figures AVP.2,

AVP.3 et AVP.4, Marie recherche des sites web en utilisant les mots-clés

I, F et G. Elle est donc connectée comme ayant des recherches sur les

thématiques de l'agrégat 1 et 2. Lou est elle aussi

connectée sur l'agrégat 1. Marie et Lou peuvent se voir proposer

une connexion de façon dynamique telle que celle décrite dans la

figure AVP.3.

Marie peut aussi se voir proposer d'échanger avec

d'autres utilisateurs ayant des centres d'intérêts proches des

siens. Elle peut aussi ouvrir un salon de discussion où seront

invités automatiquement les internautes concernés par les

mots-clés de l'agrégat N°1 ou N°2. Elle peut

démarrer une conversation en messagerie instantanée avec

l'utilisateur « Anonyme » en utilisant un identifiant temporaire

(adresse IP + numéro de session). Les agrégats peuvent être

créés et recalculés par un processus planifié.

Ceux-ci pourront ensuite être mis à jour ponctuellement par de

nouvelles recherches d'internautes s'il y a lieu.

Marie a aussi la possibilité de répondre au

message d'Annie comme dans la figure AVP.4, le système ayant en quelque

sorte créé un forum dynamique dont Annie et Marie sont les

premiers membres.

V. Dernière justification... 22

Avant-propos

L'affiliation d'un utilisateur à une communauté

dynamique peut aussi être vue comme un typage temps réel de

l'utilisateur du système. En effet, le profil de l'utilisateur est

immédiatement modifié en fonction des actions de recherche.

L'objectif des travaux que nous présentons est de

définir une méthode de création de ces agrégats de

mots-clés auxquels un utilisateur pourra être rattaché. De

fait, le regroupement ou la création d'agrégats a pour objectif,

dans un ensemble de mots donné, de rassembler les éléments

les plus proches possibles selon un ou plusieurs critères. Il a

également pour but de créer des agrégats les plus

éloignés possibles, sur ce ou ces critères. Le

critère prédominant utilisé dans notre cas sera

l'homogénéité sémantique.

Une fois l'appartenance de l'utilisateur à une

communauté celui-ci peut se voir proposer un grand nombre de services.

Des mots-clés supplémentaires dans une recherche ou la

définition de contextes de recherche sont autant de services

susceptibles d'aider les utilisateurs à accéder à toute

information utile, voire à optimiser l'accès à cette

information par un partage implicite de compétences.

V. Dernière justification...

La dernière justification à la mise en oeuvre de

tels outils de rencontre est simplement le plaisir d'échanger en

instantané sur un intérêt commun. Le plaisir qui est celui

de partager avec une intelligence humaine, vivante et interactive est aussi

celui de la poésie de la rencontre d'un mot dit, entendu, écrit

ou lu par l'autre et du moment présent, moment qui n'est

déjà plus, et dont l'instantanéité rejoint le

mystère de la vie.

I. Contexte et motivation 23

Introduction générale

Introduction générale

I. Contexte et motivation

En 2010 plus de 20% de la population mondiale avait

accès à Internet (

http://donnees.banquemondiale.org).

Ce média ne cesse de prendre de l'importance. L'expérimentation

montre, par ailleurs, qu'un nombre important d'internautes éprouve des

difficultés d'utilisation, de repérage et d'accès à

l'information. Or, des communications de pairs à pairs entre usagers

pourraient aider à les résoudre.

La matière première dont nous disposons, pour

rapprocher ces utilisateurs est constituée des requêtes soumises

aux moteurs de recherche. Afin de proposer les liens les plus pertinents

possibles entre usagers, nous devons avant tout cerner les thématiques

partagées entre ces derniers. Nous nous appliquerons à

détecter ces thématiques dans l'ensemble des mots-clés

constituant les requêtes, de sorte qu'au cours de leurs recherches les

internautes soient mis en relation automatiquement. Ainsi se constitueront ce

que nous appellerons des « Communautés Dynamiques » (cf.

Avant-propos).

La matière première constituée de mots et

de leurs utilisations conjointes a permis la création de graphes. Les

mots représentent les noeuds et les co-utilisations, au sein des

requêtes, les liaisons. Le graphe de mots ainsi constitué est issu

du monde réel. Il est dit graphe de terrain par opposition au graphe

généré mathématiquement. Nous avons ainsi

positionné notre espace de recherche comme faisant partie de

l'étude des graphes de terrain.

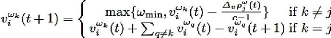

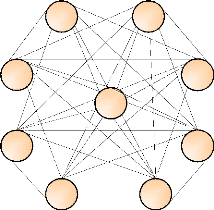

L'étude des grands graphes de terrain et plus

particulièrement l'aspect qui s'attache à la création de

groupes appelés communément « communautés », est

un espace de recherche suscitant un fort engouement. Un graphe est un

modèle particulièrement efficace pour représenter des

interactions entre des objets en très grand nombre. L'étude des

grands graphes

II. Approche et principaux objectifs 24

Introduction générale

de terrain a permis de relever des propriétés

communes à ces réseaux que nous étudierons pour la

construction de communautés dynamiques.

Les graphes obtenus à partir d'un fichier de log de

requêtes issu d'un moteur de recherche ont pour des périodes de

quelques semaines, un nombre de noeuds (de mots) supérieur à un

million et plusieurs dizaines de millions de liaisons. En raison de la taille

importante de ces graphes et de leur origine liée à un usage, ces

graphes peuvent être considérés comme un Grand Graphe de

Terrain.

Le noyau de la communauté dynamique sera un ensemble de

mots permettant la connexion entre utilisateurs. Cet ensemble de mots devra

représenter un espace sémantique cohérent autour d'une

thématique précise.

Nous considérons que l'usage volontaire de mots

associés dans un même texte (par exemple dans une requête

utilisateur) par un auteur est le critère déterminant la

cohérence sémantique entre ces mots. La cohérence

sémantique est donc consécutive à l'intention d'un

auteur.

Notre but est ainsi d'obtenir des agrégats de mots

sémantiquement cohérents issus d'un Grand Graphe de Terrain.

II. Approche et principaux objectifs

L'essentiel de notre approche consiste à agréger

les noeuds d'un graphe ; chaque agrégat obtenu devant correspondre

à un ensemble présentant une cohérence sémantique.

Notre approche se propose de traiter principalement les problématiques

suivantes :

? Créer des agrégats de mots pouvant

contenir des parties en recouvrement. Une orthographe peut appartenir

à plusieurs thématiques. Pour cette raison nous étudions

plus particulièrement les méthodes de regroupement avec

recouvrements.

? Définir une technique de regroupement

garantissant une forte cohérence sémantique. Pour cela nous

proposons et utilisons plusieurs techniques de regroupement avec recouvrements

ou de création de recouvrements et de validation sémantique dont

nous comparerons les résultats.

? Caractériser les agrégats pour comprendre

les différences de cohérence sémantique. Nous

recherchons par une évaluation sémantique en fonction de

caractéristiques et plus particulièrement de la taille des

agrégats, à déterminer ce qui fait la différence

entre des agrégats de forte et de faible

homogénéité sémantique.

? Créer des agrégats non pollués.

Les mots ne sont pas tous égaux entre eux en tant que signifiants.

Les mots de liaisons ou les articles ne sont pas, par

III. Plan du mémoire 25

Introduction générale

exemple, porteurs de sens. Nous rechercherons une technique de

regroupement qui a la capacité d'écarter ou de conserver ces mots

en fonction de leurs usages dans la globalité du graphe et dans la

relation locale aux mots de l'agrégat.

? Proposer des techniques de validation de la

cohérence sémantique des agrégats. Nous proposons et

mettons en oeuvre plusieurs techniques de validation de la cohérence

sémantique des agrégats, notamment une technique de validation

basée sur la comparaison du « comportement » d'agrégats

avec le comportement « des requêtes d'utilisateurs » et

d'agrégats aléatoires lorsqu'ils sont utilisés comme

élément de requêtes dans des moteurs de recherche. D'autres

techniques automatiques, manuelles ou semi manuelles sont utilisées et

comparées.

III. Plan du mémoire

Ce mémoire est constitué de deux parties.

La première partie présente le contexte de notre

travail et l'état de l'art des travaux connexes. Cette première

partie est divisée en deux chapitres :

? Dans le premier chapitre, nous introduisons le vocabulaire

utilisé dans le mémoire.

? Dans le second chapitre, nous proposons un état de

l'art des méthodes utilisées pour créer des

communautés dans un graphe. Nous étudierons ces

différentes propositions en fonction de notre objectif. Dans notre cas

la nature des objets manipulés - des agrégats de mots

représentant un thème - nous ont amenés à classer

ces méthodes en deux familles principales : les méthodes sans

recouvrements et les méthodes avec recouvrements.

Dans une deuxième partie nous décrivons notre

contribution. Fondée sur une recherche orientée sur la

création de regroupements de mots, elle ne prétend en aucun cas

se positionner comme une technique universelle. Cette deuxième partie

est partagée en deux chapitres.

? Dans le troisième chapitre, nous exposons plusieurs

techniques de regroupement. Nous justifions l'usage d'une nouvelle technique

fondée sur la résolution de contraintes ainsi que ses

évolutions et des techniques complémentaires.

? Dans le quatrième chapitre, nous présentons

plusieurs techniques d'évaluation de la validité

sémantique des agrégats de mots obtenus par les méthodes

du chapitre précédents.

Enfin, dans un cinquième chapitre, nous faisons

partager au lecteur quelques réflexions, retours d'expériences et

sentiments personnels sur notre expérience.

1.1. Introduction 26

Première partie. Définitions et état de

l'art

Première partie.

Définitions et état de l'art

La première partie a pour but de donner au lecteur les

éléments nécessaires à la compréhension de

ce mémoire et d'effectuer un état de l'art des technologies de

regroupement.

Le premier chapitre introduit les graphes et leurs

caractéristiques. Cette partie ne se veut en rien exhaustive. Au

contraire, nous ne couvrons ici que les notions présentes dans ce

travail. Il est conseillé au lecteur recherchant des informations plus

complètes sur les graphes de se référer à d'autres

ouvrages tels que « Théorie des graphes et ses applications

» de Claude Berge [Berge-1958] ou encore du

même auteur « Graphes et hypergraphes »

[Berge-1970] et enfin de Béllé Bolllobas

« Modern Graph Theory »

[Bollobas-1998]. Dans ce chapitre, nous explicitons

aussi, autant que faire se peut, en avant-propos, les termes spécifiques

utilisés et tentons de les situer et d'en évaluer la

pertinence.

Dans un second chapitre, nous effectuons un état de

l'art des diverses méthodes de détection de communautés

dans les graphes. Nous tentons de cerner leurs intérêts et leurs

limites.

1.1. Introduction 27

Chapitre 1. État de l'art, notions, définitions et

vocabulaire sur les graphes

Chapitre 1.

État de l'art, notions, définitions

et vocabulaire sur les graphes

1.1 Introduction

Manuel Castells, sociologue américain, définit

Internet comme le « ... produit d'une combinaison unique de

stratégie militaire, de coopération scientifique et d'innovation

contestataire ». Ce qui est notable dans cette définition

amusante est la diversité des composantes d'Internet. Cette

diversité est un facteur de croissance. D'une manière plus

générale, les réseaux créés à des

fins d'utilisation, tels que les transports en commun, le mail, le

téléphone, ou le « cloud computing », ont souvent des

croissances d'usage exponentielles et ceci d'autant plus que leurs clients sont

hétérogènes. Devenus populaires, les réseaux se

mettent à porter des noms, quelquefois des noms de marques et parfois

même des noms propres comme Internet. Identifiés, utilisés

par tous, ces réseaux offrent l'attrait de nouveaux usages.

Pour symboliser ces réseaux constitués, par

définition, d'objets en relation les uns avec les autres, on utilise le

plus souvent une représentation sous forme de « graphes ».

L'étude des graphes ou « Théorie des graphes » est en

premier lieu une théorie mathématique. Mais l'importance de ces

réseaux dans notre quotidien pousse de plus en plus les femmes et les

hommes « de l'art » à les étudier. Ainsi, nombre

d'informaticiens étudient Internet en passant par des

représentations graphiques et nombre de sociologues utilisent les

graphes dans des études de réseaux sociaux, par exemple. Les

graphes ont leurs règles, leurs vocables et leur histoire. C'est de ces

éléments dont nous allons traiter dans ce chapitre.

1.2. Historique 28

Chapitre 1. État de l'art, notions, définitions et

vocabulaire sur les graphes

1.2 Historique

Les premières études sur la théorie des

graphes sont celles effectuées par Leonhard Eulervdans avec sa recherche

d'une solution au problème des ponts de Königsberg (Euler 1736). La

ville de Königsberg située en Prusse est alors constituée de

deux iles reliées par sept ponts (cf. figure 1.1). La ville se nomme

aujourd'hui Kaliningrad.

1.2.1 Le problème

Le problème posé est de trouver un chemin

permettant de passer sur chaque pont en n'empruntant chaque pont qu'une seule

fois.

|

Plan de la ville

|

Plan simplifié

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

île

|

|

|

|

|

île

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Terre

|

|

|

|

|

|

|

Figure 1.1 : Les sept ponts de

Königsberg.

rive A

rive A

C

B

île B

rive D

Rivière

ferme

Pont

Leonhard Euler va dessiner un schéma où rives et

îles seront représentées par des

points et chaque pont comme des « fils » entre ces

points, créant ainsi un graphe (cf. Figure

1.2).

île C

rive D

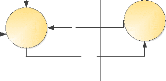

1.2.2 La réponse par le graphe

Les points de terre ferme sont les noeuds ou sommets du

graphe. Les noeuds et sommets représentent toujours les objets

connectés du graphe. Habituellement un noeud (ou un sommet)

représente un objet actif du graphe. Dans un réseau social, les

noeuds représentent des personnes et par transposition, les connections

leurs relations sociales, par exemple.

Nb de ponts=3

A

B

Nb de ponts=3

C

Nb de ponts=5

D

Nb de ponts=3

Figure 1.2 : Les sept ponts de Königsberg dans une

représentation graphique.

1.2. Historique 29

Chapitre 1. État de l'art, notions, définitions et

vocabulaire sur les graphes

Une fois la représentation graphique

créée, la question : « Peut-on faire un parcours passant par

les sept ponts en n'utilisant qu'une seule fois chaque pont ? » se

résume à : « Existe-t-il un chemin pour revenir d'un point

ferme à un autre, différent de celui pris pour aller ? ». Si

nous notons à coté de chaque noeud (point de terre ferme) le

nombre de ponts (cf. figure 1.2), il devient évident que ce nombre

étant toujours impair, il ne sera pas possible depuis un point de terre

ferme visité en « milieu » de promenade de revenir directement

au point précédent sans réemprunter un pont

déjà utilisé.

Cette caractéristique n'est pas nécessaire pour

tous les noeuds. Elle l'est cependant pour au moins deux : celui de

départ et celui de fin. Aucun point de terre ferme n'étant

accessible par un nombre pair de pont, la réponse est finalement qu'il

n'est pas possible d'effectuer la promenade demandée.

La représentation graphique nous permet donc d'affirmer

qu'il n'existe pas de solution à ce problème.

Il est par ailleurs intéressant de noter certains

enseignements fournis par ce travail fondateur :

? C'est la pondération des éléments de terre

ferme par le nombre de ponts qui permet de trouver la réponse au

problème.

? Une fois le graphe créé, il n'est plus

nécessaire de le parcourir pour connaître les informations nous

permettant de répondre à la question posée. La

localisation des ponts et des points de terre ferme n'a plus d'importance. Et

on pourrait tout à fait répondre à la question sans

représenter les fils entre les points de terre ferme.

Comme on peut le voir, une représentation d'un

réseau par un graphe permet de répondre à une question

donnée. La représentation et les informations à

représenter sont à choisir en fonction de la nature du graphe et

de la question à résoudre. Dans notre travail nous aurons donc

à rechercher une représentation graphique la plus efficace

possible, pour répondre à nos questions de regroupement.

Nous nous devons aussi de souligner que cette étude

porte sur un réseau d'usage (nos promeneurs utilisent les ponts) et de

« terrain » au sens premier du mot.

1.3. Notions et définitions 30

Chapitre 1. État de l'art, notions, définitions et

vocabulaire sur les graphes

1.3 Notions et définitions

La représentation mentale d'un graphe est

généralement aisée et la notion de noeud et liaison est le

plus souvent comprise de manière intuitive. Cependant, l'utilisation

d'une terminologie précise se révèle nécessaire

dès qu'il s'agit d'approfondir l'étude de ces ensembles.

Voici listées les notions utilisées dans notre

contexte de travail ; à noter que certaines définitions

données peuvent tenir compte de notre point de vue. Pour une information

plus complète il est possible de consulter plusieurs ouvrages de

référence tels que [Berge-1958] [Berge-1970]

[Bollobas-1998].

Arc

Un arc est le nom donné à une liaison ou à

une arête dans un graphe dirigé.

Arête

Élément reliant deux points d'un graphe.

Généralement représenté par un segment de droite.

Dans la matrice d'adjacence du graphe la présence de l'arête est

représentée par un 1 et son absence par un 0.

Arête orientée

Une arête orientée est une arête

présentant un sens. Un des pairs est un émetteur l'autre un

récepteur. On parle aussi d'arc. Les arêtes orientées sont

des éléments des graphes orientés.

Arête

pondérée

Une arête pondérée est une arête

présentant un poids. Ce poids est une valeur numérique permettant

de comparer la validité des arêtes. Les arêtes

pondérées sont des éléments des graphes

pondérés.

Centralité

La centralité d'une arête e, notée

cB(e), est définie comme le nombre de plus court(s) chemin(s)

entre toutes paires de noeuds contenant e : ainsi, si la centralité

d'une arête est grande, on peut s'attendre à ce qu'elle se trouve

à l'interface entre deux communautés du graphe

considéré. Cette notion peut facilement être étendue

aux noeuds en considérant le nombre de plus court(s) chemin(s) passant

par un noeud donné. Une arête à forte centralité est

considérée comme un séparateur possible de

communautés.

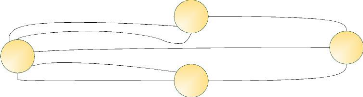

2

5 4

1

3

6

Chapitre 1. État de l'art, notions, définitions et

vocabulaire sur les graphes

B

D Z

A

C

cB(e)=32

X

W

Y

Liste des plus courts chemins passant par l'arête

[C-X/X-C] en considérant le graphe comme dirigé

|

A-W

|

A-X

|

A-Y

|

A-Z

|

W-A

|

X-A

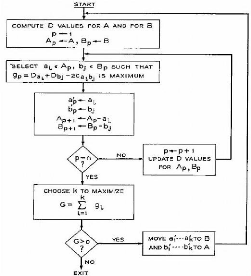

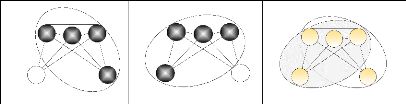

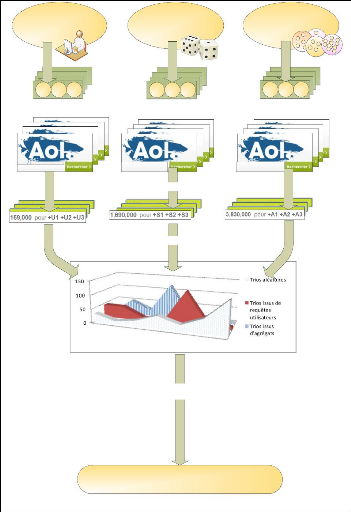

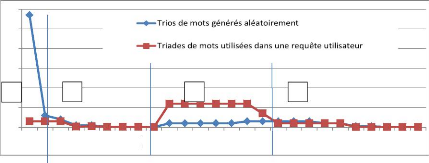

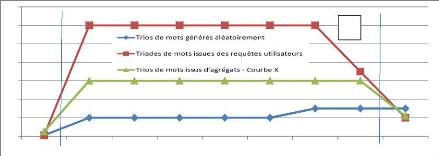

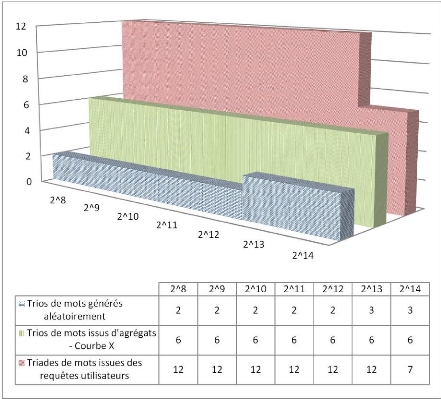

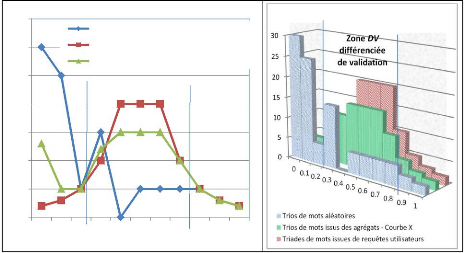

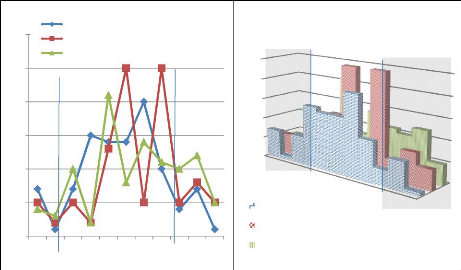

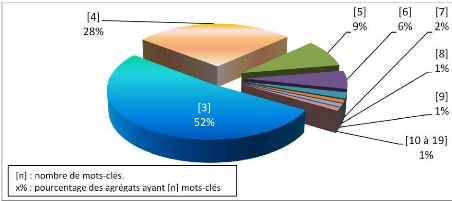

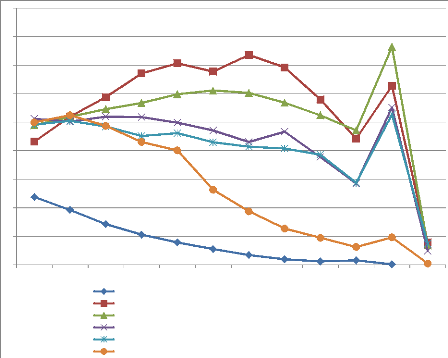

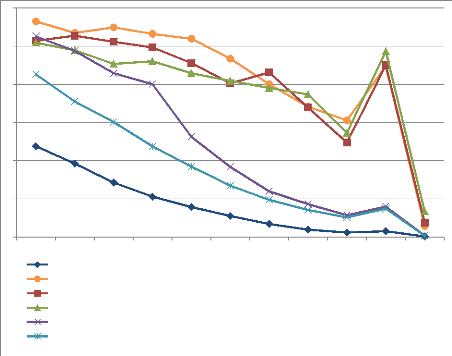

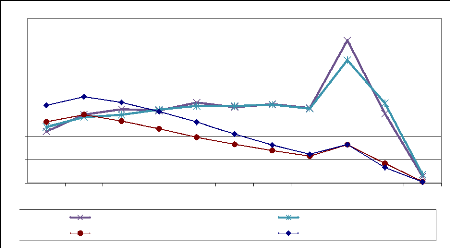

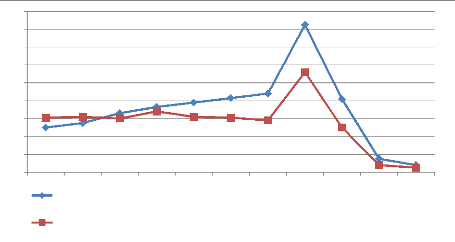

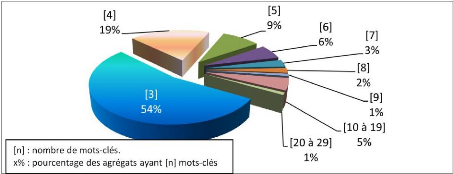

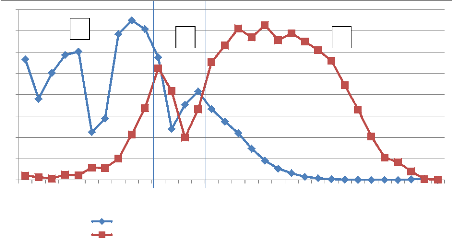

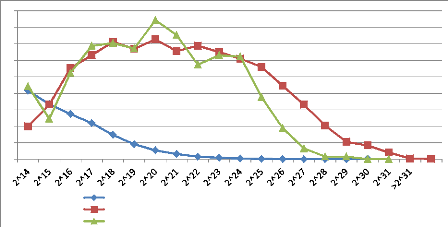

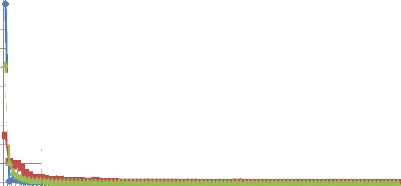

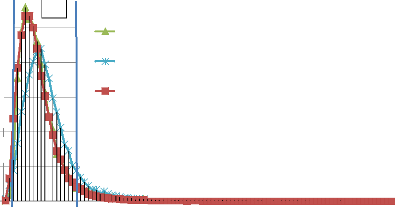

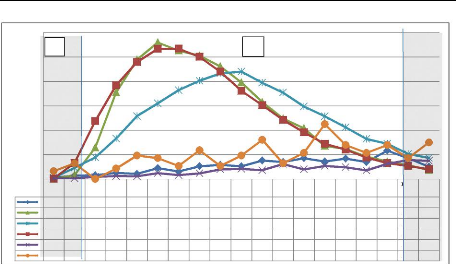

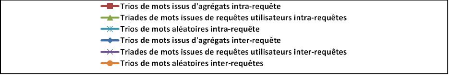

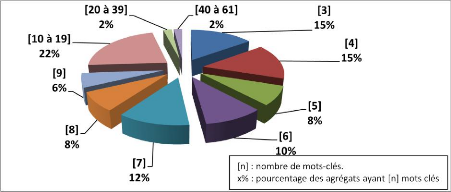

|