Chapitre 3

Noyau associé continu asymétrique

Dans ce chapitre nous commençons par donner

la définition dun noyau associé continu. A partir de

cette définition, nous présentons lestimateur a noyau

associé continu asymétrique dans le cas

univarié puis multivarié. Nous étudions les

propriétés

élémentairesdecetestimateur.Différentsexemplesseronttraitésenguisedeconclusion.

3.1 Cas univarié

Danscettepremièrepartie,nousprésentonslestimateuranoyauassociécontinuasymétrique

dans le cas univarié. Cet estimateur est approprié pour estimer

des densités a support compact ou bornées d'un côté.

Nous allons traiter quatres noyaux di~érents

gamma, bêta, gaussien inverse (IG) et

gaussien inverse réciproque (RIG) Pour de

réé centes références nous pouvons consulter Chen

(1999 2000) et Scaillet (2004) Nous montrons les propriétés

élémentaires telles que biais, variance et MISE.

Ensuite nous déterminons les fenêtres optimales pour

chaque noyau associé considéré et

lerreur en fonction de ces valeurs.

Soit X1,X2,. . . ,Xn un échantillon de

variables aléatoires iid de densité de probabilité

continue inconnue f a support = [a,b], avec a E R et b E R ( est par exemple

le support [0,1] ou [0, + 8[). De manière

génèrale, l'estimateur a noyau continu est

de la forme suivante:

|

bfn(x) = 1

n

|

Xn

i=1

|

(3.1)

Kx,h(Xi)

|

= bfn,h,K(x),

on x est fixé dans , Kx,h est la fonction noyau

associéU et h est un réel strictement positif appelé

paramètre de lissage.

Dans le cas on Kx,h est associé a un noyau

continu symétrique il vérifie

~x - . ~

1

Kx,h(.) = hK .

h

Dans le cas purement asymétrique,

Kx,h est un noyau variable en fonction de la cible x (point

d'estimation). Il change de forme chaque fois

que x varie dans .

3.1.1 Definition

Definition 1: Soit x ? ? et h > 0. Nous appelons

"noyau associe continu "" Kx,h toute densit( de

probabilit( dune variable aléatoire Kx,h sur le support ?x,h tels

que:

|

?x,h n ? =6 Ø

|

(3.2)

|

|

?x?x,h ? ?

|

(3.3)

|

|

E(Kx,h) ~ x quand h ? 0

|

(3.4)

|

|

V ar(Kx,h) < co

|

(3.5)

|

|

V ar(Kx,h) ? 0 quand h ? 0.

|

(3.6)

|

Commentaires::

a. La relation (3.2) traduit le fait que

l'intersection entre le support des observations et le support du

noyau associé continu

asymétrique doit contenir au moins un

élement. Pour un h fixé, quand x parcourt ?, le

support ?x,h change, l'expression (3.3) suppose que ?

doit etre toujours contenu dans la réunion des ?x,h. La

condition (3.4) permet d'assurer la convergence ponctuelle de

l'estimateur ; elle met en évidence que le noyau

Kx,h est un noyau variable ou adaptif a la cible x. Par

analogie au cas continu symétrique, la

relation (3.5) n'est que la formule annoncée dans (25) du

chapitre précédent. Enfin, la relation (3.6) assure la

convergence de la variance de la variable aléatoire du

noyau associé et va nous servir dans les calculs suivants.

b. Avant que nous passons a l'étude des des

noyaux continus asymétriques, nous

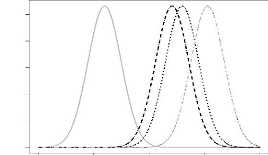

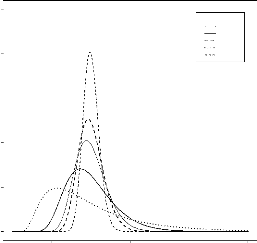

reveFIG. 3.1 - Densit( de loi norinale centrée

Densité de la loi

normale

0.0 0.1 0.2 03 0A

th30040)

-6 -4 -2 0 2 4 6

x

FIG. 3.2 -- Illustration de la densite normale pour h = 1.5 et x

= y varie

0.00 0.05 0.10 0.15 0.20 0.25

K(Y)

|

1

|

Xn

i=1

|

~ ~

exp -1 (Xi x)2 . 2 h2

|

|

nhv2ð

|

-10 -5 0 5 10

y

male N(u,ó2) est une loi continue

définie sur ? = R de densité de probabilité

gN(u,ó2) telle que

~ ~

1 -1 (x - u)2

gN(u,ó2)(x) = v2ðó2 exp .

2 ó2

Si X est une variable aléatoire qui suit la loi

normale alors lespérance et la variance sont respectivement

E(X) = u et V ar(X) = ó2.

La figure 3.1 donne l'allure

génerale d'une densité normale centrée Soit

KN(x,h2) le noyauassociéalavariablealéatoire

KN(x,h2) deloinormale N(x,h2)définisur ?x,h = R.

Nous vérifions ainsi chacune des hypothéses de la

définition 1 En effet, la relation (3.2) se traduit par l'intersection

de ? = R avec ?x,h = R qui n'est que R. En plus, d'apres

(3.3), la réunion sur x de R reste inchangée

puisque le support ne dépend pas de x. A partir de (3.4),

l'espérance est exactement égale a x;

E(KN(x,h2)) = x.

Finalement, la variance est finie et égal

exactement a 0 quand h ? 0;

V ar(KN(x,h2)) = h2 < 8.

A ce niveau, nous donnons l'estimateur a noyau

associé normal défini sur ? = R. Soit X1, ... ,Xn un

échantillon de variables aléatoires iid. de densité de

probabilité f continue et inconnue sur R. L'estimateur a

noyau associé gaussien est

|

bfn(x) = 1

n

|

Xn

i=1

|

KN(x,h2)(Xi)

|

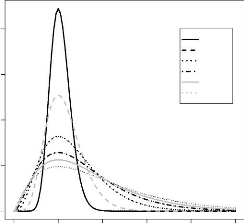

FIG. 3.3 Illustration de la densit normale pour x = 2.1 et h

varié

-1 0 1 2 3 4 5

N(x,h)(y)

0.0 0.5 1.0 1.5 2.0 2.5

h=0.15 h=0.3 h=0.7 h=1.1 h=1.4 h=1.8

Get estimateur est-il une densité de probabilité?

Oui en effet

ZR

Z ( (t - x ~2)

1

bfn(x)dx = -1

hv 2ð exp dx

2 h

R

Z r (x - t )2}

(a) 1 -1

= hv 2ð exp dx

2 h

R

= 1.

(a): La loi gaussienne est

symétrique le fait que nous

intégrons par rapport a x (la cible qui est aussi

la moyenne) ou a t (la variable aléatoire) ne

change rien; nous nous permettons ainsi de permuter entre

la cible x et t et nous trouvons que c'est une densité de

probabilité (voir figure 3.2 et 3.3). Bien que la

vérification dans le cas dun noyau

associécontinusymétriqueparaltsimple,laquestionrestevalablepourchacundesnoyaux

asymétriques.

Nous présentons maintenant les densités continus

asymétriques classiques que

nous allons utiliser dans la suite de cette section (Tab 31)

Soient a et b deux réels strictement positifs

qui vérifient

Z +8

(a) = e_tta_1dt

0

et

Z 1

B(a,b) = ta_1(1 - t)b_1dt.

0

3.1.2 Propriétés élémentaires

Nous donnons dans cette partie les différentes

propriétésfondamentales delestimateur a noyau

associé.

TAB. 3.1 -- ??????? re????t???t?? ??s ??s

?? ?r?????te ??t????s

?s\u9313‡A?éet?i??e

Loi de probabilité Support Densité

Gamma(a,b) R+ (a1)ba ta-1 exp(-t/b)

Beta(a,b) [0, 111 B(a,b)ta-1(1 -

t)b-1

IG(a,b) R+ vvb2ðt3 exp {- 2ba ( a t - 2 + 7)}

RIG(a,b) R+ l2ðtb exp {- 2ba (at - 2 + a1t)}

Loi de probabilité Espérance Variance

Gamma(a,b) ab ab2

Beta(a,b) a/(a + b) ab/ {(a + b)2(a + b + 1)}

IG(a,b) a a3/b

RIG(a,b) 1/a + 1/b 1/ab + 2/b2

Propriétés 1:: ??t X1,X2,. . . ,Xn ??

(????t???? ?? ??r?????s ??e?t?r?s ?????? ?? ????

b

s?t ?? ?r??????te ??t???? ??????? f d

s???rt ?? ??t fn ?? ?st???t??r ?? f a

?\u9313‡A??

b

fn(x) ???st ??s ?e?

?ss??e ??t??? ?s\u9313‡A?etr?q??

?é??? ?r ?? ??rs? ?? ???t?? x 7-?

??ss??r????t ??? ???s?tt ?? ?r??????té ?r ?? ??

?s??t

1,2

c = I bfn(x)dx = c(h,K) = 0,

b

??s ??s??er?s ?esr???s ???st???t??r fn t?? q??

|

in(x) = nc

|

Xn

i=1

|

Kx,h(Xi). (3.7)

|

|

Dans la suite, nous supposons que

|

fn(x) est une densité de probabilité.

Nous illustrons

|

cette hypothese dans la partie exemple

b

densite de probabilite continue inconnue f de support ?. Soit

fn l'estimateur de f a noyau associe continu

asymetrique Kx,h de variable aleatoire Kx,h

sur le support ?x,h. Alors, ?x ? ? et h > 0, nous avons

E {fri(x)} = E{f(Kx,h)} . (3.8)

Démonstration: Soit x ? ?. Nous avons successivement

E {/n(x) } = E nEKx,h(Xi)}

{ 1 n

i=1

= E {Kx,h(X1)}

(a)

=

= E{f(Kx,h)} .

(a); les Xi sont dans ? et le noyau

associé est défini sur ?x,h. D'on l'intégrale

se fait sur l'intersection des deux supports

Dans le but d'assurer la convergence ponctuelle de

lestimateur nous avons adapté le lemme présenté par Hille

(1948) et dont une démonstration a été donnée par

Feller (1966) dans le lemme1,page 219.Noussignalons

que celemme étaiténoncé

dansletravailrécentdeChaubey

etal.(2007)1.Ainsi,nousleformulonsdanslapropriétésuivante

Propriété 3: Soient f une fonction continue et

bornée sur ? et x est fixée sur ce

b

support. Soit fn l'estimateur a noyau

associé continu Kx,h sur ?x,h. Nous supposons que

?x ? ?,?x,h ? ?. Alors nous avons

|

E {In(x)} =

|

ftn?x,h

|

f(t)Kx,h(t)dt ? f(x) quand n ? 8.

|

La convergence est uniforme en toute subdivision de ?

dans laquelle V ar(Kx,h) ? 0 quand h ? 0 et la

fonction f est uniformément continue.

Démonstration: Nous partons de l'expression de lestimateur

dans (3.1) et nous calculons son espérance

E {fn(x)} = Kx,h(z)f (z)dz.

Itx,hn?

Comme?x,h ? ?, nous pouvons écrire f(x) = f(x) R

?x,h Kx,h(z)dz. Ainsi, il existe ä > 0

tel que

~

E{.7.n(x)}- f(x) =h{f(z) - f (x)}

Kx,h(z)dZ

Nx,

f |f(z) - f (x)| Kx,h(z)dz + I |f(z) - f (x)|

Kx,h(z)dz.

?? \u9670·?s et??s r???tes ???s ?? res??t?t ??r ? Pr??ss??r

???????? ????u a ??????er?it ??????????? ?t ?? ??s?t? ?? ???r?t?r? ??

??t?e??t?i??e ?????i?u?e ?? ???

Pour calculer la première quantité, nous

utilisons directement la définition de la continuité:

?e > 0, ? ä > 0, ?z : |z - x| < ä |f(z) -

f(x)| < €. D'on nous obtenons,

|f(z) - f (x)|Kx,h(z)dz = E Kx h(z)dz

lz-x|<ä flz-x|<ä

= €.

Pour calculer la deuxième quantité, nous

utilisons linégalité de Tchebychev-Markov

Comme f est bornée ? M > 0 tel que f = M. Ainsi, nous

avons

fl (z) - f (x)|Kx,h(z)dz = 2M I Kx,h(z)dz

z-xl>5|

1z-x|>ä

2M

ä2

ä2 Kx h(z)dz

flz-x|>ä

2M

L (z - x)2 Kx,h(z)dz

.,h

2M

ä2

E {(Kx,h x)2}

(a) = 2M 2M

ä2 V ar (Kx,h) + ä2 {E (Kx,h) -

x}2

(a): nous appliquons directement la formule

E(X2) = V ar(X) + {E(X)}2. Or, d'après les deux

hypothèses (3.4) et (3.6) du noyau associé,

la dernière inégalité tend vers 0. Nous

concluons enfin que

E { in(x)} -f(x) ? 0 quand n ? +8.

Remarque: ?? ?r?r?ete

q?? ??s ???s ?res??t( ?st ??????? ???s ??le ??s ??e

?\u9313‡A??\u9312‡@??t???s

s\u9313‡A?etr?q??s ?t

?s\u9313‡A?etr?q??s?

Proprietes 4: \u9670·?s ?res??t?s ??

?e?????????t ????t( ??

??\u9313‡A?r????r???? a ?r?d??

?t ?? ???t ?\u9313‡A?? ?? ?? ??r????? ??e?t?r? E(Kx,h) = mx,h

t?? q??

f(Kx,h)ÿ=f(mx,h) + (Kx,h -

mx,h)f0(x) + 12(Kx,h -

mx,h)2f"(x). (3.9)

?? ????????t ???s?er???? ?? ??tt?

q???t?té? ??s ?t???n

E {f(Kx,h)} ÿ=f {E(Kx,h)} +

2V ar(Kx,h)f00(x). (3.10)

1

3.1.3 Biais ponctuel

Propriétés 5:: Soit x fix( dans ?. Nous

avons

Biais {1n(x) } = E {1n(x)} - f(x)

=ÿ [f {E(Kx,h)} - f(x)] + 21 V

ar(Kx,h)f" (x). (3.11)

Demontration : En effet, d'apres le resultat de (38) et les deux

expressions dapproximation de Taylor-Lagrange

(3.9) et (3.10) le biais sobtient facilement en retranchant

f(x).

Remarque: Nous remarquons que le

biais ne d(pend pas de n et tend vers 0 quand h est tres

petit.

|

3.1.4 Variance ponctuelle

Pour un x fixe, nous generalisons l'expression de la

variance de que ce resultat sera utilise dans la partie exemple

|

b

fn.

|

Nous precisons

|

Propriétés 6:: Soit x fix( dans ?. Nous

avons

n o Z h n o i2

V ar bfn(x) =ÿ 1 K2

x,h(t)f(t)dt - 1 Biais bfn(x) . (3.12)

+ f (x)

n n

?x,hn?

Demonstration: Comme les Xi sont i.i.d., nous obtenons

successivement

V ar {:fn(x) } = V ar { 1 E Kx,h (Xi)}

n

i=1

|

1

n

1

n

|

[V ar {Kx,h(X1)}]

[E {Kx,h(X1)}2] -1 n [E{Kx,h(X1)}]2

|

(Z ) (Z )2

1 K2 - 1

x,h(t)f(t)dt Kx,h(t)f(t)dt .

n n

?x,hn? ?x,hn?

Par analogie avec le noyau continu

symetrique nous avons

|

{Z ?x,hn?

|

2

Kx,h(t)f(t)dt }=ÿ [Biais fn(x)} + f

(x) 2

|

et sous la condition f?x,hK x2 h(t) f (t)dt est finie,

la variance de fn est

J

1 2

V ar {in(x)} =ÿ1

h(t) f (t)dt } - n [Biais {fn(x)} + f (x)1 .

n Rxhn?x,

|

3.1.5 MISE L'erreur globale de

|

b

fn s'obtient en sommant le carré de

l'expression (311) avec le

|

resultat obtenu dans (3.12).

Propriétés 7: En sommant sur l'intersection des

deua supports, e MIISE est

|

Z

MISE =

?

|

{ }

E bfn(x) _ f(x) dx

x,hn?

|

Z { } Z }

Biais2 {

= V ar bfn(x) dx +

bfn(x) dx.

?x,hn? ?x,hn?

3.1.6 Exemples

Nous supposons dans toute la suite que f admet une

dérivée seconde continue sur

}2 }2

le support et que les termes suivants sont finis J {

{

f'(x) dx, J xf''(x) dx et

? ?

f{ }2

x3f''(x) dx.

?

a. Cas d'un noyau associé gamma

Chen (2000) était le premier a introduire l'estimateur a

noyau asymétrique. Il

préb

|

sentait au début un premier estimateur

|

fn a noyau gamma de

paramètres a = x/h + 1

|

et b = h, il calculait ensuite les propriétés

ponctuelles et globalesliées a cet estimateur Puis, a cause

des problèmes du biais au bord quavait cet estimateur Chen

e~ectuait

unelégèremodificationauniveaudesparamètresdunoyaugammapourréduirelerreur

|

et il représentait un deuxième estimateur

que nous notons

|

bbfn(x).

|

Nous rappelons qu'une loi gamma est une loi

continue asymétrique définie sur = R+ de

densité de probablité gG(a,b) telle que:

ta-1e-t/b

gG(a,b)(t) = (a)ba ,

Z

(a) =

avec

e-tta-1dt.

R+

Si X une variable aléatoire qui suit la loi

gamma, alors

E(X) = ab et V ar(X) = ab2.

D'après la figure 3.4, nous

remarquons que selon les valeurs que prennent

a et b, l'allure de la courbe change. Dans le cas particulier on a =

1 nous retrouvons la loi exponentionnelle.

Soit KG(x/h+1;h) le noyau associé a la variable

aléatoire 1G(x/h+1;h) de loi gamma et de support x,h = R+. Il

est donné par

FIG. 3.4 Allure générale d'une densit

gamma

Densité de la loi gamma

0 1 2 3 4 5

y

Density Gamma

0.0 0.2 0.4 0.6 0.8 1.0

Gamma

a=1 b=1

a=2 b=1

a=3 b=1

a=4 b=2

a=5 b=2

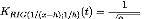

Les deux figures 3.5 et 3.6 donnent l'allure du

noyau associé gamma qui dépend

des paramêtres x et h. Nous donnons en premier lieu la

représentation du noyau gamma pour un h

fixé, nous remarquons qu'en changeant x

la courbe change légérement de forme et se

déplace principalement sur l'axe des abscisses. Cependant, si nous

varions h comme indiqué dans le

graphique 3.6, l'allure de cette densité

change complétement.

Nous révisons d'abord les différentes

hypotheses du noyau associé KG(x/h+1;h).

R+ = Ø.

i.R+ n =6

R+

ii.uxR+ = R+.

+ 1)h = x ' x h --* 0.

iii.E(JCG(x/h+1,h)) quand

= (x/h + h

xh +

iv.V ar(JCG(x/h+1,h)) = (x/h + 1)h2 = h2

< 00.

v.h --* 0 V ar(JCG(x/h+1,h)) = 0.

Soit X1,X2,. . . ,Xn un échantillon de

variables aléatoires iid. a support = R, de

b

densité de probabilité continue inconnue f. Nous

considérons l'estimateur fn a noyau associé

gamma tel que

Xn

i=1

Xn

i=1

bfn(x) = 1

n

1

n

KG(x/h+1;h)(Xi)

Xx/h

1 i e_Xi/h

(x/h + 1) hx/h+1 ,

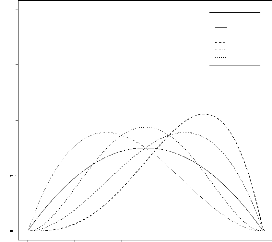

FIG. 3.5 Allure du noyau assoei gamma

pour h = 0.2 et x varié

h=0.2

0 1 2 3 4 5

y

Gamma(x,h)(y)

0.0 0.5 1.0 1.5 2.0

x=0 x=0.5

x=1

x=2 x=2.8 x=3.5

on h > 0 est le paramêtre de lissage et K est

le noyau associé a une variable aléatoire de loi

gamma de paramêtres x/h + 1 et h. D'aprês (3.11), nous

avons

{ } = hf'(x) + 1

Biais bfn(x)

2hxf''(x) + o(h). (3.13)

Dans le calcul du biais, nous nous arrêtons a lordre 1

pour avoir une homogénéité des puissances avec

la variance dans le calcul de lerreur quadratique

moyenne intégrée MISE (Le biais sera

élevé au carré) D'aprês cette expression, nous

remarquons que e biais tend vers 0 quand h

tend aussi vers 0. Le fait que f' et f''

figurent dans la même équation, n'est pas

três favorable dans le calcul du biais puisque

ça augmente lerreur La complicité de la

dérivée premiere avec la dérivée seconde est dfe au

fait que x n'est pas la cible mais elle est plutôt le mode.

Nous calculons la variance de cet estimateur Daprês (312)

nous avons

{ o h

V ar bfn(x) = 1 E

~KG(x/h+1;h)(X1)~2i - 1 ~E ~KG(x/h+1;h)(X1)~]2 . n n

Nous calculons chacun des deux termes En effet nous avons

.

( )

X2x/h

1 e_2X1/h

E {KG(x/h+1;h)(X1)}2 = E

h2(x/h+1)2x/h + 1

FIG. 3.6 - Allure du noyau associe gamma

pour x = y = 2 et h varie

0.0 0.2 0.4 0.6 0.8

Gamma(x,h)(y)

x=2

h=0.1 h=0.3 h=0.7

h=1.1 h=1.4 h=1.8

0 2 4 6 8 10

y

Soit KG(2x/h+1;h) un noyau associe gamma de

par/ahme-et2rXe1s /2h

01. 2x/h + 1 et h;

{KG(2+1;h)(X1)} =

2 1 2x h2x/h+1(2x/h +

1).

Ce qui implique

X1 2x/he-2X1/h = h2x/h+1(2x/h

+ 1)KG(2x/h+1;h)(X1). Ainsi, nous trouvons finalement

(

h2x/h+1 (2x/h + 1)

E ~KG(x/h+1;h)(X1)~2 = E

h2(x/h+1) 2(x/h + 1) KG(2x/h+1;h)(X1)

h-1

(2x/h + 1) il K

lG(2x/h+1;h)PC1)}

=

2 (x/h + 1) .

Nous examinons les differentes conditions du noyau

associe KG(2x/h+1;h). i. R+ n R+ = R+ =6 Ø.

ii.?xR+ = R+.

iii. E(KG(20/+1;h)) = (2x/h + 1)h = 2x + h.

iv. V ar(KG(201,+1;h)) = (2x/h + 1)h2 = 2xh +

h2 < co.

v.h ? 0 V ar(KG(2x/h+1;h)) = 0.

Ah(x) ~

-1/2 si x/h ? 8

1h si x/h ? k,

?

??? ?

????

1 x 2vhð

(2k+1) 21+2k2(k+1)

Nous avons ainsi

E~KG(2x/h+1;h)(X1)~ = f(x) + h 2 f0(x) + o(h).

Soit l'expression de Ah(x) telle que

Ah(x) =h-1 (2x/h + 1)

2(x/h + 1).

Nous considerons la fonction R(z) monotone, croissante et

converge vers 1 quand z tend vers l'infini (i.e: ?z >

0, R(z) < 1). Elle est donnée par

v

2ð

R(z) = e-z zz-H. (3.14)

(z + 1)

En prenant z = 2x/h et z = x/h, nous obtenons

v2ð

e-2x/h(20.)2x/h+1/2

R(2x / h) =

(2x/h + 1)

R2(x/h) =

2ð e-2x/h(2x/h)2(x/h+1/2).

2 (x / h + 1)

Ainsi, Ah(x) peut etre exprimee en fonction de R(x/h) et

R(2x/h).

Ah(x) = 1 v2ð R2 (x / h)

e-2x/h 2x \ 2x/h+1/2 x -2(x/h+1/2)

2ð R(2x/h) e-2x/h h h

|

h1/2

|

R2(x/h) x R(2x / h)

|

-1/222x/h+1.

|

|

v2ð

|

Comme R(z) < 1 alors R2(z) reste encore inferieur a

1. Par consequent, le rapport

R(2x/h) < 1 et nous trouvons

R2(x/h)

h1/2 R2 (x/h)

-1/222x/h+1

Ah(x) =

v2ð R(2x/h) x

hv

= 2v.

ðx

Pour un h suffisamment petit,

on k est une constante positive.

Nous calculons a ce niveau le deuxieme terme de la variance

2

\ 112

[E {KG(x/h+1;h)(X1) I .1 = [E {Lfn,h,K(x)dx }i

=(a) 1.

(a): D'apres la propriété (3.7).

En conclusion, la variance est donnée par

-1/2f(x) + O(n-1) si x/h ? 8

1 si x/h ? k.

hnf(x)

V ar {:fii(x)} ~ ??? ? ?

????

1 x 2nvhð

(2k+1)

21+2k2(k+1)

L'impact de la variance au bord est

négligeable dans la calcul de son

intégrale, nous ne tenons compte que du terme

qui se trouve a lintérieur de notre support ceci se

démontre par le calcul suivant:

Soit ä = h1-E, on 0 < E < 1.

f ar {:fii(x)} dx = 1ä V ar

{:fii(x)} dx + f: V ar {:fii(x)} dx

T8 1

x-1/2 f (x)dx + O(n-1 h-€)

2nvher

1 r 2nvher 0 x-1/2 f (x)dx +

o(n-1h-6).

La valeur de la variance dans la petite boule de centre 0 et

de rayon h1-€ dispose d'une valeur dérisoire

ce qui fait que la quantité

qui pése le plus est celle qui se trouve au milieu de

]0, + 8[.

Nous mesurons ainsi l'erreur quadratique

moyenne intégrée MISE

8 2 rMI SE(n,h,K,f) = 10 Biais {fn(x) } + V

ar {:fn(x)}

Z 82

= h2 r f0(x) +

12xf"(x) dx

0

+ 2nN 1 her Jo8

x-1/2f(x)dx + o( 1 ).

nvh

En minimisant le MISE par rapport a h, nous avons

|

2h

|

fo

|

2

(x) + 12xf (x) } dx

|

1 1

2n 2h2Or /0

|

8

x

|

-1/2f(x)dx = 0.

|

Enessayantdedéterminerlafenetreoptimalenousregrouponslestermesen

hdememe coté;

8

0°

2h I {f' (x) + 1 2 x f" (x) }2

dx =

2n 2h2ver

1 x-1/2 f (x)dx.

C'est-à-dire

|

h5/2 = 1/20r f rx-1/2f()dx 4f 0 {1(x) +

(x)}2 dx

n

|

-1.

|

Enfin, la fen:tre optimale est

|

hopt =

|

(1/2vð)2/5 r

if08 x-1/2f(x)dx}2/5 n [f r { f' (x) +

1xf"(x)}2 dx] 2/5

|

-2/5.

|

La fenetre optimale dans le cas

asymétrique est dordre

O(n-2/5) inférieur que dans le cas

symétrique O(n-1/5). En

remplacant cette valeur optimale dans l'expression du MISE, nous

avons successivement

2

MISEopt (hopt)

ho2 pt 8 1

{f (x) + 2x f (x) } dx

|

+

|

1 1

|

8

L-1/2 I

x-1/2 f (x)dx

'opt

|

|

|

2vð n

|

|

=ÿ

|

n-4/5

44/5 2v7r 0

{ 1 /8 -1/2 2 1/5

x f(x)dx }4/5 f (x) + 2x (x) } dx .

[18 1 "

0

|

b

Dans le but de réduire le biais et par la suite

l'erreur entre fn et f, nous présontons le deuxième

estimateur qu'a introduit Chen (2000) ; la modification sest faite

au niveau de la cible de sorte qu'elle devient la moyenne

de la variable aléatoire du noyau associé. Pour cela,

soit

|

fn(x) = 1

n

|

Xn

i=1

|

KG(ñh(x);h)(Xi), (3.15)

|

ofi

|

ñh(x) ~

|

?

?? ?

???

|

x si x = 2h

4h2

x2+1

si x ? [0,2h[.

|

De la meme manière, nous calculons toute les

propriétés de cet estimateur Le biais est tel que:

|

Biais {in(x)} ~

|

?

?? ?

???

|

2 x f" (x)h + o(h) si x = 2h

îh(x)hf'(x) + o(h) si x ? [0,2h[.

|

La variable î dépend de h et change de

valeur en fonction de x, elle est égale à:

îh(x) = (1 - x) {ñh(x) - x/h} / {1 + hñh(x) -

x}.

Clairement, le biais est plus petit dans ce cas ;

quand x tend vers l'infini, nous obtenons une expression

qui ne dépend que de la dérivée seconde

f00, ce qui est plus faible par rapport au biais de

fn.

La variance de f est équivalente a celle de

fn pour x/h tend vers l'infini. Nous distinguons une

légère différence dans le cas on x/h s'approche

de la constante k. En effet, la variance est égale a:

~ ~

V ar bbfn(x) ~

x-1/2f(x) + O(n-1) si x/h ?

8

a(k) n1 h f (x) si x/h ? k,

?

???

???

1

n

v 1 2 hð

avec a(k) un coefficient qui dépend seulement

de k.

La somme du biais au carré et de la variance nous

amène a déterminer le MISE de cet estimateur;

1 1 1 1 2

MISE( r 2 f (x)dx

Tfii)= h2 {x f (x)} dx + v x

hð n 0

4 0

(1/2vð)2/5 U08 x-1/2f(x)dx}2/5 Lb 8 {x

f" (x)} 2 dx] 2/5 n

-2/5.

Ainsi, la fenêtre optimale est

hopt =

En substituant cette valeur dans lexpression du MISE lerreur

quadratique moyenne

intégrée optimale est::

-1/2 f (x)dx ] 4/5

1 1

MIS Eot(hot) =44/5 [ 2vð fo8 x [fo8

fixf"(x)12 dx ] 1/5 n-4/5.

|

Nouspouvonsêtretenterquelesdeuxestimateurs f

et

|

bb

f atteignentlavitessedeconver-

|

gence optimale. Nous montrons que pour

toute densité f continue:

Z 8 ~f (x) + 2 x f,, (x) }2

dx= fo8 {x f,,(x) }2 dx.

Ceci implique

systématiquement

MISEopt( bf) =

MISEopt(bbf).

Enfin, du point de vue purement théorique, il

est clair que le deuxième estimateur bbf donne de

meilleure performance en utilisant une fenêtre plus faible par rapport au

pre-

b. Cas d'un noyau associe beta

Tout comme les noyaux gamma, Chen (1999)

applique le même principe pour les noyaux

bêta. Il introduit pour cela un premier estimateur on ilit

remarque que les paramètres choisis ne sont pas

les plus adéquats donc, ilit essaye de les

harmoniser etet les es

arranger pour aboutir a de meilleures estimations

et par conséquent de meilleures perr formances. L'idée

est strictement la meme nous commencons ainsi par rappeler la loi

beta. La densité de probabilité d'une loi beta est définie

continue sur [0,1] telle que:

|

gBe(a,b)(t) = on a > 0, b > 0 et vérifiant

|

B(a,b)ta-1(1 - t)b-11[0,1](t), 1

|

B(a,b) = I ta-1 (1 - t)b-1dt.

Si X est une variable aléatoire qui suit la loi

beta alors

a ab

E(X) = et V ar(X) =

a + b (a + b)2(a + b + 1).

La figure 3.7 donne l'allure de la fonction beta d'une

manière générale.

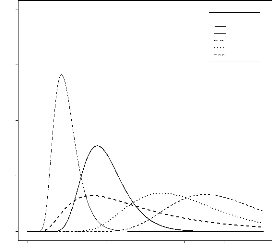

FIG. 3.7 -- Allure generale de la densit(

bêta

0.0 0.2 0.4 0.6 0.8 1.0

y

Bet3(3,b)

4

3

2

Bêta

a=2 b=2

a=3 b=2

a=4 b=2

a=2 b=3

a=3 b=3

LenoyauKBe(x/h+1;(1-x)/h+1))estlenoyauassociéaunevariablealéatoire

KBe(x/h+1;(1-x)/h+1)) de loi beta et de support ?x,h = [0,1] tel

que:

.

1

KBe(x/h+1;(1-x)/h+1)(t) = B(x /h + 1,(1 - x)/h +

1)tx/h(1 - t)(1-x)/h

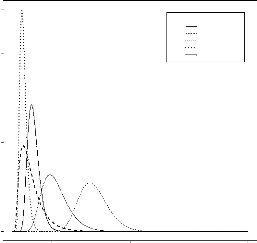

FIG. 3.8 -- Allure du noyau associe bêta pour

h = 0.2 et x varie

h=0.2

Beta(x,h)(y)

0 1 2 3 4 5 6

x=0 x=0.1 x=0.2 x=0.3 x=0.4 x=0.5

0.0 0.2 0.4 0.6 0.8 1.0

y

Lesfigures3.8et3.9donnentlavariationdunoyaubetachaquefoisquenouschangeons

les paramètres x et h.

Nous nous assurons que ce noyau est bel et

bien un noyau associé i.[0,1] n [0,1] = [0,1] =6 Ø.

ii.?x[0,1] = [0,1].

(x+h)

iii. E(KBe(x/h+1;(1--x)/h+1)) = (1+2h) x quand h

?0.

x(1--x)h+h2+h3

iv.

V ar(KBe(x/h+1;(1--x)/h+1)) = (1+2h)2(1+3h)< 8.

v.h ? 0 V ar(KBe(x/h+1;(1--x)/h+1)) = 0.

Soit X1,X2,. . . ,Xn un échantillon de

variables aléatoires i.i.d sur ? = [0,1], de densité

de probabilité continue

asymétrique inconnue f. Nous considérons

l'estimateur

fn de f

a noyau beta tel que

|

fn(x) = 1

n

|

Xn

i=1

|

KBe(x/h+1;(1--x)/h+1)(Xi)

|

1

n

Xn

i=1

B(x/h + 1,(1 - x)/h + 1)

,

1 Xi x/h(1 - Xi)(1--x)/h

avec x ? [0,1] et h > 0 est le paramètre de

lissage.

FIG. 3.9 -- Allure du noyau associe bêta pour x

= y = 2 et h varie

x=0.2

Beta(x,h)(y)

0.0 0.5 1.0 1.5 2.0 2.5 3.0

h=0.1 h=0.3 h=0.7

h=1.1 h=1.4 h=1.8

0.0 0.2 0.4 0.6 0.8 1.0

y

En se bénéficiant des calculs antérieurs

nous avons

1

Biais {:fii(x) } = h(1 - 2x) f (x) + 2x(1 -

x)hf"(x) + o(h),

et

V ar {:fii(x)} = n1 [E

1KBe(x/h+1;(1-x)/h+1)(X1)}21 + O(n-1),

on

1 i (1 - Xi)2(1-x)/h.

~KBe(x/h+1;(1-x)/h+1)(X1)~2 = B2(x/h + 1;

(1 - x)/h + 1)X2x/h

Soit KBe(x/h+1;(1-x)/h+1) le noyau

associé de loi beta défini par

KBe(2x/h+1;2(1-x)/h+1)(Xi) =

B(2x/h + 1; 2(1 - x)/h + 1)

1

i

X2x/h(1 - Xi)2(1-x)/h.

Ce qui fait que

Xi 2x/h(1 -Xi)2(1-x)/h = B(2x/h + 1; 2(1 - x)/h +

1)KBe(2x/h+1;2(1-x)/h+1)(Xi). Ainsi:

Tout compte fait, nous avons

E {KBe(x/h+1;(1-x)/h+1)(X1) }2

B(2x/h + 1; 2(1 - x)/h + 1)

=

B2(x/h + 1;(1 - x)/h + 1)

E {KBe(2x/h+1;2(1-x)/h+1)(Xi)}.

Nous appellons Ah(x) = B(2x/h+1;2(1-x)/h+1)

B2(x/h+1;(1-x)/h+1) et nous rappellons que B(a,b) =

(a)(b)

(a+b) .

Nous vérifions les conditions du noyau

associé KBe(2x/h+1;2(1-x)/h+1)(Xi).

i.[0,1] n [0,1] = [0,1] =6 z. ii.ux[0,1] = [0,1].

x+h/2

iii.E(KBe(2x/h+1;2(1-x)/h+1)) = 1+h ~ x quand h ?

0.

< 8.

iv.V ar(KBe(2x/h+1;2(1-x)/h+1)) = 4x(1-x)h+2h+h2 v.h ? 0

V ar(KBe(2x/h+1;2(1-x)/h+1))

(2+2h)2(2+3h)

= 0.

En exploitant la fonction (3.14), nous avons

/

27r

R(2x/h) = ô(2x/h + 1)e

(2x

-2x/h

~2x/h+1/2

h

|

/

27r

R(2(1 - x)/h) = ô (2 ( 1 - x)/h + 1)e

|

(2(1 - x) )2(1-x)/h+1/2

-2(1-x)/h

h

|

|

/

27r

R(2/h + 1) =ô (2/ h+ 2)e

|

/2 )2/h+1+1/2

-2/h+1 h + 1

|

De même, nous avons

|

27r

R2(x/h) = ô2(x/h + 1)e

|

-2x/h ~x ~2x/h+1/2

h

|

|

27r

R2((1 - x)/h) = ô2(2(1 - x)/h +

1)e

|

(1 - x

-2(1-x)/h

h

|

~2(1-x)/h+1/2

|

|

27r

R2(1/h + 1) = ô2(1/h +

2)e

|

/1 + h )2(1/h+1)

-2(1/h+1)

h

|

Ainsi, nous trouvons

1 7r {x(1 - x)}-1/2 h-1/2 R(2/h +

1)R2(x/h)R2((1 - x)/h) Ah(x) = 2/

R(2x/h)R(2(1 - x)/h)R2(1/h + 1).

Enmajorantcetteexpressionpar

1,Ah(x)prenddeuxvaleursdifférentesselonlaconvergence du

rapport x/h et (1 - x)/h.

|

Ah(x) ~

|

?

????

????

|

2v 1 ð {x(1 - x)}-1/2 h-1/2 si x/h et (1 -

x)/h ? 8

22k+12(k+1)h-1

(2k+1) si x/h ou (1 - x)/h ? k.

|

Enfin, la variance est égale a

{ }

V ar bfn(x) ~

?

????

????

1 nh1/2 f(x) + O(n-1) si x/h et (1 - x)/h ?

8

2v ð {x(x - 1)}-1/2 1

ô(2k+1)

22k+1ô2(k+1)

nhf(x) + O(n-1)

1 si x/h ou (1 - x)/h ? k.

Nous évaluons l'erreur quadratique

moyenne intégrée de cet estimateur

1 2

MISE {:fii(x) }=ÿh2 {10 (1

- 2x) f' (x) + 2 x(1 - x)f" (x) } dx

1r+ 27Whð {x(x - 1)}-1/2 f (x)dx.

Nous minimisons le MISE par rapport h et nous

déterminons la fenêtre optimale hopt.

2/5

[

1 [2,/ðf o1 {x(x - 1)}-1/2 f (x)dx]

-2/5.

hopt = 42/5

f

o1(1-2x)f

'

(x)+

1

2

-

x(1-x)f

''

(x)

} dx]

De maniere similaire au noyau associé

gamma et en considérantlles mêmesrraisonspour les

quelles nous avons introduit le second estimateur a noyau

associé gamma quiccorrge le biais au

bord, nous présentons a ce, niveau le second estimateur a

noyau assocéébtta défini sur [0,1] :

|

fn(x) = 1

n

|

Xn

i=1

|

KBe(x;h)(Xi), (3.16)

|

|

avec

|

KBe(x;h)(Xi)

|

?

?????? ?

???????

|

KBe(x/h;(1-x)/h)(Xi) si x ? [2h,1 - 2h]

KBe(ñh(x);(1-x)/h)(Xi) si x ? [0,2h[

KBe(x/h;ñh(1-x))(Xi) si x ?]1 - 2h,1]

|

on ñh(x) = 2h2 + 2.5 - /4h4 +

6h2 - x2 - x/h. ?h fixé, ñh(x) est

croissante sur [0,2h]. Nous faisons tendre h vers 0 et vers 1, les

quantités au bord deviennent faibles Ainsi

nousrécupéronsjustel'expressionquisetrouvealintérieurdelintervalle.Nousrévisons

les hypotheses mis sur le noyau associé

i.[0,1] n [0,1] = [0,1] =6 Ø.

ii.?x[0,1] = [0,1].

iii.E(KBe(x/h;(1-x)/h)) = x.

iv. V ar(KBe(x/h;1-x/h)) = x(1-x)h 1+h <

8.

v. h ? 0 V ar(KBe(x/h;1-x/h)) = 0. Le biais est

égal à

|

Biais {fn(x)}

|

?

?????? ?

???????

|

2 hx(1 - x) f" (x) + o(h) si x ? [2h,1 - 2h]

æh(x)hf0(x) + o(h) si x ? [0,2h]

-æh(x)hf0(x) + o(h) si x ? [1 - 2h,1]

|

2 2/5 n

avec æh(x) = (1 - x) {ñh(x) - x/h} {1 +

hñh(x) - x}.

La variance de ce deuxieme estimateur est similaire au

premier quand x/h et (1 - x)/h

tendent vers l'infini.

V ar {1n(x)} =

1

{x(x - 1)}-1/2 f(x) + O(n-1).

2nvhð

Enfin, la fenetre optimale est

|

Comme

|

hopt =

|

[2 \1/ð f {x(x - 1)}-1/2 f

(x)dx] 2/5 ol

~nR 1 o2 ~2/5 n

o x(1 - x)f00(x) dx

|

--2/5.

|

~Zo

~2 Z 1

1 n o2

(1 - 2x)f0(x) + 1 2x(1 -

x)f00(x) dx = x(1 - x)f00(x) dx,

o

alors la fenetre optimale du premier estimateur est plus

grande que celle du second. En

remplacant la

valeur optimale de h dans l'expression du MISE nous constatons

que

|

l'erreur quadratique moyenne

intégrée trouvée dans le cas de

bfn.

|

fn est inférieure a celle de

|

|

MISE(

|

bfn) = MISE(fn).

|

c. Cas d'un noyau associe gaussien inverse

II Soit g(t) la densité de loi gaussienne inverse telle

que

,

v ~-b ~ t ~~

b

gIG(a,b)(t) = v2ðt3 exp a - 2 + a

2a

t

on t > 0 et (a,b) est un couple de deux réels

strictement positifs La figure 310 donne l'allure

générale de la densité gaussienne inverse

Si X est une variable aléatoire qui suit la loi

gaussienne inverse alors

E(X) = a et V ar(X) = a3/b.

Soit KIG(x;1/h) le noyau gaussien

inverse associé a la variable aléatoire KIG(x;1/h) défini

sur ?x,h = [0, + 8[, de parametres x et 1/h. Ce noyau associé

KIG(x;1/h) se définit comme suit:

~ -1~ t ~~

1

KIG(x;1/h)(t) = v2ðht3 x - 2 + x .

exp 2hx t

Nous vérifions chacune des hypotheses du

noyau associé i.R+ n R+ =6 Ø.

ii.?xR+ = R+.

iii.E(KIG(x;1/h)) = x.

iv. V ar(KIG(x;1/h)) = x3h < 8.

v.h ? 0 V ar(KIG(x;1/h)) = 0.

FIG. 3.10 - Allure générale de la densit

gaussienne inyerse

0 1 2 3 4 5 6

t

Inverse Geussisn(e,b)

OA 0.5 1.0 1.5 2.0

Inverse Gaussian

a=1 b=10

a=2 b=25

a=3 b=7

a=4 b=30

a=5 b=15

Ainsi le noyau KIG(x;1/h) est un noyau

associé. Les graphiques 311 et 312

présentent l'allure d'une densité gaussienne inverse

quand nous varions x et h.

Pour un échantillon de variables aléatoires iid

X1,X2, . . . ,Xn, nous considérons la

densité de probabilité f inconnue définie

continue sur R+. Soit l'estimateur

bfn de f a

noyau inverse gaussien défini sur

[0, + 00[ tel que:

|

bfn(x) = 1

n

|

Xn

i=1

|

KIG(x;1/h)(Xi)

|

|

=

|

1

n

|

Xn

i=1

|

( -1 (Xi

1

x

q2ðhX3 exp 2hx

i

|

2 +

|

~~

x ,

Xi

|

on le paramêtre h est strictement positif et x est dans

R+.

En tenant compte de ce qui était cité

précédemmentle biais est

{ } = 1

Biais bfn(x)

2x3f00(x)h + o(h),

donc

Z } Z {

Biais2 { }2

bfn(x) dx = 1 4h2

x3f00(x) dx + o(h2).

R+ R+

{ }2

Comme f x3f00(x) dx est finie

alors, pour tout x qui tend vers +00,

x3f00(x)

converge vers 0. D'oñ le biais diminue

quand x augmente.

R+

~-1 ~X1 ~~ q

x - 2 + x = ðhX3 1KIG(x;2/h)(X1),

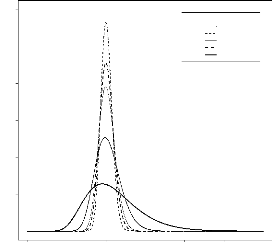

FIG. 3.11 -- Allure du noyau associe

gaussien inverse pour h = 0.1 et x varie

0 1 2 3 4 5 6

!GM m)

3A

2A 2.5

1.5

0.5 1.0

OA

Inverse Gaussian

x=1

x=2

x=3

x=4

x=5

Nous calculons la variance sur la base des calculs effectues au

prealable.

V ar {:fii(x)} = 1 E

IIKIG(x;1/h)(X1)}21+O(n-1).

L

|

~KIG(x;1/h)(X1)~2 = 1

2ðhX-3

1 exp

|

xh x

-1 (1

2 + x )1

X

X1

|

Soit KIG(x;2/h)(X1) le noyau gaussien

inverse de parametre x et 2/h associe a KIG(x;2/h) et definie sur [0,

+ 8[. Nous verifions simplement les differentes hypoteses liees a

cette variable aleatoire :

R+ n R+ Ø

ii.?xR+ = R+.

iii.E(KIG(x;2/h)) = x.

= x3 h

iv.V ar(KIG(x;2/h)) 2 < 8 .

v. h ? 0 V ar(KIG(x;2/h)) = 0.

En conclusion, il s'agit d'un noyau associe

Tout bien considers

xh x{ -1 (X1

- 2 +

v

2

KIG(x;2/h)(X1) = p2ðhX3 exp

1

Ce qui implique

OA 0.5 1.0 1.5 2.0 2.5

IGNim)

FIG. 3.12 Allure du noyau assoei gaussien

inverse pour x = 2 et h varié

Inverse Gaussian

h=0.1

h=0.2

h=0.4

h=0.7

h=0.9

0 1 2 3 4 5 6

x

et par la suite, nous avons

{ }

X-3/2

E [{KIG(x;1/h)(X1)}2i = v 1 ðhE 1

KIG(x;2/h)(X1) .

2

A partir de l'approximation de

Taylor-Lagrange nous obtenons

{ } { }

X-3/2 K-3/2

E 1 KIG(x;2/h)(X1) = E IG(x;1/h)f(KIG(x;1/h))

= x-3/2f(x) + O(h).

En conclusion, quand x > 0 se situe a

l'intérieur du support, la variance est

.

{ } x-3/2

V ar bfn(x) = v 1 n f(x) +

o(n-1h-1)

2 hð

La variance au bord, quand x/h ? k, présente

quelques différences. Elle est

égale a

,

{ } k-3/2

V ar bfn(x) = v 1 n f(x) +

o(n-1h-2)

2 hð

k étant une constante positive. L'erreur

globale de cet estimateur est

Z { }2 Z

1 1

MISE ÿ=4h2

x3f00(x) dx + v 1 x-3/2f(x)dx.

R+ 2 hð n R+

Nous cherchons a determiner le h optimal. Pour cela, nous

minimisons le MISE par rapport a h, nous trouvons

1

2

Z h R{x3 f" (x)}2 dx

1 1

2h2Or 2n

L+x-3/2f(x)dx = 0,

c'est a dire

h5/2 L+ {x3 f" (x)}2 dx = 1

1

20r n J+ x-3/2 f (x)dx.

Enfin, la fenetre optimale est

2/5

{

-2/5.

1 R o

2v R+ x-3/2f(x)dx ð

hopt = 2 /5 n

[fR+ {x3 f" (x)}2

dx1--

En l'exploitant dans la formule du MISE nous trouvons

14/5 r i 12/5

5 I

MISE(hopt) = 4 121 v ð L+ x-3/2 f (x)dx

x3 f" (x)dx n-4/5.

1 JR+

d. Cas d'un noyau associe gaussien nverse

rcciroque RIIG Nous considerons g(t) la densite de

loi gaussienne inverse reciproque

v ~-bgRIG(a,b)(t) =

v2ð exp t 2a (at - 2 + at )1

on t > 0, a > 0 et b > 0. La figure 3.13

donne l'allure generale d'une densite gaussienne inverse

reciproque. Si X est une variable aleatoire qui suit la

loi gaussienne inverse reciproque alors

|

E(X) = 1

a

|

+

|

1

b et V ar(X) = 1b + 22.

|

SoitKRIG(1/(x-h);1/h)

lenoyaugaussieninversereciproqueassociealavariablealeatoire

KRIG(1/(x-h);1/h) defini sur ?x,h = [0, + co[, de parametres 1/(x - h) et 1/h.

Ce noyau se presente comme suit :

KRIG(1/(x-h);1/h)(t) =

exp

ðht

2 + x ;h)}

2h

h t

x - h

-

1

v2

Nous commencons par verifier chacune des

hypotheses du noyau associe i.{? = [0, + co[} n {?x,h =

[0, + co[} = [0, + co[6= Ø.

ii.?x[0, + co[= [0, + co[.

iii. E(KRIG(1/(x-h);1/h)) = x-h + h = x.

iv. V ar(KRIGo./(x-h)0./h)) = (x - h)h + 2h2 = xh +

h2 < co. v.h ? 0 V ar(KRIG(1/(x-h);1/h)) = 0.

FIG. 3.13 -- Allure generale de la densite

gaussienne inverse réeiirrque

Reciprocal Inverse Gaussian

a=1 b=10

a=2 b=25

a=3 b=7

a=4 b=8 a=0.5 b=5

5

4

3

2

Reciprocal Inverse Gaussian

0 1 2 3 4 5 6

t

Ainsi toutes les conditions du noyau associé

sont satisfaites.

Soit X1,X2, ...,Xn l'échantillon de variables

aléatoires i.id. de densité de probabilité f

b

inconnue définie continue sur ? = R+. Nous

considérons l'estimateur fn de f noyau gaussien

inverse réciproque défini sur [0, + 8[ tel

que

|

bfn(x) = 1

n

|

i=1

|

KRIG(1/(x-h);1/h)(Xi)

|

1

n

=

Xn

i=1

1 x - h (Xi2 x -

v2ðhXi exp 1 2h x - h + Xi) ,

avec h > 0 et x ? R+.

En tenant compte des résultats obtenus

précédemment

Biais {:fii(x) } = 21 x f" (x)h + o(h),

et donc

FIG. 3.14 -- ????r? ?? ?\u9313‡A?? ?ss??e

???ss??? ????rs? ré???rq?? ??r x

= 2 ?t h ??r?e

MOO /10

3A

2A 2.5

1.5

0.5 1.0

OA

Reciprocal Inverse Gaussian

h=0.1 h=0.2 h=0.4 h=0.7 h=0.9

0 1 2 3 4 5 6

x

En refaisant les calculs de la variance de la même

facon nous trouvons

si x/h ? 8 si xfi.1 k.

V ar {fn(x)} ~

|

?

????

????

|

1 x -1/2f

|

(x) + O(n-1)

+ 7 k3/2) + O(n-1)

' 16

|

|

2nvhð

1 (k-1/2

|

|

2nhvð

|

La fenêtre optimale est egale à

|

hopt =

|

( 1 )2/5 {L#177; x-1/2f

(x)dx}2/5

200

[fR#177; {xf"(x)}2 dx12/5

|

n-2/5.

|

En conclusion, nous evaluons le MISE en fonction de cette valeur

hopt:

M I S E(hopt) = #177; (20r)

1 2/5 {fly

[fR#177; {xf"(x)}2 dx]

x-1/2f (x)dx 12/5

2/5 n-2/5.

e. Remarques:

i. ????? ?? s???rt ?? ?\u9313‡A?? ?ss??e ?x,h ??

?e???? ??s ?? ?? x ?? ?? h ??rs ?e?

?\u9312‡@?????s q?? ??s ???s

tr??té?

ii. ???s ???\u9312‡@?r?ss?? ?? ??

???êtr? ?t?????? ?? ???s?it ?????? f ?t s?

?ér??é? s????????r??t ???s ?? ???er?t??r ?t ??

?e???er?t??r ??tr??r????t ?? ??a

\u9313‡A?éet?i?? o f s? tr???

s???????t ?? ?e???er?t??r ?? ??s ????s ???i? ???nne ???????

?nt? ? ?a s\u9313‡A?etr?q?? ?t

?s\u9313‡A?etr?q??? ??rs ??r

????ttr? ? ?ée??? ?"??????? ???? ?ée??????st???t?? ??

??r??etr? h? f ??t

s\u9313‡Aste??t?q?????t s???r? ??? ?? ??t????

?a\u9313‡A?é? tr?q?? ??

s???rt R? P?r ?\u9312‡@?????? ???s ?? ??s ??s

?\u9313‡A??\u9312‡@ ?ss??és ?????? ???ss???????rs?

?t ???ss??? ????rs? re???rq??? ??s

???s?s ?? f s??t ??? ??

?s\u9313‡A?etr?q???e??? s?r R+? ???s ??

??s ??s ?\u9313‡A??\u9312‡@ ?ss??es ?êt?? ?? ???s?it

??i ???nne ? ?? ???or [0,1]?

|