|

UNIVERSITE DE DOUALA UNIVERSITY OF DOUALA

Facultédes Sciences Faculty of Sciences

Département de Maths-Info Department of Mathematics and

CS

APPRENTISSAGE SUR DES DONNÉES

ACADÉMIQUES EN

VUE DE FACILITER

L'ORIENTATION ET L'AIDE À LA DÉCISION

Mémoire rédigéen vue de

l'obtention du diplôme de Master II

en informatique

Présentéet soutenu par:

NJAMEN MOUNGNUTOU ZELKIFILOU 21S65508

Sous l'encadrement de:

Douala, 2021

Dr NOUMSI Auguste. CC

4 Résumé4

De nos jours, la quasi-totalitédes systèmes des

établissements scolaires sont informatisés. Ce qui permet la

collecte et le stockage en leur sein des données issues de la gestion

des processus académiques, disciplinaires, administratifs et même

financiers. Les données ainsi collectées au cours de chaque

année permettent le contrôle des activités et la production

des effets académiques. Cependant, lorsqu'elles sont accumulées

sur plusieurs générations, elles constituent un réservoir

qui peut servir pour l'aide à la décision. Les perspectives en ce

sens sont nombreuses : la gestion courante, la compréhension des

facteurs d'échec ou du succès, l'impact de la discipline sur le

succès, l'orientation scolaire etc. Compte tenu de la raretédes

conseillers d'orientation, malgrél'importance de cette activité,

nous proposons dans ce mémoire une solution automatisée d'aide

à la décision pour l'orientation scolaire. Notre démarche

va s'appuyer sur l'existence des données collectées au fil des

années pour construire un système d'aide à la

décision.

Mots clés : Machine Learning,

Système de recommandation, classification, prédiction,

orientation, aide de décision...

4 Abstract 4

Nowadays, almost all school systems are computerised. This

allows the collection and storage of data from academic, disciplinary,

administrative and even financial processes. The data collected in this way

during each year allows the monitoring of activities and the production of

academic effects. However, when accumulated over several generations, they

constitute a reservoir that can be used to assist decision-making. The

perspectives in this sense are numerous: current management, understanding the

factors of failure or success, the impact of discipline on success, school

orientation, etc. Given the scarcity of guidance counsellors, despite the

importance of this activity, we propose in this dissertation an automated

decision support solution for school orientation. Our approach is based on the

existence of data collected over the years to build a decision support

system.

Keywords : Machine Learning, Recommender

system, classification, prediction, orientation, decision support...

4 Dédicace 4

Je dédie ce mémoire à ma famille et à

toutes mes connaissances.

4 Remerciements 4

Au terme de ce travail, nous exprimons notre gratitude infinie

à tous ceux qui ont participéde près ou de loin par leurs

encouragements et précieux conseils ou suggestions rendant possible ce

travail, Nous pensons notamment à:

· Pr. Marie Joseph NIDA NTAMAK Doyen de la

Facultédes Sciences pour le travail qu'elle fait pour que cette

institution soit toujours parmi les meilleurs.

· Pr. BOWONG Samuel chef de département de

Maths-Info de l'universitéde Douala pour tout ce qu'il fait pour les

étudiants en général.

· mon encadreur Dr. Auguste NOUMSI pour sa

disponibilitéillimitée, son soutien inconditionnel, sa constante

bienveillance et les mille critiques apportées pour améliorer ce

travail.

· Dr. Joseph MVOGO, Coordinateur du Laboratoire

d'informatique appliquée pour ses encouragements, ses critiques

scientifiques et sa rigueur.

· Je tiens à remercier sincèrement les

membres du jury qui me font l'immense honneur de juger et d'apprécier ce

travail.

· Je tiens à remercier chaleureusement mes

enseignants Dr Auguste NOUMSI, Dr MOSKOLAI, Dr MVOGO, M. DJEMEN pour les

précieux conseils et enseignements prodigués et la patience dont

ils avaient avec nous.

· Je remercie sincèrement Dr KAMENI E. de l'ENS

de Yaoundésans oublier Dr Victor LOUMGAM de l'Universitéde

YaoundéI et Patrick KENFACK du côtéde la Russie. pour leur

disponibilitéà répondre à mes questions et

sollicitations.

· Je remercie mes camarades, en particulier Taga

Martial, DONGMO APOLINAIRE et tous les autres pour leur esprit de

solidarité, de disponibilitéet de convivialitéqui nous ont

unis durant cette année d'études.

v

4 Table des matières 4

Résuméi

Dédicace iii

Remerciements iv

Liste des tableaux ix

Table des figures xi

INTRODUCTION 1

1 L'ORIENTATION SCOLAIRE 5

1.1 Introduction 5

1.2 Historique de l'orientation scolaire 5

1.3 Les niveaux d'orientation scolaire 6

1.4 Processus d'orientation au Cameroun 7

1.4.1 Les différents tests pour l'orientation 8

1.4.1.1 Le test BV11 8

1.4.1.2 Le test KRX 8

1.4.1.3 Le test PRC 9

1.4.1.4 Le test MECA 9

1.4.1.5 Le test D48 10

1.4.2 Le Tracédes Profils Psychologiques 10

1.5 Conclusion 13

2 REVUE DE LA LITTÉRATURE 14

2.1 Introduction 14

TABLE DES MATIÈRES TABLE DES MATIÈRES

2.2 Le Machine Learning (Apprentissage Automatique) 14

2.2.1 Les Types d'apprentissages 16

2.2.1.1 Apprentissage supervisé 16

2.2.1.2 Apprentissage non supervisé 18

2.2.1.3 Apprentissage par renforcement 19

2.3 Les Algorithmes de Machine Learning 19

2.3.1 Algorithmes de Classification 23

2.3.2 Classification Naïve Bayésienne 23

2.3.3 Algorithme des K-PPV (K-Plus Proches Voisins) ou en

anglais KNN

(K-Nearest Neighbors) 24

2.3.3.1 Principe du K-PPV 25

2.3.3.2 Avantages de la méthode des K-PPV 26

2.3.3.3 Inconvénients de la méthode des K-PPV

26

2.3.4 Les Arbres de décision 26

2.3.4.1 Généralités sur les arbres de

décision 26

2.3.4.2 Construction d'un arbre de décision 29

2.3.4.3 Avantages des Arbres de Décision 30

2.3.4.4 Inconvénients des Arbres de Décision

30

2.3.5 Machines à vecteurs support SVM 30

2.3.5.1 Le Principe des SVMs 31

2.3.5.2 Le SVM Linéaire 32

2.3.5.3 Cas linéairement séparable 33

2.3.5.4 Avantages de SVM 34

2.3.5.5 Inconvénients de SVM 35

2.3.6 Les Réseaux de neurones 36

2.3.6.1 Neurone Biologique 36

2.3.6.2 Les Réseaux de Neurones 36

2.3.6.3 Neurone formel (artificiel) 37

2.3.6.4 Fonctions d'activation 38

2.3.6.5 Les réseaux de neurones célèbres

39

2.3.6.6 Le Perceptron 40

2.3.6.7 Le perceptron multicouches 41

2.3.6.8 L'apprentissage 41

Mémoire de Master II en Informatique vi c~NJAMEN M.

ZELKIF 2020-2021

Mémoire de Master II en Informatique vii c~NJAMEN M.

ZELKIF 2020-2021

TABLE DES MATIÈRES TABLE DES MATIÈRES

|

|

2.3.6.9 Avantages des réseaux de neurones

2.3.6.10 Inconvénients des réseaux de neurones

|

42

43

|

|

2.4

|

État de l'art du ML appliquéà

l'éducation

|

44

|

|

|

2.4.1 Les travaux connexes

|

44

|

|

|

2.4.1.1 Dans le monde

|

44

|

|

|

2.4.1.2 Au Cameroun

|

47

|

|

|

2.4.2 L'aide à la décision

|

48

|

|

2.5

|

Conclusion

|

48

|

3

|

DÉMARCHE MÉTHODOLOGIQUE

|

50

|

|

3.1

|

Cahier de charge (Objectif visé)

|

51

|

|

3.2

|

L'acquisition (Collecte) des données

|

51

|

|

3.3

|

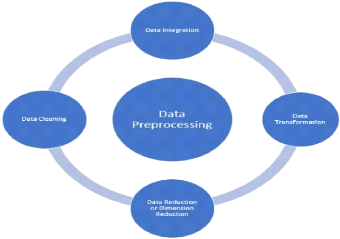

Pré-traitement des données

|

53

|

|

|

3.3.1 Nettoyage des données

|

54

|

|

|

3.3.2 Transformation des données

|

56

|

|

|

3.3.3 Intégration des données

|

57

|

|

|

3.3.4 Réduction des données

|

57

|

|

3.4

|

Modélisation de l'entrepôt de données

|

58

|

|

|

3.4.1 Les modèles logiques d'un entrepôt

|

58

|

|

|

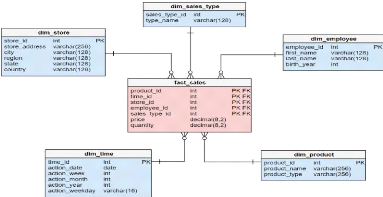

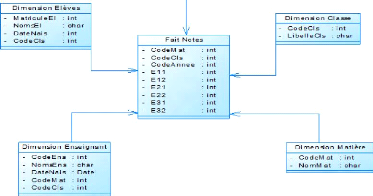

3.4.1.1 Le Modèle en Étoile

|

59

|

|

|

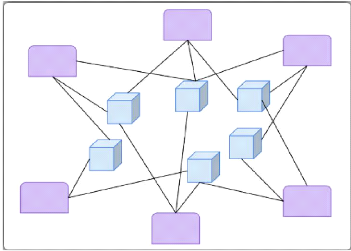

3.4.1.2 Le Modèle en Flocon

|

59

|

|

|

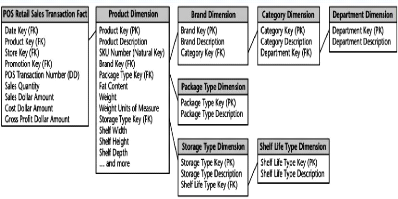

3.4.1.3 Le modèle de galaxie (Constellation)

|

60

|

|

|

3.4.2 Modèle type de l'entrepôt des

données

|

62

|

|

|

3.4.3 Structure multidimensionnelle

|

62

|

|

3.5

|

Classification

|

63

|

|

3.6

|

Conclusion

|

64

|

4

|

RÉSULTATS ET DISCUSSIONS

|

65

|

|

4.1

|

Introduction

|

65

|

|

4.2

|

Les différentes techniques d'évaluations des

modèles de Machine Learning .

|

65

|

|

|

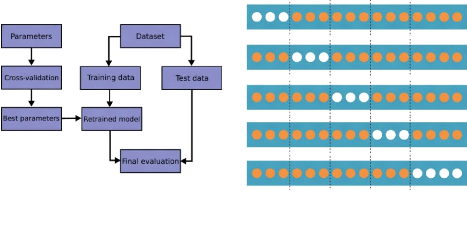

4.2.1 Validation Croisée

|

66

|

|

|

4.2.1.1 La méthode holdout

|

67

|

|

|

4.2.1.2 La méthode K-Folds

|

68

|

|

|

4.2.1.3 La méthode LOOCV

|

68

|

|

TABLE DES MATIÈRES TABLE DES MATIÈRES

Mémoire de Master II en Informatique viii c~NJAMEN M.

ZELKIF 2020-2021

4.2.2 La matrice de confusion 69

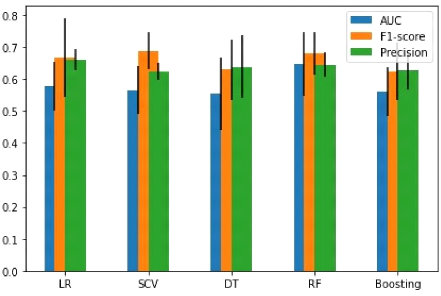

4.3 Résultat et Discussion 70

4.4 Conclusion 72

CONCLUSION ET PERSPECTIVES 73

Références 78

ix

4 Liste des tableaux 4

1.1

|

Dans cet exemple l'idée est de présenter la

mésentente

|

8

|

2.1

|

Similitude entre un Neurone biologique et un Neurone formel

|

38

|

2.2

|

Machine learning Algorithmus

|

43

|

4.1

|

Exemple d'une Matrice de Confusion

|

69

|

4.2

|

Synthèse des différents Résultats obtenus

|

71

|

|

x

4 Table des figures 4

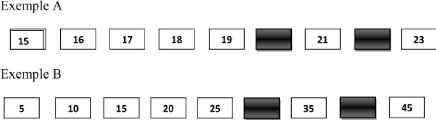

1.1 Illustration d'un exercice de KRX (Test de raisonnement

numérique) . . . 9 1.2 Illustration d'un exercice de MECA (Test de

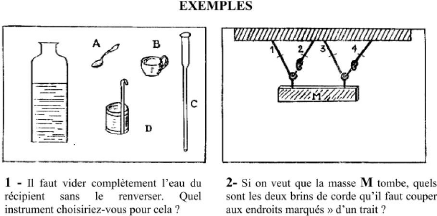

raisonnement Mécanique) . . 10

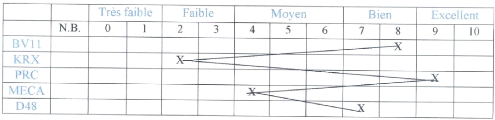

1.3 Exemple 1 : de Profil 11

1.4 Exemple 2 : de Profil 11

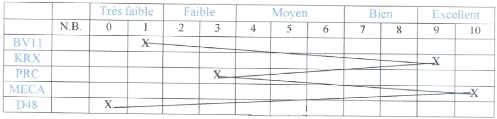

1.5 Exemple 3 : de Profil 12

1.6 Exemple 4 : de Profil 12

1.7 Exemple 5 : de Profil 12

2.1 Illustration du Cadre de l'apprentissage par renforcement

20

2.2 Résuméen image des classes d'apprentissage

20

2.3 Exemple de classification avec un KPPV 25

2.4 Exemple de classification avec les Arbres de

Décision 28

2.5 Exemple de classification avec les Arbres de

Décision 29

2.6 Exemple de classification avec SVM 31

2.7 Hyperplan optimal, marge et vecteurs de support 32

2.8 Exemple de classification avec SVM dans le cas non

séparables 35

2.9 Neurone biologique 36

2.10 Modèle d'un neurone formel (artificiel) 37

2.11 Les fonctions d'activation 39

2.12 Un exemple de perceptron 40

2.13 Un perceptron multicouche 42

2.14 Un autre exemple de perceptron multicouche 42

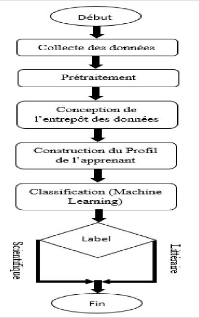

3.1 Schéma de la démarche méthodologique

50

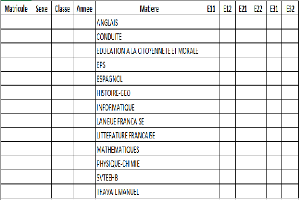

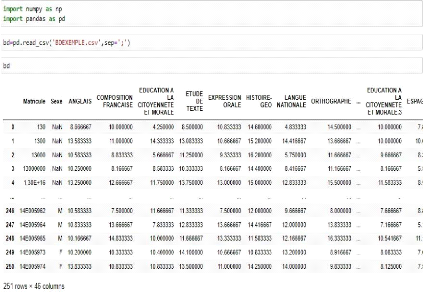

3.2 Représentation des données après

requêtes SQL 52

3.3 Processus d'acquisition et Pré-traitement des

données 54

Mémoire de Master II en Informatique xi c~NJAMEN M.

ZELKIF 2020-2021

TABLE DES FIGURES TABLE DES FIGURES

3.4

|

Processus de prise de décision

|

59

|

3.5

|

Schéma d'un entrepôt de données en

étoile : tiréde Cartelis [1]

|

60

|

3.6

|

Exemple de dimension représentée en flocon

(Kimball, Ross, 2008, p.55) . .

|

60

|

3.7

|

Structure de la Base d'exemple (Data Frame)

chargéà l'aide de Python . .

|

61

|

3.8

|

Modèle type de l'entrepôt des données

|

62

|

3.9

|

Modèle type de l'entrepôt des données

|

63

|

4.1

|

Validation croisée : évaluation des performances

de l'estimateur

|

67

|

4.2

|

Exemple K-Folds pour la Cross Validation

|

67

|

4.3

|

Diagramme des résultats

|

71

|

|

1

4 INTRODUCTION 4

Selon Wikipédia [2], L'orientation scolaire et

professionnelle, universitaire et de carrière consiste à proposer

à une personne en âge de scolaritéet même aux adultes

(obligatoire ou post-obligatoire, voire permanente ou continue) les

différentes filières dans lesquelles elle pourrait

s'insérer en fonction de ses intérêts, de son parcours

scolaire antérieur, et de sa personnalité.

Le conseiller d'orientation est un professionnel de

l'éducation dont le rôle est d'assurer le suivi

psycho-pédagogique des élèves, d'informer les membres de

la communautéédu-cative sur les réalités du monde

scolaire, les possibilités de formation et leur débouchés

professionnels. À cet égard, il aide les élèves

à faire des choix scolaires et professionnels judicieux et

cohérents en tenant compte de leurs aptitudes, de leurs

intérêts, de leurs attitudes et des réalités du

monde du travail. Pour y parvenir, il fait usage d'un ensemble d'ou-tils, dont

la batterie de tests d'aptitudes pour la classe de 3e du MINESEC-CAMEROUN

[3].

Au cours de ces dernières années, nous avons

observéune forte informatisation des établissements des

systèmes éducatifs. Face à cette numérisation des

données des systèmes éducatifs, il nait le besoin

d'automatiser certaines tâches qui, sont d'une importance capitale dans

la concrétisation des objectifs de l'éducation qui ne sont rien

d'autres que la réussite scolaire. Ainsi, cette réussite commence

par une bonne orientation. Cependant, automatiser la tâche d'orientation

revient à résoudre un problème de prédiction ou de

recommandation. D'oùl'importance de donner au système

éducatif la capacitéd'apprendre à recommander à

partir des exemples existants sans être explicitement programmé.

Cette façon de faire est appelée Machine Learning (Apprentissage

Automatique).

même s'il est actuellement dopépar les nouvelles

technologies et de nouveaux usages, le machine Learning n'est pas un domaine

d'étude récent. On en trouve une première

définition dès 1959, due à Arthur Samuel, l'un des

pionniers de l'intelligence artificielle,

TABLE DES FIGURES TABLE DES FIGURES

Mémoire de Master II en Informatique 2 c~NJAMEN M. ZELKIF

2020-2021

qui définit le machine Learning comme « le

champ d'étude visant à donner la capacitéàune

machine d'apprendre sans être explicitement programmée

». En 1997, ~Eric and Michel

[4], de l'universitéde Carnegie Mellon, propose une

définition plus précise : « A computer program is said

to learn from experience E with respect to some class of tasks T and

performance measure P, if its performance at tasks in T, as measured by P,

improves with experience E ».

Les systèmes de recommandation (SR) sont des outils

logiciels basés sur l'apprentissage automatique (Machine Learning) et

les techniques de récupération des informations (Data Mining) qui

fournissent des recommandations pour des éléments potentiellement

utiles dans l'intérêt de quelqu'un selon Nguyen et al. [5]. Ils

sont largement utilisés dans de nombreux domaines, en particulier dans

le commerce électronique. Récemment, ils sont également

appliqués dans des tâches d'apprentissage en ligne telles que

recommander des ressources (par exemple, des articles, des livres) aux

apprenants (étudiants) et même des cours en fonction de leur

performance et préférence comme dans Hanaa et al. [6].

Compte tenu de la raretédes conseillers d'orientation,

malgrél'importance de cette activité, nous proposons dans ce

mémoire une solution automatisée d'aide à la

décision pour l'orientation scolaire.

Les systèmes d'orientation aujourd'hui se basent sur

plusieurs critères pour orienter les élèves en classe

scientifique ou littéraire. Ces critères sont : l'acquisition

scolaire qui est la moyenne des notes obtenues dans les matières par

groupe en classe de 3 ème; sur la batterie de tests d'aptitudes pour la

classe de 3 ème; sur les préférences des parents et de

l'élève et enfin de la disponibilitédes places dans

l'établissement pour les classes sollicitées. Cependant,

d'année en année nous remarquons une baisse du taux de

réussite des élèves aux examens officiels. Cette baisse du

taux de réussite est dûen majoritéà une mauvaise

orientation scolaire. Face à ce problème, beaucoup ont

tentés de proposer des systèmes de recommandation basésur

le profil de l'apprenant et de ses préférences dans un

système de e-learning. Comment appliquer l'apprentissage

automatique dans la recommandation des choix de série dans

l'enseignement?

Fort du constat fait sur l'importance des TIC dans

l'enseignement-apprentissage, et de l'importance d'une bonne orientation dans

le système éducatif, la présente étude tente de

répondre à la question fondamentale suivante :

Comment faire une bonne orientation

(recommandation) en tenant compte du profil de l'apprenant? Pour

mieux appréhender cette question, il a

TABLE DES FIGURES TABLE DES FIGURES

Mémoire de Master II en Informatique 3 c~NJAMEN M. ZELKIF

2020-2021

étéformulédeux questions qui lui sont

spécifiques :

· Quel profil d'apprenant pour quelle orientation?

· Quelle technique mettre en place afin de pouvoir faire

une bonne recommandation et ainsi appuyer la décision du conseiller

d'orientation?

L'objectif principal de notre recherche est de

produire un modèle d'ap-prentissage sur des données

académiques en vue de faciliter l'orientation et l'aide à la

décision. Étant donnéla quasi inexistence

d'une base d'exemple selon le contexte éducatif camerounais, nous

pouvons donc subdiviser cet objectif en plusieurs sous-objectifs qui suivent

:

1. Construction d'une base d'exemple permettant d'effectuer

l'apprentissage automatique;

2. Proposition d'un modèle d'apprentissage à

partir de la base d'exemple construite.

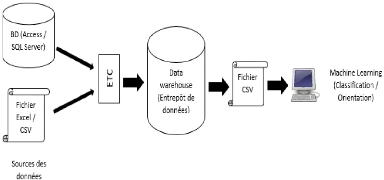

En ce qui concerne la méthode de travail, nous allons

construire un data-set (ensemble de données pour l'apprentissage ou

l'entrepôt de donnée) à partir des données

récoltées dans différents établissements scolaires

du Cameroun, labelliser ces données dans un cadre utiles pour la

recommandation de l'orientation scolaire puis, appliquer les algorithmes de

classifications existants et utilisés dans le Machine Learning

déçu pour la création d'un modèle d'apprentissage.

Ce data-set sera ouvert publiquement afin de permettre le développement

d'algorithme de plus en plus sophistiquépour l'orientation scolaire au

Cameroun.

Comme résultats attendus, à la fin de ce

mémoire, nous proposerons un Framework pour la recommandation et

l'orientation scolaire basésur le profil de l'apprenant.

Notre travail est subdiviséen quatre grands

chapitres.

· Chapitre 1 : L'orientation Scolaire qui

présente le travail du conseiller d'orientation et du processus

d'orientation au Cameroun.

· Chapitre 2 : L'état de l'art qui

présente les travaux qui ont étéfait dans le Machine

Learning appliquéà l'orientation tant à l'international

qu'au niveau national.

· Chapitre 3 : Démarche méthodologique qui

présente la démarche suivit pour arriver à la solution. En

outre, la conception de l'entrepôt des données.

·

TABLE DES FIGURES TABLE DES FIGURES

Mémoire de Master II en Informatique 4 c~NJAMEN M. ZELKIF

2020-2021

Chapitre 4 : Résultat et Discussion qui présente

la performance du modèle choisi obtenue sur le jeu de données et

une discussion sur ce résultat.

· Conclusion et Perspectives qui conclu ce travail de

recherche et ouvre des nouvelles perspectives futures.

5

L'ORIENTATION SCOLAIRE

1.1 Introduction

L'orientation, disent Guichard and Huteau [8]

désigne à la fois les modalités de production et de

reproduction de la division sociale et technique du travail et l'action de

donner une direction déterminée à sa vie... «

Scolairement, c'est conseiller un enfant sur le métier qu'il peut

choisir » selon Chassagne [9]. L'orientation concerne les jeunes, leurs

familles, de nombreux adultes qui doivent dans leur vie professionnelle se

reconvertir. Elle est également au coeur des politiques

d'éducation et d'emploi parce que l'école doit fournir à

l'économie le personnel qualifiédont elle a besoin. Aussi la

question de l'orien-tation occupe-t-elle depuis plus de cinquante ans une place

majeure dans les décisions d'organisation du système

éducatif. D'oùl'importance de l'étudier dans ce

chapitre.

1.2 Historique de l'orientation scolaire

À la fin du XIXe et au début

du XXe siècle l'orientation est définie dans

son rapport avec l'appartenance sociale de l'élève. Il existe

deux filières : la première « primaire supérieure

» qui débouche sur le certificat d'études et sur les

écoles primaires supérieures est réservée aux

enfants du peuple, la seconde « secondaire supérieure »,

réservée à la future élite, conduit au

baccalauréat et à l'université. À cette

époque le choix d'orienta-tion ne se posait pas parce que l'école

primaire conduisait à un métier. C'est en 1910 que l'orientation

apparaît et en 1922 qu'un décret définit ses

caractéristiques : « il s'agissait de s'occuper des jeunes filles

et jeunes gens cherchant un placement dans le commerce ou l'industrie »

selon Chassagne [10].

À cette époque on parle de l'orientation

professionnelle. Ce décret demande :

1.

1.3. LES NIVEAUX D'ORIENTATION SCOLAIRE CHAPITRE 1. L'ORIENTATION

SCOLAIRE

Mémoire de Master II en Informatique 6 c~NJAMEN M. ZELKIF

2020-2021

la délivrance d'un certificat d'orientation

professionnelle sur lequel doivent figurer les capacités des jeunes

gens;

2. la création d'un centre d'orientation

professionnelle par département, à la charge du

département.

L'orientation scolaire, constate Jean-Michel [11], fait son

apparition avec la loi de 1959. C'est la réforme scolaire de 1959

(appelée Réforme Berthoin) qui, en instituant un cycle

d'observation et d'orientation après le CM2, fait entrer l'orientation

dans le champ scolaire. Avec la poursuite des études jusqu'à16

ans, le palier d'orientation est déplacédu CM2 à la

cinquième. En fonction de leurs aptitudes évaluées

à la fin de ce cycle d'observation, les élèves devaient

être orientés dans cinq filières : un enseignement

général long, classique pour les futurs cadres; un

enseignement terminal court destinéaux futurs ouvriers

spécialisés, agriculteurs, artisans; un enseignement technique

long

destinéaux techniciens supérieurs, un

enseignement technique court destinéà former des ouvriers

qualifiés et enfin un enseignement général court

délivrédans un nouveau collège, le collège

d'enseignement général. De nos jours, l'orientation scolaire se

fait à cinq niveaux: après le CM2, après la classe de

cinquième, après la troisième, après la seconde,

après le Baccalauréat et des fois après la classe de

première.

1.3 Les niveaux d'orientation scolaire

L'orientation scolaire s'opère en trois temps :

· en troisième, premier palier d'orientation :

les élèves sont amenés à choisir entre trois voies

: filière générale, technologique ou professionnelle;

· en seconde, pour ceux qui se sont orientés en

lycée général ou technologique, deuxième palier

d'orientation : les demandes de passage en première

générale (S, ES, L) ou en première technologique (STT,

STI, SMS, STL);

· en terminale, troisième palier d'orientation :

après leur bac, les élèves intègrent soit les

filières plus sélectives comme CPGE, IUT, STS, ou les

filières universitaires.

Dans cette partie nous allons présenter uniquement le

premier niveau (celui qui se fait en troisième) en utilisant la batterie

de tests d'aptitudes pour la classe de

3ème du MINESEC-CAMEROUN [3].

1.4. PROCESSUS D'ORIENTATION AU CAMEROUN CHAPITRE 1.

L'ORIENTATION SCOLAIRE

Mémoire de Master II en Informatique 7 c~NJAMEN M. ZELKIF

2020-2021

La fin de la troisième représente le premier

palier d'orientation et propose aux collégiens plusieurs choix : seconde

générale et technologique, seconde professionnelle ou

redoublement. Ils peuvent aussi poursuivre leur formation initiale en

apprentissage ou, s'ils ont atteint l'âge de fin de la

scolaritéobligatoire, interrompre définitivement leurs

études. Dans la carrière scolaire d'un élève, les

phases d'orientation de fin de troisième et de fin de seconde

constituent des moments essentiels. À la fin de troisième

l'élève doit choisir entre voie professionnelle et voie

générale. Les décisions d'orientation prises à

l'is-sue de ces deux classes préfigurent largement le bagage scolaire

avec lequel le jeune va terminer sa formation initiale et s'insérer sur

le marchédu travail.

1.4 Processus d'orientation au Cameroun

Le conseiller d'orientation est un professionnel de

l'éducation dont le rôle est d'assurer le suivi

psycho-pédagogique des élèves, d'informer les membres de

la communautéédu-cative sur les réalités du monde

scolaire, les possibilités de formation et leur débouchés

professionnels. À cet égard, il aide les élèves

à faire des choix scolaires et professionnels judicieux et

cohérents en tenant compte de leurs aptitudes, de leurs

intérêts, de leurs attitudes et des réalités du

monde du travail. Pour y parvenir, il fait usage d'un ensemble d'ou-tils, dont

la batterie de tests d'aptitudes pour la classe de 3e du MINESEC-CAMEROUN

[3].

Toujours dans selon MINESEC-CAMEROUN [3], lors des missions

de suivi, d'encadre-ment et d'évaluation des activités des

Conseillers d'orientation en service dans les établis-

sements d'enseignements secondaire général,

technique et professionnel, il a étéconstatéque ces tests

n'étaient pas utilisés dans de nombreux établissements.

Plusieurs conseillers

ayant sollicités un outil d'accompagnement, il nait la

batterie de tests d'aptitudes pour la classe 3e.

Cet outil est constituéde cinq tests psychotechniques

destinés aux élèves des classes de Troisième et

Form III toujours selon MINESEC-CAMEROUN [3].

Il s'agit du : BV11, KRX, PRC, MECA et du D48.

1.4. PROCESSUS D'ORIENTATION AU CAMEROUN CHAPITRE 1.

L'ORIENTATION SCOLAIRE

Mémoire de Master II en Informatique 8 c~NJAMEN M. ZELKIF

2020-2021

1.4.1 Les différents tests pour l'orientation

1.4.1.1 Le test BV11

BV11 est un test de raisonnement verbal, permettant

d'évaluer la compréhension du vocabulaire. Ce test s'effectue en

20 min ; il permet aussi d'évaluer la capacitéd'un

élève à analyser un mot afin de trouver sa signification

ou sa définition et de dégager le type de similitude entre

plusieurs mots. En outre il aide l'élève à

apprécier l'étendue de son vocabulaire et la précision de

ses connaissances lexicales.

dans ce test nous avons 56 séries de mots. Chaque

série se compose de six mots qui véhiculent la même

idée.

L'exercice consiste d'abord à trouver l'idée

partagée par les mots de la série et ensuite, étant

donnécette idée, trouver le mot qui ne partage pas cette

idée et qui ne devrait pas être inclus dans cette série.

Une fois que vous avez découvert le mot qui ne devrait pas

apparaître dans la série, étant donnél'idée

que véhicule la série, vous cochez la lettre qui

représente ce mot sur la feuille de réponses en respectant le

numéro de l'item. Exemple :

A

|

B

|

C

|

D

|

E

|

F

|

Rupture

|

Brouille

|

Conciliation

|

Discorde

|

Désaccord

|

Désunion

|

|

Tableau 1.1 - Dans cet exemple l'idée

est de présenter la mésentente

1.4.1.2 Le test KRX

KRX est un test de raisonnement numérique, qui permet

d'identifier les aptitudes du sujet dans la manipulation des chiffres. Toujours

en 20 min ;

L'exercice consiste à identifier la logique qui

régit la série afin de déterminer les nombres qui manquent

en utilisant pour la plupart les opérations de base (addition,

soustraction, multiplication, division). Il arrive aussi que la progression

utilise la propriétédes nombres (nombres pairs ou impairs,

multiples, nombres premiers, ...).

les autres test sont également dans le document fourni

par le MINESEC-CAMEROUN [3] conçu spécialement pour

l'orientation.

1.4. PROCESSUS D'ORIENTATION AU CAMEROUN CHAPITRE 1.

L'ORIENTATION SCOLAIRE

Mémoire de Master II en Informatique 9 c~NJAMEN M. ZELKIF

2020-2021

Figure 1.1 - Illustration d'un exercice de KRX

(Test de raisonnement numérique).

Tirée de MINESEC-CAMEROUN

[3].

1.4.1.3 Le test PRC

PRC est un test de compréhension verbale abstraite,

qui permet de mesurer la finesse de compréhension des proverbes et des

maximes et de déterminer la capacitéde décryptage des

messages et le sens de la nuance en 25 min ; il aide les élèves

à apprécier leurs niveaux de compréhension de la langue et

leurs capacités à analyser le sens d'une phrase, d'une

pensée, d'un proverbe, etc. pour faire ressortir le sens réel et

non le sens littéral.

Comme consigne : Vous avez un proverbe donné, suivi de

cinq phrases sensées être plus proches de la signification

réelle du proverbe. L'exercice consiste à trouver parmi les cinq

phrases celle qui explique le mieux le proverbe. Une fois cela fait, vous

transcrivez la lettre qui représente cette phrase sur la feuille de

réponses, en respectant le numéro de l'item : Exemple. UN

CHEF ALLANT VENDRE SON ESCLAVE FUT VENDU PAR CE DERNIER signifie:

· Un jour on est maître, un jour on est esclave.

· La sociétéest indifférente aux

classes sociales.

· Quand on est esclave, c'est pour la vie.

· Les situations peuvent se renverser

complètement.

· Le patron d'aujourd'hui peut travailler chez son

ouvrier.

1.4.1.4 Le test MECA

Le test Mécanique (MECA) : C'est le test de

raisonnement mécanique il permet de mesurer la capacitéd'observer

et de compréhension des schémas techniques toujours en 25 min ;

Exemple voir figure 1.2

1.4. PROCESSUS D'ORIENTATION AU CAMEROUN CHAPITRE 1.

L'ORIENTATION SCOLAIRE

Mémoire de Master II en Informatique 10 c~NJAMEN M.

ZELKIF 2020-2021

Figure 1.2 - Illustration d'un exercice de

MECA (Test de raisonnement Mécanique).

Tirée de

MINESEC-CAMEROUN [3].

1.4.1.5 Le test D48

D48 est un test de facteur G, il mesure le sens de la logique

chez le sujet en 25 min.

1.4.2 Le Tracédes Profils Psychologiques

Au vu des résultats aux différents tests, et

sur la base d'un étalonnage réalisésur un

échantillon de la population globale à laquelle appartiennent les

sujets, le Conseiller d'orientation inscrit les résultats de chaque

candidat dans un tableau qui comporte les différentes catégories

d'appréciations. Le score obtenu dans un test correspondra à une

catégorie dans le tableau de l'étalonnage. Il peut alors tracer

une courbe qui relie ces catégories aux différents tests. C'est

ce tracéqui est le profil psychologique du sujet. Le profil

psychologique peut aussi se présenter sous la forme d'un histogramme.

Nous présentons ici quelques exemples de profils parmi

des milliers de cas possibles et leurs interprétations selon

MINESEC-CAMEROUN [3] :

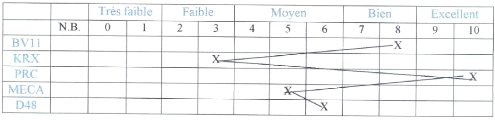

Le sujet présente un potentiel réel dans le

raisonnement verbal, et la compréhension de texte. En revanche, des

insuffisances apparaissent dans le raisonnement numérique. L'on peut

donc redouter des difficultés en mathématiques. Par ailleurs, le

raisonnement

1.4. PROCESSUS D'ORIENTATION AU CAMEROUN CHAPITRE 1.

L'ORIENTATION SCOLAIRE

Figure 1.3 - Exemple 1 : de Profil

mécanique est moyen et le facteur G est

développé.

Un tel profil met en évidence des aptitudes dans le

domaine littéraire, si les résultats scolaires le confirment.

Figure 1.4 - Exemple 2 : de Profil

Ici le sujet présente un potentiel important dans le

raisonnement spatial. En revanche, d'importantes limites apparaissent dans le

raisonnement verbal, la compréhension d'un texte et le raisonnement

général. Ce profond contraste dans les performances doit susciter

la curiositédu conseiller d'orientation qui devra investiguer.

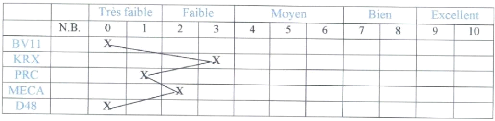

Dans ce cas le sujet présente d'excellentes

capacités dans le domaine de la compréhension et du vocabulaire.

Le facteur G et le raisonnement spatial sont moyens. Le raisonnement

numérique est faible. C'est la situation des élèves

doués mais en cours de maturité. Il est également probable

que le sujet ait rencontréun problème lors du test

numérique. La mise en évidence de la finesse de

compréhension prédispose le sujet à une adaptation aux

études littéraires et aux sciences humaines.

Mémoire de Master II en Informatique 11 c~NJAMEN M.

ZELKIF 2020-2021

1.4. PROCESSUS D'ORIENTATION AU CAMEROUN CHAPITRE 1.

L'ORIENTATION SCOLAIRE

Figure 1.5 - Exemple 3 : de Profil

Figure 1.6 - Exemple 4 : de Profil

Dans ce cas, les performances sont très

limitées. Ce cas rappelle les élèves en difficultés

scolaires. A moins que le candidat ait eu un problème pendant les

épreuves. Ces performances ne suffisent pas à parler d'aptitude.

La références aux résultats scolaires ici est

nécessaire pour pouvoir se prononcer sur l'orientation du sujet.

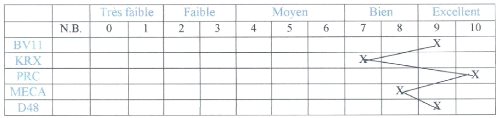

Figure 1.7 - Exemple 5 : de Profil

Dans ce cas, nous constatons un équilibre parfait. Les

performances dans les différents tests étant bons. De tels sujets

jouissent d'une grande marge de manoeuvre du point de

Mémoire de Master II en Informatique 12 c~NJAMEN M.

ZELKIF 2020-2021

1.5. CONCLUSION CHAPITRE 1. L'ORIENTATION SCOLAIRE

Mémoire de Master II en Informatique 13 c~NJAMEN M.

ZELKIF 2020-2021

vue du choix de filière, en cas de confirmation des

résultats scolaires.

1.5 Conclusion

En conclusion, nous pouvons retenir que les conseillers

d'orientation se servent de la batterie de tests d'aptitudes pour ceux qui en

ont pour la classe de 3ème et de

Form 3 respectivement pour le sous-système francophone et anglophone.

Pour ce faire, il est important que le conseiller d'orientation s'approprie les

différentes étapes de son utilisation à savoir : la

familiarisation avec la batterie de tests, le respect des conditions de son

utilisation et de son administration et enfin, l'interprétation des

résultats et la communication de ces résultats à

l'élève ou à ses parents.Dans le chapitre suivant, nous

verrons comment la tâche d'orientation peut être automatisée

en utilisant le Machine Learning.

14

REVUE DE LA LITTÉRATURE

2.1 Introduction

Les systèmes de recommandation sont largement

utilisés dans de nombreux domaines, en particulier dans le commerce

électronique. Récemment, ils sont également

appliqués dans des tâches d'apprentissage. Les systèmes de

tutorat assistés par ordinateur permettent aux étudiants de

résoudre certains problèmes (exercices) avec une interface

graphique qui peut automatiser certaines tâches fastidieuses, fournir des

conseils et fournir des commentaires à l'étudiant. Ces

systèmes peuvent profiter de l'anticipation du rendement des

élèves de plusieurs façons, par exemple, en

sélectionnant la bonne combinaison d'exercices, en choisissant une bonne

orientation en fonction de ses compétences et de ses aspirations. Dans

ce chapitre nous allons d'abord faire une étude des techniques

(Algorithmes) de Machine Learning utilisés dans les systèmes de

recommandation et ensuite de la revue de la littérature sur

l'automatisation du processus d'orientation scolaire.

2.2 Le Machine Learning (Apprentissage

Automatique)

L'apprentissage est une discipline visant à la

construction de règles d'inférence et de décision pour le

traitement automatique des données. Les variantes sont : Le Machine

Learning, Le Data-Mining (Fouille de données) selon Aurélien

[12].

L'apprentissage automatique (en anglais : machine learning,

litt. « apprentissage machine »), apprentissage artificiel ou

apprentissage statistique est un champ d'étude de l'in-telligence

artificielle qui se fonde sur des approches mathématiques et

statistiques pour donner aux ordinateurs la capacitéd'« apprendre

» à partir de données, c'est-à-dire

d'améliorer leurs performances à résoudre des tâches

sans être explicitement program-

Mémoire de Master II en Informatique 15 c~NJAMEN M.

ZELKIF 2020-2021

2.2. LE MACHINE LEARNING (APPRENTISSAGE

AUTOMATIQUE)CHAPITRE 2. REVUE DE LA LITTÉRATURE

més pour chacune. Plus largement, il concerne la

conception, l'analyse, l'optimisation, le développement et

l'implémentation de telles méthodes selon Wikipédia

[13].

L'apprentissage automatique comporte

généralement deux phases. La première consiste à

estimer un modèle à partir de données, appelées

observations, qui sont disponibles et en nombre fini, lors de la phase de

conception du système. L'estimation du modèle

consiste à résoudre une tâche pratique,

telle que traduire un discours, estimer une densitéde

probabilité, reconnaître la présence d'un chat dans une

photographie ou faire une recommandation (série littéraire ou

scientifique : Orientation Scolaire). Cette phase dite « d'apprentissage

» ou « d'entraînement » est généralement

réalisée préalablement àl'utilisation

pratique du modèle. La seconde phase correspond à la mise en

production : le

modèle étant déterminé, de

nouvelles données peuvent alors être soumises afin d'obtenir le

résultat correspondant à la tâche souhaitée. En

pratique, certains systèmes peuvent poursuivre leur apprentissage une

fois en production, pour peu qu'ils aient un moyen d'obtenir un retour sur la

qualitédes résultats produits toujours selon Wikipédia

[13].

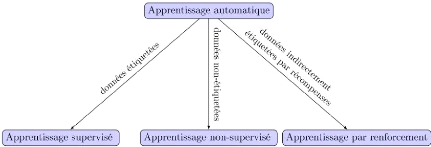

Selon les informations disponibles durant la phase

d'apprentissage, l'apprentissage est qualifiéde différentes

manières. Si les données sont étiquetées

(c'est-à-dire que la réponse à la tâche est connue

pour ces données), il s'agit d'un apprentissage supervisé. On

parle de classification ou de classement si les étiquettes sont

discrètes, ou de régression si elles sont continues. Si le

modèle est appris de manière incrémentale en fonction

d'une récompense reçue par le programme pour chacune des actions

entreprises, on parle d'apprentissage par renforcement. Dans le cas le plus

général, sans étiquette, on cherche à

déterminer la structure sous-jacente des données (qui peuvent

être une densitéde probabilité) et il s'agit alors

d'apprentissage non supervisé. Selon Wikipédia [13],

L'apprentissage automatique peut être appliquéà

différents types de données, tels des graphes, des arbres, des

courbes, ou plus simplement des vecteurs de caractéristiques, qui

peuvent être des variables qualitatives ou quantitatives continues ou

discrètes.

L'apprentissage automatique est utilisédans un large

spectre d'applications pour doter des ordinateurs ou des machines de

capacitéd'analyser des données d'entrée comme : perception

de leur environnement (vision, Reconnaissance de formes tels des visages,

schémas, segmentation d'image, langages naturels, caractères

dactylographiés ou manuscrits; moteurs de recherche, analyse et

indexation d'images et de vidéo, en particulier

Mémoire de Master II en Informatique 16 c~NJAMEN M.

ZELKIF 2020-2021

2.2. LE MACHINE LEARNING (APPRENTISSAGE

AUTOMATIQUE)CHAPITRE 2. REVUE DE LA LITTÉRATURE

pour la recherche d'image par le contenu; aide aux

diagnostics, médical notamment, bio-informatique,

chémoinformatique ou chimio-informatique; interfaces cerveau-machine;

détection de fraudes à la carte de crédit,

cybersécurité, analyse financière, dont analyse du

marchéboursier; classification des séquences d'ADN; jeu;

génie logiciel; adaptation de sites Web; robotique (locomotion de

robots, etc.); analyse prédictive dans de nombreux domaines

(éducation, financière, médicale, juridique, judiciaire).

Exemples :

· D'après Nguyen et al. [5] Un système de

recommandation pour la prédiction des performances des étudiants

dans un cours de E-learning.

· Selon Hanaa et al. [6], Un système de

recommandation et de prédiction basésur la performances des

étudiants dans un cours de E-Learning.

2.2.1 Les Types d'apprentissages

On peut séparer les tâches de l'apprentissage

automatique en trois grandes familles :

· Apprentissage supervisé;

· Apprentissage Non supervisé;

· Apprentissage par renforcement.

2.2.1.1 Apprentissage supervisé

Dans Wikipédia [13], Lorsque les classes (les sorties

désirées) sont prédéterminées et les

exemples connus, le système apprend à classer selon un

modèle de classification ou de classement; on parle d'apprentissage

supervisé(ou d'analyse discriminante).

La formulation du problème de l'apprentissage

superviséest simple: « on dispose d'un nombre fini d'exemples d'une

tàache à réaliser, sous forme de paires

(entrée,sortie désirée), et on souhaite obtenir, d'une

manière automatique, un système capable de trouver de

façon relativement fiable la sortie correspondant à toute

nouvelle entrée qui pourrait lui être présentée

».

Un expert (ou oracle) doit préalablement

étiqueter des exemples. Le processus se passe en deux phases. La

première phase (dite d'apprentissage) consiste à

déterminer un modèle à partir des données

étiquetées. La seconde phase (dite de test) consiste à

prédire l'étiquette d'une nouvelle donnée, connaissant le

modèle préalablement appris. D'où:

Mémoire de Master II en Informatique 17 c~NJAMEN M. ZELKIF

2020-2021

2.2. LE MACHINE LEARNING (APPRENTISSAGE

AUTOMATIQUE)CHAPITRE 2. REVUE DE LA LITTÉRATURE

Dn = {(x1, y1), ...,

(xn, yn)}, inférer la

relation entre x et y selon Alain [14].

Synonymes : discrimination, reconnaissance de formes.

Vocabulaire : xi =

Caractéristique = Feature = V

ariableexplicative. On distingue en général trois types de

problèmes auxquels l'apprentissage superviséest appliqué.

Ces tâches diffèrent essentiellement par la nature des paires

(entrée, sortie) qui y sont associées. Ainsi, on a :

A) Classification:

Dans les problèmes de classification, l'entrée

correspond à une instance d'une classe, et la sortie qui y est

associée indique la classe. Par exemple pour un problème de

reconnaissance de visage, l'entrée serait l'image bitmap d'une personne

telle que fournie par une caméra, et la sortie indiquerait de quelle

personne il s'agit (parmi l'ensemble de personnes que l'on souhaite voir le

système reconnaître).

B) Régression :

Dans les problèmes de régression,

l'entrée n'est pas associée à une classe, mais dans le cas

général, à une ou plusieurs valeurs réelles (un

vecteur). Par exemple, pour une expérience de biochimie, on pourrait

vouloir prédire le taux de réaction d'un organisme en fonction

des taux de différentes substances qui lui sont administrées.

C) Séries temporelles :

Dans les problèmes de séries temporelles, il

s'agit typiquement de prédire les valeurs futures d'une certaine

quantitéconnaissant ses valeurs passées ainsi que d'autres

informations. Par exemple le rendement d'une action en bourse. . . Une

différence importante avec les problèmes de régression ou

de classification est que les données suivent typiquement une

distribution non stationnaire.

Selon Matthieu [15], En classification, on essaie de

catégoriser les entrées dans les bonnes classes. En

régression, on estime une relation entre entrée et sortie.

Mémoire de Master II en Informatique 18 c~NJAMEN M. ZELKIF

2020-2021

2.2. LE MACHINE LEARNING (APPRENTISSAGE

AUTOMATIQUE)CHAPITRE 2. REVUE DE LA LITTÉRATURE

2.2.1.2 Apprentissage non supervisé

Dans l'apprentissage non superviséil n'y a pas de

notion de sortie désirée, on dispose seulement d'un nombre fini

de données d'apprentissage, constituées

»d'entrées», sans qu'aucun label n'y soit rattaché.

Autrement dit, il s'agit d'un apprentissage dans lequel les

données ne sont pas étiquetées d'après

Wikipédia [16]. L'absence d'étiquetage ou d'annotation

caractérise les tâches d'apprentissage non superviséet les

distingue donc des tâches d'apprentissage supervisé.

L'introduction dans un système d'une approche

d'apprentissage non superviséest un moyen d'expérimenter

l'intelligence artificielle. En général, des systèmes

d'apprentis-sage non supervisépermettent d'exécuter des

tâches plus complexes que les systèmes d'apprentissage

supervisé, mais ils peuvent aussi être plus imprévisibles.

Même si un système d'IA d'apprentissage non

superviséparvient tout seul, par exemple, à faire le tri entre

des chats et des chiens, il peut aussi ajouter des catégories

inattendues et non désirées, et classer des races inhabituelles,

introduisant plus de bruit que d'ordre d'après

Wikipédia [16]. Les techniques de résolution des

problèmes d'apprentissage non supervisésont multiples.

Cependant, nous allons citer quelques unes telles que :

1) Estimation de densité:

Dans un problème d'estimation de densité, on

cherche à modéliser convenablement la distribution des

données. L'estimateur obtenu f(x) doit pouvoir donner un bon

estiméde la densitéde probabilitéà un point de test

x issu de la même distribution (inconnue) que les données

d'apprentissage.

2) Le Partitionnement (clustering) :

Le problème du partitionnement est le pendant

non-superviséde la classification. Un algorithme de partitionnement

tente de partitionner l'espace d'entrée en un certain nombre de

classes en se basant sur un ensemble d'apprentissage fini, ne

contenant aucune information de classe explicite. Les critères

utilisés pour décider si deux points devraient appartenir

à la même classe ou à des classes différents sont

spécifiques à chaque algorithme, mais sont très souvent

liés à une mesure de distance entre points.

3) Réduction de

dimensionalité:

2.3. LES ALGORITHMES DE MACHINE LEARNING CHAPITRE 2. REVUE DE LA

LITTÉRATURE

Mémoire de Master II en Informatique 19 c~NJAMEN M. ZELKIF

2020-2021

Le but d'un algorithme de réduction de

dimensionalitéest de parvenir à résumer l'information

présente dans les coordonnées d'un point en haute dimension

(x E Rn, n grand) par un nombre plus réduit de

caractéristiques

(y = f(x), y E Rm, in < n). Le but

espéréest de préserver l'information importante, de la

mettre en évidence en la dissociant du bruit, et possiblement de

révéler une structure sous-jacente qui ne serait pas

immédiatement apparente dans les données

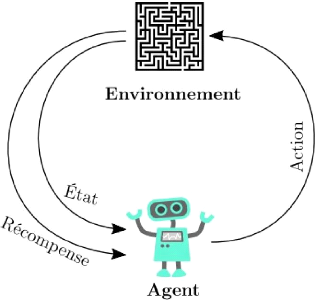

2.2.1.3 Apprentissage par renforcement

L'apprentissage par renforcement, au sens

général, est un cadre formel qui modélise des

problèmes décisionnels séquentiels. Au sein de ce cadre,

un agent apprend à prendre des décisions optimales en

interagissant avec l'environnement selon Matthieu [15].

En intelligence artificielle, plus précisément

en apprentissage automatique, l'appren-tissage par renforcement consiste, pour

un agent autonome (robot, etc.), à apprendre les actions à

prendre, à partir d'expériences, de façon à

optimiser une récompense quantitative au cours du temps. L'agent est

plongéau sein d'un environnement, et prend ses décisions en

fonction de son état courant. En retour, l'environnement procure

à l'agent une récompense, qui peut être positive ou

négative. L'agent cherche, au travers d'expé-riences

itérées, un comportement décisionnel

(appeléstratégie ou politique, et qui est une fonction associant

à l'état courant l'action à exécuter) optimal, en

ce sens qu'il maximise la somme des récompenses au cours du temps

d'après Wikipédia [17].

L'apprentissage par renforcement repose sur l'utilisation de

données indirectement étiquetées par des

récompenses. Cet étiquetage est moins informatif qu'en

apprentissage superviséselon Matthieu [15].

2.3 Les Algorithmes de Machine Learning

Marketing prédictif, maintenance industrielle,

reconnaissance faciale et vocale, éducation (orientation scolaire et

professionnelle). Les applications de Machine Learning (ou apprentissage

automatique) sont aujourd'hui de plus en plus nombreuses au sein des

organisations. À la croisée des statistiques, de l'intelligence

artificielle et de l'informatique, cette technologie consiste à

programmer des algorithmes pour permettre aux ordinateurs d'apprendre par

eux-mêmes.

2.3. LES ALGORITHMES DE MACHINE LEARNING CHAPITRE 2. REVUE DE LA

LITTÉRATURE

Mémoire de Master II en Informatique 20 c~NJAMEN M. ZELKIF

2020-2021

Figure 2.1 - Illustration du cadre

général de l'apprentissage par renforcement. Adaptédepuis

Wikipédia [17].

Figure 2.2 - Les trois grandes classes

d'apprentissage automatique. Schéma De

Matthieu [15]

En reconnaissance de formes, les phases d'apprentissage et de

classification constituent des étapes fondamentales qui conditionnent en

grande partie les performances du système. Classifier des formes ou

individus (par exemple des objets, des images, des phonèmes, ...)

décrits par un ensemble de grandeurs caractéristiques (taille ou

masse de l'objet, pixels de l'image numérisée, spectre acoustique

du phonèmes, ...), c'est les ranger en un certain nombre de

catégories ou classes définies à l'avance. La

classification c'est l'action de ran-

2.3. LES ALGORITHMES DE MACHINE LEARNING CHAPITRE 2. REVUE DE LA

LITTÉRATURE

Mémoire de Master II en Informatique 21 c~NJAMEN M. ZELKIF

2020-2021

ger par classes, par catégories des objets avec des

propriétés communes. Il existe deux catégories de

classification : classification supervisée et classification non

supervisée. La classification est l'élaboration d'une

règle de décision qui transforme les attributs

caractérisant les formes en appartenance à une classe; passage de

l'espace de représentation vers l'espace de décision. La

classification consiste alors à identifier les classes auxquelles

appartiennent les formes à partir des caractéristiques

préalablement choisies et calculés. L'algorithme ou la

procédure qui réalise cette application est

appeléclassifieur. Dans la littérature scientifique, plusieurs

méthodes de classification ont

étéprésentées. Dans cette partie, nous allons

présenter quelques techniques: Machines à vecteurs de support,

arbres de décision, les k-ppv, classification Naïve

Bayésienne et réseau de neurones.

Les algorithmes de Machine Learning se classent en quatre

familles ou types principaux:

· Régression

La régression sert à trouver la relation d'une

variable par rapport à une ou plusieurs autres. Dans l'apprentissage

automatique, le but de la régression est d'estimer une valeur

(numérique) de sortie à partir des valeurs d'un ensemble de

caractéristiques en entrée. Autrement dit, l'objectif est de

déterminer une fonction f qui étant donnéun

nouveau x E R prédise correctement y E R. Par exemple,

estimer le prix d'une maison en se basant sur sa surface, nombre des

étages, son emplacement, etc. Donc, le problème revient à

estimer une fonction de calcul en se basant sur des données

d'entrainement. deuxième exemple : Estimer la série (Scientifique

ou Littéraire) d'un élève en se basant sur ses

performances académiques, etc. Les principaux algorithmes de

régression sont : Régression Linéaire,

Polynomiale, Logistique, Quantile etc... tiréde GitHub [18].

Outre ces algorithmes, nous pouvons aussi avoir les arbres de

décision, SVR (Support Vector Regression ou Régression

Vectorielle de Soutien), les réseaux de neurones...

· Classification

Un problème de classification survient lorsque la

variable de sortie est une

2.3. LES ALGORITHMES DE MACHINE LEARNING CHAPITRE 2. REVUE DE LA

LITTÉRATURE

Mémoire de Master II en Informatique 22 c~NJAMEN M.

ZELKIF 2020-2021

catégorie, telle que « rouge » ou « bleu

» ou « maladie » et « pas de maladie » ou «

Scientifique » et « Littéraire » dans le cadre de

l'orientation scolaire. Un modèle de classification tente de tirer des

conclusions à partir des valeurs observées. Étant

donnéune ou plusieurs entrées, un modèle de classification

tentera de prédire la valeur d'un ou plusieurs résultats. Par

exemple, lors du filtrage des e-mails « spam » ou « pas de spam

», lors de la consultation des données de transaction, «

frauduleux » ou « autorisé». En bref, la classification

prédit les étiquettes de classe catégorielles ou classe

les données (construisez un modèle) en fonction de l'ensemble

d'apprentissage et des valeurs (étiquettes de classe) dans la

classification des attributs et l'utilise pour classer les nouvelles

données. Il existe plusieurs modèles de classification. Les

modèles de classification incluent la régression

logistique, l'arbre de décision, la forêt aléatoire,

l'arbre amplifiépar gradient, le perceptron multicouche, l'un contre le

repos et Naive Bayes. selon Lima [19]

· Partitionnement des données

Le partitionnement de données (ou data clustering en

anglais) est une méthode en analyse des données. Elle vise

à diviser un ensemble de données en différents «

paquets » homogènes, en ce sens que les données de chaque

sous-ensemble partagent des caractéristiques communes, qui correspondent

le plus souvent à des critères de

proximité(similaritéinformatique) que l'on définit en

introduisant des mesures et classes de distance entre objets.

Pour obtenir un bon partitionnement, il convient d'àla

fois :

- minimiser l'inertie intra-classe pour obtenir des grappes

(cluster en anglais) les plus homogènes possibles;

- maximiser l'inertie inter-classe afin d'obtenir des

sous-ensembles bien différenciés.

· Réduction de dimensions.

Le nombre de variables prédictives (features) pour un

set de données est ap-pelésa dimension. La réduction de

dimensionnalitéfait référence aux techniques

2.3. LES ALGORITHMES DE MACHINE LEARNING CHAPITRE 2. REVUE DE LA

LITTÉRATURE

Mémoire de Master II en Informatique 23 c~NJAMEN

M. ZELKIF 2020-2021

qui réduisent le nombre de variables dans un ensemble

de données, ou encore projettent des données issues d'un espace

de grande dimension dans un espace de plus petite dimension.

L'ensemble de données peut être un data-set

contenant un grand nombre de colonnes et un tableau de points constituant une

grande sphère dans un espace tridimensionnel. La réduction de

dimensionnalitéconsiste donc à réduire le nombre de

colonnes et à convertir la sphère en un cercle dans un espace

bidimensionnel respectivement.

Notre problème étant celui de classification,

nous allons parler des algorithmes de classification.

2.3.1 Algorithmes de Classification

2.3.2 Classification Naïve

Bayésienne

Les méthodes de classification na·ýve

Bayésienne sont un ensemble d'algorithmes d'ap-prentissage automatique

supervisébasés sur l'application du théorème de

Bayes avec l'hypothèse d'une forte indépendance

na·ýve entre chaque paire de features.

En d'autres termes, un classifieur bayésien naïf

suppose que l'existence d'une caractéristique pour une classe, est

indépendante de l'existence d'autres caractéristiques!

Problème :

Supposons que nous devions classer le vecteur A =

a1?an en in classes,

B1?Bm.

Nous devons calculer la probabilitéde chaque classe

possible sachant A pour que nous puissions étiqueter A

avec la classe Bi de plus grande probabilité.

Le théorème de Bayes nous permet de calculer la

probabilitéconditionnelle grâce à la formule

Pr[A B] = P r[B|A]P

r[A]

P r[B] C

où:

· Pr[B A, C] est la vraisemblance de

l'événement B si A et C sont

vérifiés;

· Pr[A C] est la probabilitéa priori

de l'événement A sachant C ;

· Pr[B C] est la probabilitémarginale de

l'événement B sachant C ;

· 2.3. LES ALGORITHMES DE MACHINE LEARNING CHAPITRE 2.

REVUE DE LA LITTÉRATURE

Mémoire de Master II en Informatique 24 c~NJAMEN

M. ZELKIF 2020-2021

Pr[A|B, C] est la probabilitéa posteriori de

A si B et C.

Dans cette formulation de la règle de Bayes, C

joue le rôle de la connaissance que l'on

a.

2.3.3 Algorithme des K-PPV (K-Plus Proches Voisins) ou en

anglais KNN (K-Nearest Neighbors)

La méthode des plus proches voisins

(notéparfois k-PPV ou k-NN pour K-Nearest-Neighbor) consiste à

déterminer pour chaque nouvel individu que l'on veut classer, la liste

des plus proches voisins parmi les individus déjàclassés.

L'individu est affectéà la classe qui contient le plus

d'individus parmi ces plus proches voisins. Cette méthode

nécessite de choisir une distance, la plus classique est la distance

euclidienne, et le nombre de voisins à prendre en compte selon (SOLLAH

[20]).

La méthode K-PPV suppose que les données se

trouvent dans un espace de caractéristiques. Cela signifie que les

points de données sont dans un espace métrique. Les

données peuvent être des scalaires ou même des vecteurs

multidimensionnels selon les auteurs 'Eric and Michel [4]],[ SOLLAH [20].

La méthode des k plus proches voisins est

utilisée pour la classification et la régression. Dans les deux

cas, l'entrée se compose des k données d'entraînement les

plus proches dans l'espace de caractéristiques (SOLLAH [20]).

L'algorithme K-NN est l'un des plus simples de tous les

algorithmes d'apprentissage automatique. Il est un type d'apprentissage

basésur l'apprentissage paresseux (lazy learning).

En d'autres termes, il n'y a pas de phase

d'entraînement explicite ou très minime. Cela signifie que la

phase d'entraînement est assez rapide.

L'algorithme K-PPV figure parmi les plus simples algorithmes

d'apprentissage artificiel. Dans un contexte de classification d'une nouvelle

observation x, l'idée fondatrice simple est de faire voter les

plus proches voisins de cette observation. La classe de xest

déterminée en fonction de la classe majoritaire parmi les k

plus proches voisins de l'ob-servation x.

La méthode K-NN est donc une méthode à

base de voisinage, non-paramétrique, Ceci signifiant que l'algorithme

permet de faire une classification sans faire d'hypothèse sur la

2.3. LES ALGORITHMES DE MACHINE LEARNING CHAPITRE 2. REVUE DE

LA LITTÉRATURE

Mémoire de Master II en Informatique 25 c~NJAMEN M.

ZELKIF 2020-2021

fonction

y = f(x1, x2, ...,

xp) qui relie la variable dépendante aux variables

indépendantes.

Cette méthode utilise principalement deux

paramètres : une fonction de similaritépour comparer les

individus dans l'espace de caractéristiques et le nombre k qui

décide combien de voisins influencent la classification. Les choix de la

distance et du paramètre k sont primordiaux pour le bon fonctionnement

de cette méthode.

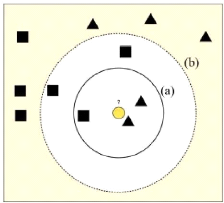

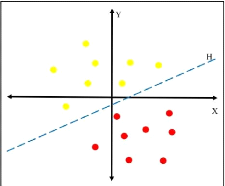

Figure 2.3 - Exemple de classification avec un

KPPV : (a) k= 3, (b) k=5. Tiréde

SOLLAH [20]

2.3.3.1 Principe du K-PPV

Son principe est le suivant : Une donnée de classe

inconnue est comparée à toutes les données

stockées. On choisit pour la nouvelle

donnée. la classe majoritaire

parmi ses K plus proches voisins (Elle peut donc être lourde pour des

grandes bases de données) au sens d'une distance choisie. Les k-PPV

nécessitent seulement :

· Un entier k

· Une base d'apprentissage L = {(yi,

xi), i = 1, ..., nL}

oùyi E {1, ..., c} dénote la

classe de l'individu i et le vecteur xi = (xi1,

..., xip) représente les variables prédicatrices de

l'individu i.

· Une métrique pour la proximité

· Une métrique pour la proximité(une

distance)

on peut choisir la distance euclidienne de.

Soient deux données représentées par

2.3. LES ALGORITHMES DE MACHINE LEARNING CHAPITRE 2.

REVUE DE LA LITTÉRATURE

deux vecteurs x et y , la distance entre ces

deux données est donnée par :

|

de(x,y) =

|

v u u Xn ti=1

|

(xi - yi)2 (2.1)

|

Mémoire de Master II en Informatique 26 c~NJAMEN M. ZELKIF

2020-2021

Ainsi, pour une nouvelle observation (y, x) le plus

proche voisin (y1-x1) dans l'échantillon

d'apprentissage est déterminépar :

d(x, x1) = mini(d(x,

xi))

Et y = y1, la classe du plus proche voisin, est

sélectionnée pour la prédiction de y.

2.3.3.2 Avantages de la méthode des K-PPV

La méthode des k plus proches voisins représente

des avantages tels que:

1. L'algorithme K-NN est robuste envers des données

bruitées. Selon SOLLAH [20]

2. La méthode des k plus proches voisins est efficace

si les données sont larges et incomplètes. Selon Wikipédia

[21]

3. Cette méthode est l'une des plus simples de tous

les algorithmes d'apprentissage automatique. Selon 123dok [22]

2.3.3.3 Inconvénients de la méthode des

K-PPV

La méthode des k plus proches voisins comporte des

inconvénients tels que :

1. Le besoin de déterminer la valeur du nombre des

plus proches voisins (le paramètre k). Dans 123dok [22]

2. Le temps de prédiction est très long

puisqu'on doit calculer la distance de tous les exemples. Selon

Wikipédia [21]

3. Selon Marwa [23] Cette méthode est gourmande en

espace mémoire car elle utilise une grande capacitéde stockage

pour le traitement des corpus.

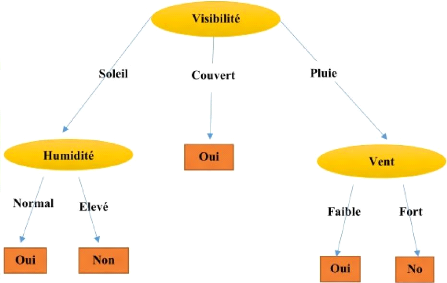

2.3.4 Les Arbres de décision

2.3.4.1 Généralités sur les arbres

de décision

L'apprentissage par arbre de décision est une

méthode classique en apprentissage automatique. Son but est de

créer un modèle qui prédit la valeur d'une variable-cible

depuis

2.3. LES ALGORITHMES DE MACHINE LEARNING CHAPITRE 2. REVUE DE LA

LITTÉRATURE

Mémoire de Master II en Informatique 27 c~NJAMEN M. ZELKIF

2020-2021

la valeur de plusieurs variables d'entrée.

Une des variables d'entrée est

sélectionnée à chaque noeud intérieur (ou interne,

noeud qui n'est pas terminal) de l'arbre selon une méthode qui

dépend de l'algorithme. Chaque arête vers un noeud-fils correspond

à un ensemble de valeurs d'une variable d'entrée, de

manière que l'ensemble des arêtes vers les noeuds-fils couvrent

toutes les valeurs possibles de la variable d'entrée.

Chaque feuille (ou noeud terminal de l'arbre)

représente soit une valeur de la variable-cible, soit une distribution

de probabilitédes diverses valeurs possibles de la variable-cible. La

combinaison des valeurs des variables d'entrée est

représentée par le chemin de la racine jusqu'àla

feuille.

L'arbre est en général construit en

séparant l'ensemble des données en sous-ensembles en fonction de

la valeur d'une caractéristique d'entrée. Ce processus est

répétésur chaque sous-ensemble obtenu de manière

récursive, il s'agit donc d'un partitionnement récursif.

La récursion est achevée à un noeud soit

lorsque tous les sous-ensembles ont la même valeur de la

caractéristique-cible, ou lorsque la séparation n'améliore

plus la prédiction. Ce processus est appeléinduction descendante

d'arbres de décision (top-down induction of decision trees ou TDIDT),

c'est un algorithme glouton puisqu'on recherche à chaque n ?ud de

l'arbre le partage optimal, dans le but d'obtenir le meilleur partage possible

sur l'ensemble de l'arbre de décision. C'est la stratégie la plus

commune pour apprendre les arbres de décision depuis les

données.

En fouille de données, les arbres de décision

peuvent aider à la description, la catégorisation ou la

généralisation d'un jeu de données fixé.

L'ensemble d'apprentissage est généralement

fourni sous la forme d'enregistrements du type:

(x,Y ) =

(x1,x2,x3,...,xk,Y )

La variable Y désigne la variable-cible que

l'on cherche à prédire, classer ou généraliser. Le

vecteur X est constituédes variables d'entrée

x1, x2, x3 etc. qui sont utilisées dans ce

but.

Selon Wikipédia [24], Un arbre de décision est

une structure graphique sous forme d'un arbre (feuilles et branches) qui

illustre un ensemble de choix pour aider à la prise de décision

et classer un vecteur d'entrée X.

Cet algorithme est très utilisédans les fouilles

de données et la sécurité.

2.3. LES ALGORITHMES DE MACHINE LEARNING CHAPITRE 2. REVUE DE LA

LITTÉRATURE

Mémoire de Master II en Informatique 28 c~NJAMEN M. ZELKIF

2020-2021

2.3. LES ALGORITHMES DE MACHINE LEARNING CHAPITRE 2. REVUE DE LA

LITTÉRATURE

Mémoire de Master II en Informatique 29 c~NJAMEN M. ZELKIF

2020-2021

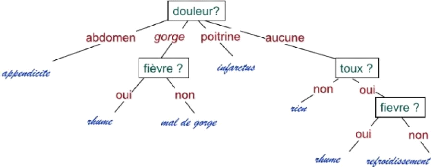

Chaque noeud de l'arborescence contient une comparaison de

fonction simple par rapport à un champ (exemple : x = female?).

Le résultat de chaque comparaison est vrai ou faux, ce

qui détermine si nous devons continuer vers la feuille gauche ou vers la

droite du noeud. Une feuille correspond à la décision.

Chaque instance est décrite par un vecteur

d'attributs/valeurs En entrée : un ensemble d'instances et leur classe

(correctement associées par un »expert»)

Les arbres de décision sont également connus

sous le nom d'arbres de classification et de régression (CART).

D'après Alain [14] Les arbres de décision sont

des classifieurs pour des instances représentées dans un

formalisme attribut/valeur.

· Les noeuds de l'arbre testent les attributs

· Il y a une branche pour chaque valeur de l'attribut

testé

· Les feuilles spécifient les catégories

(deux ou plus)

Figure 2.4 - Classification avec un Arbre de

Décision sur le jeu de donnée Maladies.

Tiréde Alain

[14]

Le choix des attributs est très important car :

· Si un attribut crucial n'est pas

représentéon ne pourra pas trouver d'arbre de décision qui

apprenne les exemples correctement.

· Si deux instances ont la même

représentation mais appartiennent à deux classes

différentes, le langage des instances (les attributs) est dit

inadéquat.

Figure 2.5 - Classification avec un Arbre de

Décision sur le jeu de donnée Jouer

Tennis. Tiréde

Alain [14]

2.3.4.2 Construction d'un arbre de décision

Le but est de trouver le plus petit arbre qui respecte

l'ensemble d'entraînement. Il ne s'agit pas uniquement de

mémoriser les observations, il faut trouver un arbre qui est capable

d'extrapoler des exemples qu'il n'a pas déjàvu.

L'arbre doit extraire des tendances ou des comportements

à partir des exemples.

1. Il construit les arbres de décision de haut en bas.

2. Il place à la racine l'attribut le plus important,

c'est-à-dire celui qui sépare le mieux les exemples positifs et

négatifs.

3. Par la suite, il y a un nouveau noeud pour chacune des

valeurs possibles de cet attribut.

4. Pour chacun de ces noeuds, on recommence le test avec le

sous-ensemble des exemples d'entraînement qui ont

étéclassés dans ce noeud.

2.3. LES ALGORITHMES DE MACHINE LEARNING CHAPITRE 2. REVUE DE LA

LITTÉRATURE

Mémoire de Master II en Informatique 30 c~NJAMEN M. ZELKIF

2020-2021

2.3.4.3 Avantages des Arbres de Décision

· Non-linéarité

· Support des

variables catégoriques

· Facile à interpréter

· Application à la régression

2.3.4.4 Inconvénients des Arbres de

Décision

· Prone au sur-ajustement

· Instable (non robuste)

· Forte variance

Enfin, il est rare que les modèles d'apprentissage

automatique utilisent un seul arbre de décision. Mais ils

agrègent plusieurs pour obtenir ce que l ?on appelle une forêt

d'arbres décisionnels ou forêts aléatoires.

2.3.5 Machines à vecteurs support SVM

Introduit par Vapnik en 1990, les machines à vecteurs

de support sont des techniques d'apprentissage supervisédestinées

à résoudre des problèmes de classification et de

régression.

Ce modèle était toutefois linéaire et

l'on ne connaissait pas encore le moyen d'induire des frontières de

décision non linéaires. En 1992, Boser et Al proposent

d'introduire des noyaux non-linéaires pour étendre le SVM au cas

non-linéaire dans SOLLAH [20].

Elles reposent sur deux notions principales : la notion de

marge maximale et la notion de fonction noyau. Les machines à vecteurs

support sont des algorithmes d'apprentis-sage automatique qui traitent des

problématique de classification et de régression d'après

Wikipédia [25].

Ces algorithmes ont l'avantages d'être simple à

utiliser, flexible et garantissent une soliditéthéorique.

leur but est de classer les données à l'aide

d'une frontière de sorte à maximiser la distance (appelée

marge) entre les données des différentes classes.

2.3. LES ALGORITHMES DE MACHINE LEARNING CHAPITRE 2. REVUE DE LA

LITTÉRATURE

Mémoire de Master II en Informatique 31 c~NJAMEN M.

ZELKIF 2020-2021

Les machines à vecteurs support sont utilisés

dans une variétéd'applications telles que la détection des

anomalie, la vision par ordinateur, la reconnaissance d'images etc.

Le tine-tuning des hyper-paramètres du SVM peut

être optimiséen utilisant la technique Grid-Search. Selon

Wikipédia [25]

2.3.5.1 Le Principe des SVMs

Le but des SVM est de trouver un séparateur entre deux

classes qui soit au maximum éloignéde n'importe quel point des

données d'entraînement. Si on arrive à trouver un

séparateur linéaire c'est-à-dire qu'il existe un hyperplan

séparateur alors le problème est dit linéairement

séparable sinon il n'est pas linéairement séparable et il

n'existe pas un hyperplan séparateur.

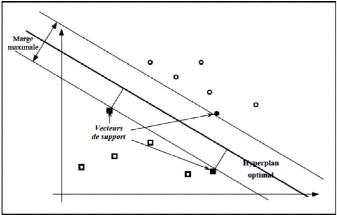

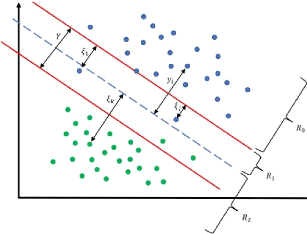

Figure 2.6 - Séparation de deux

ensembles de points par un Hyperplan H. Tiréde

SOLLAH [20]

Pour deux classes et des données linéairement

séparable, il y a beaucoup de séparateurs linéaires

possibles. Les SVM choisissent seulement celui qui est optimal,

c'est-à-dire la recherche d'une surface de décision qui soit

éloignée au maximum de tout point de données. Cette

distance de la surface de décision au point de données le plus

proche détermine la marge maximale du classifieur 2.6. En effet, pour

obtenir un hyperplan optimal, il faut maximiser la marge entre les

données et l'hyperplan.

Par intuition, le fait d'avoir une marge plus large fournit

plus de sécuritélorsque l'on

2.3. LES ALGORITHMES DE MACHINE LEARNING CHAPITRE 2. REVUE DE

LA LITTÉRATURE

Mémoire de Master II en Informatique 32 c~NJAMEN M.

ZELKIF 2020-2021

Figure 2.7 - Hyperplan optimal, marge et

vecteurs de support. Tiréde SOLLAH [20]

classe un nouvel exemple. De plus, si l'on trouve le

classificateur qui se comporte le mieux vis-à-vis des données

d'apprentissage, il est clair qu'il sera aussi celui qui permettra au mieux de

classer les nouveaux exemples. Comme nous avons mentionnéplus haut, il

existe plusieurs formes de SVM telles que les SVM linéaires, les SVM

multi-classe. Dans cette partie, nous nous limiterons aux SVM

linéaires.

2.3.5.2 Le SVM Linéaire

Le principe de base des SVM consiste de ramener le

problème de la discrimination àcelui, linéaire,

de la recherche d'un hyperplan optimal. Deux idées ou astuces permettent

d'atteindre cet objectif :

· La première consiste à définir

l'hyperplan comme solution d'un problème d'optimisa-tion sous

contraintes dont la fonction objective ne s'exprime qu'àl'aide de

produits scalaires entre vecteurs et dans lequel le nombre de contraintes

»actives» ou vecteurs supports contrôle la complexitédu

modèle. Tiréde SOLLAH [20]

· Toujours dans SOLLAH [20] Le passage à la

recherche de surfaces séparatrices non linéaires est obtenu par

l'introduction d'une fonction noyau (kernel) dans le produit scalaire induisant

implicitement une transformation non linéaire des données vers un

espace intermédiaire (feature space) de plus grande dimension.

2.3. LES ALGORITHMES DE MACHINE LEARNING CHAPITRE 2.

REVUE DE LA LITTÉRATURE

Mémoire de Master II en Informatique 33 c~NJAMEN M.

ZELKIF 2020-2021

2.3.5.3 Cas linéairement séparable

Considérons « l » points

{(x1, y1),

(x2, y2), ...,

(xi, yi)}, xi E RN

Avec i = 1...L et yi E {#177;1}

Ces points sont classés en utilisant une famille de

fonctions linéaires définis par :

(w,x) + b = 0 (Eq 1)

avec w E RN et b E

R de telle sorte que la fonction de décision concernant

l'apparte-nance d'un point à l'une des deux classes soit donnée

par :

f(x) = ((w,x) + b) (Eq 2)

La fonction (Eq 1) représente l'équation de

l'hyperplan H. La fonction de décision (Eq 2) va donc observer de quel

côtéde H se trouve l'élément de x.

On appelle la marge d'un élément la distance

euclidienne prise perpendiculairement entre H et x. Si on prend un

point quelconque t sur H, cette marge peut s'exprimer en :

Mx = w

1w11(x - t) (Eq 3)

La marge de toutes les données est définie comme

étant :

M = minxEEMx (Eq 4)

L'approche de classification par SVM tend à maximiser

cette marge pour séparer le plus clairement possible deux classes.

Intuitivement, avoir une marge la plus large possible sécurise mieux le

processus d'affectation d'un nouvel élément à l'une des

classes. Un SVM fait donc partie des classificateurs à marge

maximale.

Dans le cas simple linéairement séparable il

existe de nombreux hyperplans séparateurs. Selon la théorie de

Vapnik [26], l'hyperplan optimal est celui qui maximise la marge. Cette

dernière étant définie comme la distance entre un

hyperplan et les points échantillons les plus proches. Ces points

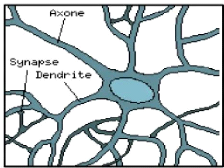

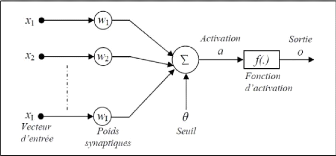

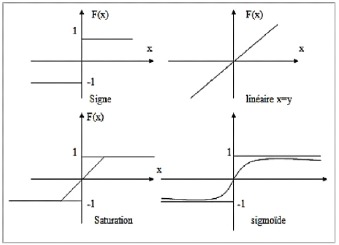

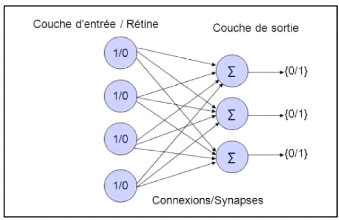

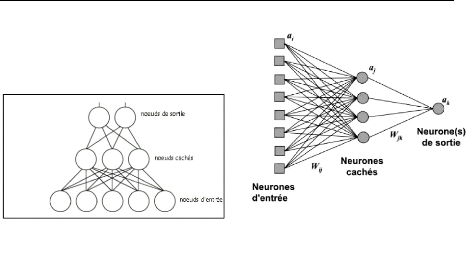

particuliers sont les vecteurs supports. La distance entre un point x