II.2.2.2

Télévision en couleur

II.2.2.2.1

Principe

Conformément aux caractéristiques de la vision

humaine, le cerveau peut reconstituer la plupart des couleurs visibles à

partir d'un mélange de 3 couleurs fondamentales situées dans le

rouge, le vert et le bleu. C'est la trichromie additive. L'image vidéo

est donc décomposée par des filtres optiques en ces trois

composantes fondamentales qui seront analysées indépendamment

pour donner trois signaux vidéo notés ER, EV et EB. On parle de

liaison RVB, en anglais RGB pour Red, Green, Blue.

II.2.2.2.2 Signal

Couleur

a- Colorimetrie

Les trois (3) signaux ER, EV et EB sont équivalents

à des luminances et peuvent être transmis

séparément. C'est parfois le cas en transmission locale, ou au

niveau de la prise péritel des téléviseurs,

magnétoscopes, décodeurs, etc.... Ce procédé n'est

pas applicable en diffusion hertzienne ni en distribution câblé

car il n'est pas compatible avec les téléviseurs noir et blanc

(problème fondamental lors de l'introduction de la

télévision couleur dans les années 60 et 70) et il triple

a priori la largeur de bande nécessaire à la transmission.

La compatibilité avec le noir et blanc est obtenue en

remplaçant les trois signaux ER, EV et EB par trois autres. Le premier

est la luminance qui est la même qu'en télévision N&B.

C'est donc le seul signal utile aux téléviseurs monochromes. La

luminance Y s'exprime sous la forme :

Y = 0,30 ER + 0,59 EV + 0,11 EB (les coefficients proviennent

de la différence de sensibilité de l'oeil selon les couleurs).

Les deux autres signaux, DB = EB - Y et DR = ER - Y, composent la chrominance

qui portent l'information de coloration de l'image. Ces deux signaux, qui

peuvent être négatifs, suffisent ; DV = EV - Y (le plus souvent

voisin de zéro du fait de l'efficacité visuelle de l'oeil) s'en

déduit. On parle alors de "liaison composite YUV" (U et V étant

respectivement associés à DB et DR).

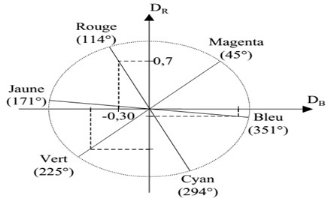

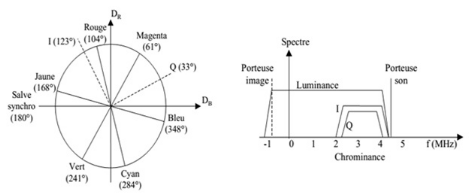

On peut représenter les composantes dans le plan de

couleurs (DB; DR).

Pour une couleur "purement" rouge, soit ER = 1 et EB = EV =

0, on a DB = - 0,30 et DR = 0,7.

Pour un bleu, soit EB = 1 et ER = EV = 0, on a DB = 0,89 et

DR= -0,11.

Enfin pour un vert, soit EV = 1 et EB = ER = 0, on a DB = DR =

- 0,59.

Figure II.23 : Plan de couleurs.

SOURCE: Document Systèmes Electroniques-

SysTélé2 Université Paris XI

Dans le plan de couleur, les points symétriques par

rapport à l'origine des points rouge, vert et bleu correspondent

respectivement aux couleurs cyan (bleu clair), magenta (rose pourpre) et jaune,

soit les couleurs complémentaires de rouge, vert et bleu (le cyan est

obtenu par mélange du vert et du bleu, le magenta du rouge et du bleu,

le jaune du rouge et du vert).

b- Aspect

fréquences

A l'origine de la télévision en couleur, la

contrainte était de ne pas modifier la répartition en

fréquences des émetteurs. Il a donc fallu insérer les

informations de chrominance dans le spectre de luminance. Le principe retenu

dans tous les systèmes a donc été de moduler la

chrominance sur une sous porteuse et de la multiplexer en des fréquences

avec la luminance. Pour cela, il a donc été nécessaire de

réduire fortement la bande passante occupée par la chrominance.

C'est possible sans trop de gène car l'oeil est beaucoup moins sensible

aux variations de chrominance qu'aux variations de luminance. L'acuité

visuelle de l'oeil est en fait environ 4 fois plus importante pour la luminance

que pour la chrominance. En conséquence, les signaux de chrominance sont

tout d'abord filtrés à environ le quart de la bande passante

vidéo, soit de l'ordre de 1,5 MHz.

Après quoi, les signaux de chrominance modulent une

sous-porteuse vers les 3/4 de la bande passante vidéo, de sorte que le

spectre de la sous porteuse modulée se situe dans la moitié

supérieure du spectre de la luminance. C'est dans le choix de la

fréquence de la sous-porteuse et du type de modulation que se situe la

différence entre les trois systèmes classiques de

télévision en couleurs : NTSC, PAL, SECAM.

Il y a donc nécessairement réduction de la

qualité du signal de luminance, dont une partie du spectre est

occupée par la chrominance. Cette réduction peut cependant

être limitée car l'énergie de la luminance est contenue

pour l'essentiel dans le bas de son spectre.

Compte tenu de la périodicité des images, donc

des lignes, des demi-trames et de la synchronisation, le spectre vidéo

est un spectre de raies. La chrominance est aussi un spectre de raies. Si elle

module une sous porteuse telle que les raies de chrominance soient

intercalées avec celle de la luminance, il sera alors possible de les

séparer avec un filtre en "peigne". Si cela n'est pas le cas, au prix

d'une acceptable altération de l'image (récepteurs bas de gamme)

il est possible de filtrer la partie "haute" du spectre de luminance pour

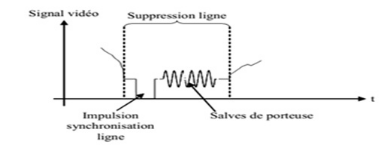

récupérer les informations de chrominance. Enfin, on transmet

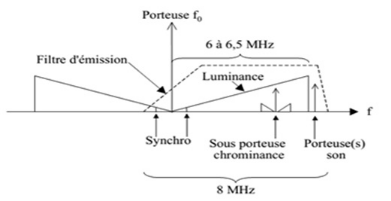

souvent ce spectre en modulation BLA. Pour la diffusion hertzienne. A

l'aide d'un filtre passe-haut, on conserve la bande latérale

supérieure et une partie de la bande latérale inférieure

ainsi que la porteuse f0 atténuée (Figure II.24). Les

différents canaux de télévision peuvent être ainsi

espacés de 8 MHz. La présence de la porteuse permet d'utiliser la

démodulation par détection d'enveloppe, moyennant une distorsion

jugée raisonnable, procédé peu coûteux. Cette

méthode est cependant aujourd'hui supplantée par la

démodulation cohérente, la porteuse étant facilement

récupérable (transmission de salve de porteuse pendant la

transmission des niveaux de suppression, ou/et utilisation d'une boucle

à verrouillage de phase). C'est dans les basses fréquences de la

bande de base que se trouvent les signaux de synchronisation lignes et trames,

avec un faible niveau. Le résidu de la bande latérale

inférieure permet de doubler leur puissance.

Figure II.24 : Spectre du signal vidéo couleur

modulé (standard européen). Le son est généralement

modulé en fréquence (système NTSC et PAL) ou en amplitude

(SECAM) autour d'une sous-porteuse située en dehors de la bande de

fréquence occupée par le signal vidéo.

SOURCE: Document Systèmes Electroniques-

SysTélé2 Université Paris XI.

II.2.2.2.3 les normes de

codages

a- PAL/SECAM

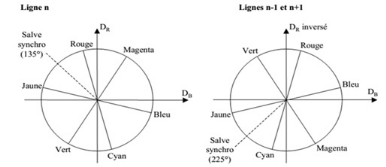

Ø Système PAL

Ce système allemand, développé chez

Telefunken en 1963, a repris le principe du NTSC, la MAQ, en corrigeant son

principal défaut, la sensibilité aux erreurs de phase en

réception. Pour cela, la phase du signal R modulant en quadrature la

sous-porteuse, est alternée à chaque ligne (Figure II.25),

d'où le nom du procédé : Phase Alternance Line, ou PAL.

Figure II.25 : Système PAL, plan de couleurs.

SOURCE: Document Systèmes Electroniques-

SysTélé2 Université Paris XI.

A la réception, et avant la démodulation, on

sépare les signaux DR et DB en faisant :

Ligne n + ligne (n-1) = 2 DB

Ligne n - ligne (n-1) = #177; 2 DR, le signe dépendant

de la parité de n.

A ce point, les deux signaux sont toujours modulés,

mais ils sont séparés. En contrepartie, la définition

verticale est réduite de moitié, puisque l'on fait la moyenne de

deux lignes successives.

La porteuse est à 4,434 MHz, et une salve est transmise

pour la référence de phase en début de chaque ligne, avec

une alternance entre 3ð/4 et 5ð/4. Cette référence permet

de démoduler la voie DR avec sa phase correcte.

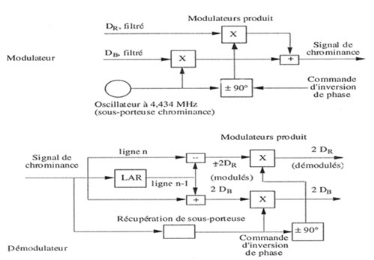

Les schémas des blocs d'émission et de

réception su système PAL sont donnés sur la Figure II.26.

Le démodulateur inclut une ligne à retard (retard de la

durée totale d'une ligne soit 64 us) pour obtenir simultanément

les lignes n et n-1.

L'addition (ou la soustraction) de deux lignes successives

crée l'effet de peigne qui améliore la séparation de la

luminance et de la chrominance

Figure II.26 : Modulateur et démodulateur PAL.

SOURCE: Document Systèmes Electroniques-

SysTélé2 Université Paris XI.

Ø Système SECAM

Le système français SECAM (séquentiel

couleur à mémoire, mis en service en octobre 1967) utilise la

modulation de fréquence de la sous-porteuse de la chrominance. Un seul

signal pouvant être transmis de la sorte, on transmet alternativement la

composante DR et la composante DB. Au décodage, la chrominance est

reconstituée en utilisant la composante reçue et la composante

complémentaire de la ligne précédente qui a

été mise en "mémoire", c'est-à-dire retardée

par une ligne à retard de 64 us.

Comme en PAL, il y a réduction de moitié de la

définition verticale, ce qui est en général peu visible.

Un transitoire brusque d'une ligne à l'autre peut créer des

erreurs de couleur, mais comme il y a alternance d'une trame à l'autre

de la répartition de DR et DB entre les lignes, cet effet est

atténué.

La fréquence centrale de la sous-porteuse et

l'excursion en fréquence ne sont pas les mêmes pour DR et DB:

f0 = 4,406 MHz (soit 282 fois la fréquence

de balayage horizontal fL) et ?F = #177;280 kHz pour DR,

f0= 4,250 MHz (soit 272 fois fL) et ?F = #177;230

kHz pour DB.

Ces fréquences, asservies sur fL, sont transmises en

salves en début de chaque ligne, ce qui permet l'identification de la

composante transmise. Au codage, un commutateur aiguille alternativement DR et

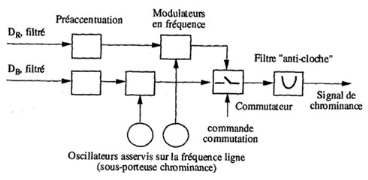

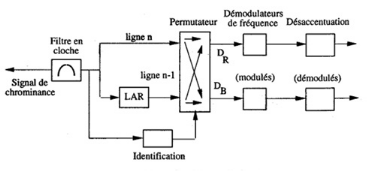

DB vers l'émission (Figure II.27), tandis qu'au décodage (Figure

II.28), une permutation synchronisé par l'identification des salves

envoie le bon signal à l'entrée de chaque démodulateur.

Figure II.27 : Modulateur SECAM.

SOURCE: Document Systèmes Electroniques-

SysTélé2 Université Paris XI.

Figure II.28 : Démodulateur SECAM.

SOURCE: Document Systèmes Electroniques.-

SysTélé2 Université Paris XI

Comme il est classique en modulation de fréquence, on

utilise une préaccentuation-désaccentuation pour limiter l'effet

du bruit en hautes fréquences.

Le spectre de chrominance s'étend environ de 3,9

à 4,7 MHz. Il n'apparaît plus sous forme de raies du fait de la

modulation de fréquence. Il est donc nécessaire de le

séparer du spectre de la luminance par des filtrages

supplémentaires :

Au codage, par un filtre coupe-bande centré autour de

4,285 MHz pour éviter une présence de la luminance dans la

chrominance,

Au décodage, le même filtrage est effectué

sur la voie de la luminance pour en enlever la chrominance, elle-même

séparée par un filtre passe-bande,

Au codage, un filtre de mise en forme (dit "anti-cloche" car

compensé par un filtre en cloche au décodage) permet

d'améliorer le rapport chrominance à luminance pour des signaux

éloignés de la fréquence centrale. Il en résulte

une modulation artificielle d'amplitude de la chrominance, qui ne contient pas

d'information utile.

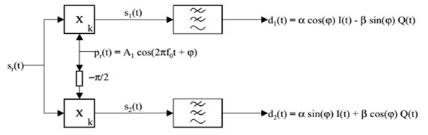

b- NTSC

Ce système américain (NTSC, National

Télévision Standard Committee) est ancien ; il date des

années 50. Son principe de base est la modulation d'amplitude en

quadrature (MAQ) d'une sous-porteuse par les deux composantes de la

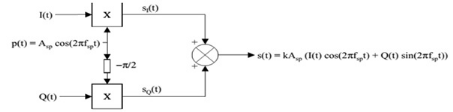

chrominance. Ce procédé, illustré par le schéma

bloc de la Figure II.29, permet en effet de moduler deux signaux

indépendants I(t) et Q(t) sur la même sous-porteuse fsp.

Figure II.29 : Génération d'une modulation

d'amplitude en quadrature.

SOURCE: Document Systèmes Electroniques-

SysTélé2 Université Paris XI.

Dans ce cas, les signaux modulants I(t) et Q(t) sont produits

par un matriçage des signaux de chrominance :

I = -0,27 DB + 0,74 DR et Q = -0,41 DB + 0,48 DR. Dans le plan

de couleur (la Figure II.30), la composante I se situe dans la direction de

l'orange où l'oeil est très sensible aux variations de couleurs,

et bénéficie d'une bande passante plus grande que Q (un peu plus

de 1000 kHz de bande passante pour I contre seulement 700 kHz pour Q), qui

correspond à une direction de faible sensibilité de l'oeil

(magenta). La sous-porteuse est à 3,58 MHz. L'avantage principal du

système est son faible encombrement spectral (la Figure II.30) : avec la

sous-porteuse son multiplexée à 4,5 MHz, l'espacement entre

canaux NTSC n'est que de 6 MHz en diffusion hertzienne.

|

Figure II.30 : Plan deCouleurs NTSC.

Les salves de synchronisation sont transmises à 180°

de DB.

|

Figure II.31 : Plan defréquence NTSC.

La bande passante de la luminance est limitée à

4,2 MHz.

|

SOURCE: Document Systèmes Electroniques-

SysTélé2 Université Paris XI.

L'utilisation de la MAQ implique que l'on effectue une

démodulation cohérente à la réception, comme

illustré sur la Figure II.31. L'inconvénient de cette

méthode réside dans le fait qu'elle est très sensible aux

erreurs de phase en réception (sur les sorties d1 et

d2 du montage de la Figure II.32, les signaux ne peuvent être

retrouvés séparément que si la sous-porteuse locale

utilisée à la réception est en parfait synchronisme avec

la sous-porteuse utilisée à l'émission, soit un

déphasage sur le schéma ? nul), qui vont se traduire par une

erreur de couleur. Bien que la référence de phase soit transmise

en début de chaque ligne par une salve de synchronisation (une dizaine

de périodes sur le palier suivant l'impulsion de synchronisation, Figure

II.32), cet effet reste le principal défaut du système NTSC.

C'est peut-être pour cette raison qu'il a été

surnommé Never Twice the SameColor (jamais deux fois la même

couleur).

Figure II.32 : Démodulation cohérente d'un signal

modulé en quadrature.

SOURCE: Document Systèmes Electroniques-

SysTélé2 Université Paris XI.

Figure II.33 : Salve de porteuse en début de ligne.

SOURCE: Document Systèmes Electroniques-

SysTélé2 Université Paris XI.

Il est à noter que du fait des valeurs relatives des

fréquences de balayage ligne (15734,27 Hz) et de la sous-porteuse

chrominance (3579454 Hz), le générateur de sous-porteuse à

la réception produit 227,55 cycles lors du balayage d'une ligne. D'une

ligne à l'autre, la sous-porteuse chrominance

régénérée grâce aux salves est

déphasée d'environ 180° (une demi-période). On peut

exploiter cette propriété pour concevoir un filtre peigne assez

simple permettant de séparer les signaux de chrominance de la luminance

: par addition de deux lignes successives on isole la luminance et par

soustraction les deux composantes de la chrominance encore modulées par

la sous-porteuse fsp.

II.2.3 - Principes,

Équipements et Notions de base de la Télévision

Numérique

Les technologies de l'information et de la communication sont

d'un abord complexe. Des différents auteurs continuent à faire

l'objet de Télévision Numérique Terrestre plusieurs

traitements selon leurs orientations théoriques. C'est ainsi que dans ce

travail nous tenterons de mettre en surface, quelques définitions et

explications que nous avons jugé exploitables.

II.2.3.1 - Les normes de

codage

Le codage de canal a pour but de moduler le flux de

données numériques pour l'adapter aux caractéristiques du

canal de transport ou d'enregistrement. Par exemple, les longues suites de 1 ou

de 0 du message numérique créent des composantes continues,

impossibles à relire une fois enregistrées. Il faut donc les

rompre par un codage particulier, dont l'unique but est de modifier la forme du

signal, sans bien sûr toucher à son contenu. Il existe plusieurs

codes, chacun ayant ses avantages et ses inconvénients qui les rendent

plus appropriés à tel ou tel type d'application :

réduction de la composante continue, mais aussi recouvrement de

l'horloge, distribution spectrale, etc.

Les images d'une séquence sont organisées en

groupes d'images : GOP (group of pictures) longueur : nombre d'images entre 2

images de type I (typique : N=12) ; nombre d'images entre 2 images type P (DVB

: M=3).

Pour coder un groupe d'images, nous devons utiliser une trame

complète (appelée trame Intra, I) comme base de codage des autres

trames.

Il y 3 types de trames :

Images I (Intra) : codées sans prédiction, elles

servent de référence, la taille moyenne du message est de 1000

kbit ;

Images P (Prédites) : définies à l'aide

de vecteurs de mouvements à partir des images passées. La taille

moyenne du message est de 300 kbit ;

Images B (Bidirectionnelles) : interpolées à

partir d'images passées et futures de type I et/ou P. la taille moyenne

du message est de 100 kbit ;

Structure d'un groupe d'image N = 12 et M = 3 (standard

DVB)

a- La norme MPEG -

1

Une image animée est en fait une suite d'images

décrivant un mouvement. Le nombre d'images par seconde doit être

suffisant pour donner à l'oeil une sensation de fluidité. Le taux

idéal est de 24 images par seconde. A cette fréquence, l'oeil

perçoit le mouvement de façon claire. A 40 Hz le mouvement est

suffisamment fluide pour un confort optimal de l'oeil. La technique la plus

utilisée pour augmenter cette fréquence est l'entrelacement qui

permet d'afficher plus vite une image en la décomposant en ligne paires

et lignes impaires. La fréquence de balayage est donc doublée et

permet d'atteindre des fréquences plus élevées.

La norme de compression MPEG1 reprend ce principe de

succession d'image et l'étend pour donner naissance à une

véritable hiérarchie. La séquence vidéo est

décomposée en plusieurs parties, ellesmémes

décomposées en d'autres parties, et ainsi de suite... Le niveau

de complexité de cette structure est assez profond, nous allons

l'étudier en détail.

Une séquence vidéo est décomposée

en groupes d'images qui sont l'âme du principe de codage MPEG, en effet

chaque image de ce groupe d'images à sa fonction propre dans ce groupe

selon son type et son emplacement. Chaque image est décomposée en

bandes qui sont des moyens de resynchroniser la décompression si une

erreur survenait. Cela permet donc de ne pas jeter une image en cas d'erreur au

sein de celle-ci. La bande est un groupe de macroblocs qui sont, dans le cas du

MPEG1, composés de quatre blocs de luminance (Y) et de deux blocs de

chrominance (Cb et Cr). Le macrobloc est l'unité de codage de base pour

ce que nous définirons comme la prédiction de mouvement et qui

nous servira pour le codage vidéo. Enfin le bloc est la plus petite

entité de cette hiérarchie, il permet de réduire les

redondances spatiales. Le bloc est un carré de 8*8 pixels.

Techniques de codage MPEG-1 Codage des images

Les normes MPEG prévoient comme format d'entrée

pour les images le format YCbCr. Où Y sont la luminance (le degré

de luminosité du pixel) et Cb et Cr les composantes de chrominance (la

teinte du pixel). Il existe plusieurs formats YCbCr différenciés

par le nombre de bits codant chacune des composantes. La norme MPEG1 utilise le

format 4:2:0, ce symbole indique pour chacune des composantes, sur un

carré de 4 pixels, combien sont échantillonnés sur 8 bits.

Dans ce cas, la composante Y est codée sur tous les pixels, alors que

sur 4 pixels, les composantes Cb et Cr sont sous échantillonnés :

les 4 pixels partagent les 8 bits codant chaque composante de chrominance. Sur

un carré de 4 pixels nous avons donc : 4×8 + 1×8 + 1×8 =

48 bits de codage ; ce qui donne en moyenne 12 bits par pixel. La raison

du sous échantillonnage de la chrominance et pas de la luminance vient

d'une particularité de l'oeil humain qui est plus sensible aux

écarts de luminosité qu'aux variations de teinte ; en exploitant

cette particularité, il est donc possible de compresser l'image en

réduisant le nombre de bits nécessaires pour la coder.

Une image dans la norme MPEG1 est décomposée en

trois matrices qui sont la composante de luminance (Y) et les deux composantes

de chrominance de l'image (Cr et Cb). On peut comparer ceci à des

pochoirs qui se compléteraient en les superposant pour donner l'image

que l'on veut utiliser. Chaque pochoir détenant une information que ne

détiennent pas les autres.

L'image à un format totalement différent selon

le rôle qu'elle tient dans le groupe d'image d'où elle est issue.

Nous parlerons de trois types d'images :

Les images Intra (I) : ces images sont des points de

resynchronisation dans le cas d'une erreur. En effet, elles ne tiennent compte

d'aucune autre image passé ou futur et sont codées uniquement sur

leur contenu ; on parle alors de codage inter-image. Ce sont les images qui

contiennent le plus d'informations et donc les plus critiques en cas d'erreur

de transmission. Ces images sont les premières d'un groupe d'image car

elles contiennent toutes les informations nécessaires pour leur

décodage. Elles servent également de références aux

autres types d'images suivantes ou éventuellement

précédentes. Les techniques de codage et de compression

employées seront expliquées par la suite.

Les images Prédictives (P) : ce type d'image est, comme

son nom l'indique, prédite d'une image précédente de

référence (une image I ou une autre image P). Les informations

utilisées sont les macroblocs d'images précédentes qui se

retrouvent dans l'image P courante. On recherche les macroblocs de l'image

courante dans l'image de référence et on indique, si on le

trouve, le déplacement effectué grâce à un vecteur

de mouvement. Dans le cas où le macrobloc ne se trouverait pas dans

cette image de référence, un codage de type I est utilisé

sur ce macrobloc. Ce type d'image a une taille égale, en moyenne,

à 30-50% de la taille d'une image I.

Les images Bidirectionnelles (B) : Ce sont les images les

mieux compressées, donc celles qui sont les plus sensibles aux erreurs.

Ces images nécessitent deux points de référence dans le

flux vidéo ou plus précisément dans les groupes d'images

dont elles sont issues. Elles nécessitent en effet une image I ou P

future ou passée pour pouvoir être construites. Pour chaque

macrobloc le meilleur macrobloc codé précédemment et le

meilleur codé postérieurement sont utilisés et une moyenne

est faite pour coder le macrobloc de l'image B courante. Comme pour les images

P, les informations que l'on ne peut retrouver dans une image

précédente ou suivante sont codées selon un codage

similaire à celui utilisé pour les images I. Ces images font

à peu près 50% de la taille d'une image P.

Ø La bande

Les bandes sont des points d'accès aléatoires

dans une image au même titre que les GOP sont des points d'accès

aléatoires dans une séquence vidéo. En cas d'erreur, cette

sous structure de l'image permet de ne pas avoir à ignorer

entièrement l'image. Si une bande est corrompue, on passe à la

suivante sans casser l'image courante. Une bande contient toutes les

informations nécessaires à l'emplacement des macroblocs qui la

constituent sur l'écran.

La présence d'une grande quantité de bandes dans

une image permet une plus grande fiabilité en cas d'erreur (moins

d'information seront perdues) mais nécessite une plus grande

quantité de codes. Un équilibre doit donc être

trouvé. C'est pour cela que la taille d'une bande est variable et n'est

donc pas définie dans la norme MPEG.

Ø Le bloc

Dernier composant utile de cette structure

hiérarchique, le bloc sert au codage effectif des informations visuelles

de l'image. Les blocs sont des carrés de 8×8 pixels et codent la

composante Y, Cb ou Cr. Des algorithmes mathématiques de codage et de

compression sont utilisés pour permettre une réduction du volume

de données nécessaires. Au sein du même bloc des

redondances, dites spatiales, font que certains pixels proches sont identiques,

cette redondance est gommée en appliquant sur chaque bloc une

Transformée en Cosinus Discrète (DCT). Ceci permet, depuis une

matrice (3 matrices (Y, Cb, Cr) constituent un bloc) codant la valeur de chaque

pixel selon chaque composante, d'obtenir une matrice de fréquences

spatiales. Cette matrice représente en fait la transition des couleurs

dans le bloc. Ces 64 coefficients sont ensuite quantifiés, c'est

à dire qu'on les divise par une certaine valeur afin de diminuer le

nombre d'informations nécessaires pour le codage. Un parcourt en zigzag

de la matrice obtenue permet de créer un vecteur unidimensionnel avec

pour premier élément le coefficient DC, sorte de coefficient de

référence au bloc, et ensuite les AC dont la fréquence

augmente vers la droite et vers le bas.

La quantification permet, en arrondissant d'obtenir des suites

de zéros. Ces zéros sont des éléments qui ne

pourront plus être reconvertis par transformation inverses. En effet, la

DCT est réversible et sans pertes, mais la réduction par exemple

de 0.015 à 0 engendre une perte d'information. La qualité sera

donc altérée. Le pas de quantification, c'est-à-dire la

valeur par laquelle les coefficients DCT sont divisés définit la

perte de qualité : plus il est grand, plus important est le nombre de

valeurs réduites à zéros et donc plus importante est la

perte d'informations. Ainsi sur un bloc très détaillé (un

oeil par exemple) le pas sera petit, alors que sur une zone moins

précise (un petit coin de ciel bleu) le pas sera plus grand.

Pour le moment, des techniques de codage ont été

utilisées, mais aucune n'ont assuré la compression des

données. Notre vecteur unidimensionnel obtenu est soumis à un

codage en run-length permettant de coder une chaîne de nombres identiques

en indiquant la valeur du nombre répété et son

occurrence.

b - La norme MPEG

-2

MPEG2 a été définie partiellement en 1994

et regroupe neuf recommandations dont certaines ont été

définies plus tard. Cette norme a une compatibilité ascendante

avec MPEG1 et permet donc de lire des flux MPEG1. Elle a été

créée afin de répondre aux limitations de MPEG1 dont la

qualité était insuffisante pour certains types d'applications.

Ø Les formats d'entrée

SIF (Source Input Format) est un format de vidéo

numérique. Il décrit la résolution spatiale et le format

d'échantillonnage des couleurs. Deux formats ont été

définis, les formats SIF NTSC et SIF PAL/SECAM.

Ces formats sont utilisés comme format d'entrée

pour le MPEG1. Nous remarquons que les composantes de chrominance sont sous

échantillonnées par rapport à la composante luminance et

nous en avons déjà expliqué les raisons.

MPEG-2 permet d'utiliser comme format de couleurs en

entrée 4:4:4, 4:2:2 et 4:1:1 en plus du 4:2:0 du MPEG1. De plus

l'utilisation des formats CIF et QCIF est possible.

Ø Les améliorations du codage

Quelques subtilités ont été

ajoutées au codage MPEG2. Elles permettent généralement

une plus grande précision au niveau du codage :

Taille des macros blocs de 16×8 et 16×16 pixels au

lieu de 16×16 uniquement La précision des vecteurs de mouvement

passe de un à un demi pixel.

Des algorithmes de codage ont été

également optimisés pour pouvoir améliorer la compression

:

Table de Huffman améliorées Balayage alternatif

des pixels des blocs pour le codage.

D'autres améliorations ont également

été apportées mais l'aspect le plus important du MPEG2

sont les notions de profiles et de codage hiérarchique.

c -La norme MPEG -

4

Les objets visuels codés peuvent être naturels ou

synthétiques, en 2D ou en 3D, fixes ou mobiles. Un objet peut être

un personnage se déplaçant, un objet fixe déplacé

à un moment donné, Ces objets peuvent être eux-mêmes

composés d'autres objets (les membres de la personne, sa tête,...)

et ainsi former une structure hiérarchique en arbre. MPEG4 fournit ainsi

des outils permettant le codage et la manipulation des objets visuels.

La compatibilité avec MPEG 1 & 2 est assurée

par l'acceptation au niveau du codage de l'utilisation des images comme

unité de codage ; c'est à dire que le flux vidéo peut

être codé (et donc décodé) soit selon la

méthode MPEG 1 ou 2 (gestion d'image rectangulaire, compensation de

mouvement...) ou utiliser la notion d'objets, donc de formes remarquables au

sein de l'image (contour d'un personnage, d'un objet,...). MPEG4 apporte au

codage vidéo des normes de génération

précédente, des outils permettant d'améliorer

l'efficacité du codage. Ces outils dépendent du style d'objet

à coder et permettent d'améliorer, dans un flux MPEG4,

l'efficacité du codage et du décodage ; un flux MPEG2 sera

décodé comme un flux MPEG2 standard.

-La compression du signal vidéo

Mais comme le poids des images numérisées est

trop important, il est nécessaire de les compresser et de ne faire

voyager que les codes qui ont changés. Comme le signal a

été découpé en une série de codes, il est

possible d'envoyer uniquement ceux qui ont changé par rapport à

l'image précédente. Pas besoin d'encombrer les ondes avec des

choses que l'on a déjà. Bilan : on gagne de la place et on va

l'occuper avec de nouveaux programmes.

|