PARTIE 2

Utilisation de la régression

PLS sur des cas limites

Nous allons tout d'abord nous attaquer au cas le plus simple,

c'est-à-dire celui de l'application de la régression PLS

univariée sur un modèle à une variable explicative.

I. Régression PLS avec une seule variable

explicative

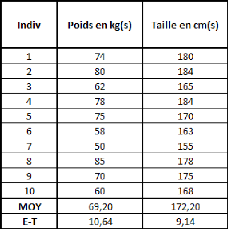

Prenons un tableau de données simples et fictives, avec

deux variables : le poids et la taille. On essaye d'expliquer le poids en

fonction de la taille.

La covariance entre ces deux variables est de 87,36, le

coefficient de corrélation (R) est de 89,84%, et le coefficient de

détermination (R2) est de 80,71%.

Comme il n'y a qu'une seule variable explicative (la taille), la

régression PLS ne comportera pas plus d'une étape.

Si on effectue une régression PLS sur les variables

centrées-réduites (pour chaque donnée de la série,

on retranche la moyenne de la série, et on divise la différence

par l'écart-type de la série), cela nous donne la relation

suivante :

Poidscr = 0,898*Taillecr

Où Poidscr et Taillecr sont respectivement les

séries des données des séries Poids et Taille

centrées-réduites.

Sur les données non-centrées et

non-réduites, avec l'intégration d'une constante, la relation est

la suivante :

Poids = 1,045*Taille -- 110,831

Dans un cas comme dans l'autre, le coefficient de

détermination (R2) de la régression vaut

approximativement 0,81.

Voyons donc comment utiliser ce modèle. Prenons une taille

au hasard : 180 cm.

Le modèle avec variables non-centrées et

non-réduites s'applique directement. Le poids de cet individu de 180cm

devrait donc être de 1,045*180 -- 110,831 = 77,27 kg approximativement.

Bien entendu, il s'agit de la valeur extrapolée par le modèle,

qui est théorique. Il y a une marge d'erreur, mais le fait que le

coefficient de corrélation soit assez élevé (81%) laisse

présager d'une assez bonne capacité à prédire du

modèle.

Concernant le modèle « centré-réduit

», il faut d'abord centrer et réduire les la valeur « 180cm

» en utilisant la moyenne et l'écart type calculés sur la

série « Taille » (même si cette série ne comprend

pas cette valeur) : (180-172,2)/9,14 = 0,8534...

Pour cette valeur, la variable « Poidscr » prend

donc la valeur 0,898*0,8534, soit 0,7664... Pour obtenir le Poids non

centré et non réduit, il faut multiplier cette valeur par

l'écart-type de la série Poids et y ajouter la moyenne de la

série : 0,7664*10,64 + 69,2 = 77,35 kg. Naturellement, ce « 77,35

kg » calculé à l'aide de ce modèle devrait être

égal à la valeur calculée par le modèle

précédent. La différence s'explique par des erreurs

d'arrondis. Il aurait fallu prendre davantage de décimales en compte

pour arriver au même résultat.

Ces deux modèles donnent donc exactement les

mêmes résultats. Le premier permet simplement un calcul plus

direct, plus rapide et plus simple, de même qu'une interprétation

plus rapide.

Si on s'attarde sur le coefficient de détermination de

la régression (0,81), on s'aperçoit qu'il est strictement

égal au coefficient de détermination entre les deux variables

(Poids et Taille). Cela veut dire que la régression prend en compte de

manière optimale la corrélation entre les deux variables. Hors,

c'est également le cas lorsqu'on effectue une régression

linéaire simple, où le R2 de la régression est

égal au R2 entre la variable explicative et la variable

expliquée (lorsque les variables sont centrées ou qu'une

constante a été intégrée). Hors, il ne peut pas

exister deux résultats différents (deux séries de

coefficients différents), pour une régression de ce type, qui

aboutiraient au meilleur coefficient de détermination possible pour

cette analyse. Donc, cela veut nécessairement dire que les coefficients

trouvés sont les mêmes que les coefficients qui auraient

été trouvés dans le cadre d'une régression

linéaire simple.

En effet, si on effectue une régression linéaire

simple, c'est-à-dire si on cherche à calculer les coefficients

« a » et « b » par régression linéaire simple

sur un modèle du type Poids = a*Taille + b, on obtient les

résultats suivants :

,

36

87

a Cov(Poids, aille ) Var(

aille)

1,0455

83,56

37

Y ax b b Y ax 69,2 --1,0455 *172, 2 b 110 ,

8351

On a donc finalement le modèle suivant : Poids =

1,0455*Taille -- 110,8351

On constate donc, à quelques décimales près

là encore, que les modèles sont identiques.

Si on fait la régression linéaire simple sans

constante, mais avec variables centrées - réduites, on obtient

les mêmes résultats que pour la régression PLS à une

composante sur variables centrées-réduites. Nous ne

détaillerons pas les calculs mais le résultat donné par

Eviews 5.0 pour une telle régression (régression linéaire

simple sur variables centrées-réduites) est le suivant : Poidscr

= 0,898394*Taillecr.

Dans les deux cas, les modèles donnent les mêmes

résultats.

Il faut néanmoins se garder d'affirmer qu'une

régression PLS et une régression linéaire donnent

forcément les mêmes résultats. Néanmoins, on

constate ici qu'une régression linéaire simple (avec centrage des

données ou constante), et qu'une régression PLS à une

étape pour une seule variable explicative (avec centrage des

données ou constante), donnent les mêmes résultats. Comme

il n'y a qu'une seule étape possible lorsqu'il n'y a qu'une seule

variable, nous pouvons dire que régression PLS1 pour une seule variable

explicative et régression linéaire simple (ou régression

linéaire multiple à une seule variable explicative) donnent les

mêmes résultats et s'équivalent donc en tout points (si ce

n'est pas la différence d'approche pour ce qui en est des calculs).

Nous allons essayer de voir sous quelles conditions une

régression PLS (à plus d'une variable explicative) et une

régression linéaire multiple peuvent donner les mêmes

résultats.

|