1.6.3 Modèles à comparaison dynamique

La méthode DTW (Dynamic Time Warping) est une

méthode de résolution dynamique. Elle est basée sur le

principe de recalage temporel. Les images acoustiques des unités sources

et celles des unités à reconnaître ne sont pas parfaitement

identiques

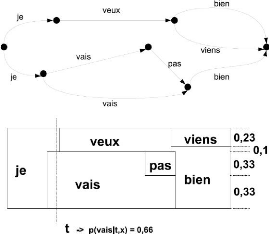

FIGURE 1.4 - Exemple de graphe de décodage

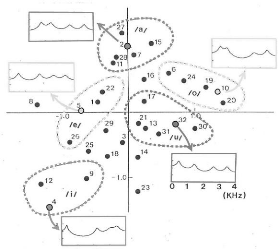

FIGURE 1.5 - Exemple de classification phonétique

à cause de la différence dans les vitesses de

locution. Ce principe est pratiquement le même que celui utilisé

dans la reconnaissance des formes et il a largement été

utilisé pour le recalage des images médicales. Le modèle

utilise une mesure de différence entre les vecteurs sources et ceux du

mot à identifier pour tenter de trouver des correspondances

optimales.

L'algorithme commence par l'estimation locale des distances

entre les deux ensembles de vecteurs. Il utilise ensuite une méthode de

programmation dynamique pour obtenir un optimum global qui minimise la

différence accumulée entre les deux ensembles.

Dans ce type de modèles, on représente chaque

couple d'unités phonétiques dans une matrice dont les lignes

représente les vecteurs de l'unité de référence, et

les colonnes ceux de l'unité à reconnaître. Les

éléments de la matrice représentent les différences

locales entres les vecteurs. Le problème revient donc à trouver

un chemin optimal (minimal) entre le premier et le dernier

élément de la matrice.

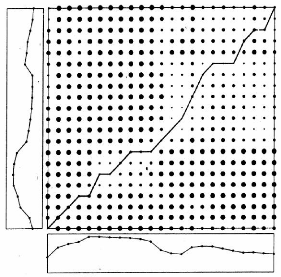

FIGURE 1.6 - Chemin optimal par DTW

1.6.4 Autres modèles

La quantification vectorielle est une méthode

non-paramétrique qui permet de décrire un ensemble de

données par un faible nombre de vecteurs formant un dictionnaire

associé aux données. Le dictionnaire est en général

calculé de telle façon que la distance moyenne entre un vecteur

issu des données et son plus proche voisin dans le dictionnaire soit la

plus petite possible. La quantification vectorielle est une technique de

groupage qui est d'autant plus adaptée que les données

présentent naturellement des "points d'accumulation" autour desquels la

densité de vecteurs issus des données est importante. Compte tenu

de la nature du signal de parole, le choix d'un tel modèle

semble assez judicieux. En general, la quantification

vectorielle est realisee par une methode dite "spliting K-means" (optimisations

successives de dictionnaires de taille croissante) qui permet de contourner le

delicat problème de l'initialisation de l'algorithme de recherche

iterative des vecteurs du dictionnaire.

Le modèle de melange de distributions gaussiennes

(Gaussian mixture model (GMM)) consiste à supposer que la distribution

des donnees peut être decrite comme une somme ponderee de densites

gaussiennes multidimensionnelles. Ce modèle de melange est classique

dans le domaine de la reconnaissance de forme car il correspond à une

situation où les donnees appartiennent à un ensemble de classes

distinctes, avec une probabilite d'appartenance propre à chaque classe.

Le cas particulier considere ici est celui où dans chaque classe les

donnees suivent une loi gaussienne. Ce choix tient essentiellement au fait que

la loi gaussienne appartient à une famille de distributions dite

exponentielles pour lesquelles le problème de l'identification des

composantes du melange se trouve simplifie. Pour le signal de parole, ce

modèle ne paraît donc pas deraisonnable et il est d'autre part

assez proche de la caracterisation fournie par la quantification vectorielle.

La difference etant qu'avec la quantification vectorielle, on se contente de

mettre en evidence un certain nombre de "points d'accumulation" des

paramètres mesures, alors qu'avec le modèle de melange de

distributions gaussiennes, on cherche en plus à decrire la distribution

des paramètres mesures autours de ces points d'accumulation.

|