PARTIE III : DESCRIPTION DE LA

TRADUCTION

AUTOMATIQUE NEURONALE

Nous décrirons ici la traduction automatique

neuronale, qui est l'approche que nous avons retenue pour le traitement de

notre cas d'étude.

Master Data Science - Big Data 13

I- LA TRADUCTION AUTOMATIQUE NEURONALE

La traduction automatique neuronale ou Neural Machine

Translation (NMT) est une approche basée sur les réseaux de

neurones artificiels. Cette approche utilise une architecture appelée

sequence-to-sequence composée deux réseaux neurones

récurrents. [22]

1- Réseau de neurones artificiels

Ensemble de neurones formels (artificiels)

interconnectés permettant de construire un modèle d'apprentissage

automatique à partir d'exemples (données). Il est aussi

défini comme une modélisation mathématique du cerveau

humain.

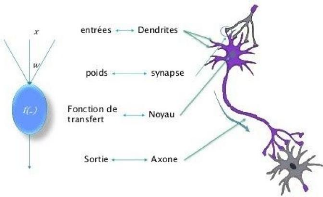

a- Définition du neurone formel

Un neurone formel appelé aussi neurone artificiel est

une représentation artificielle d'un neurone biologique

De façon très réductrice, un neurone

biologique est une cellule qui se caractérise par

l Des synapses, les points de connexion avec les autres

neurones, fibres nerveuses ou musculaires ;

l Des dendrites ou entrées du neurone ;

l Les axones, ou sorties du neurone vers d'autres neurones ou

fibres musculaires ;

l Le noyau qui active les sorties en fonction des

stimulations en entrée.

Par analogie, Un neurone formel est une représentation

artificielle et schématique d'un neurone biologique :

l Les dendrites traduites par les entrées du neurone;

l Les synapses sont modélisées par des poids;

l Le soma ou corps cellulaire est modélisé par

la fonction de transfert, appelé aussi fonction d'activation;

l L'axone : l'équivalent de la sortie du neurone

artificiel.

Master Data Science - Big Data 14

Figure 5 : Mise en correspondance neurone biologique /

neurone artificiel

b- Formulation mathématique du neurone

formel

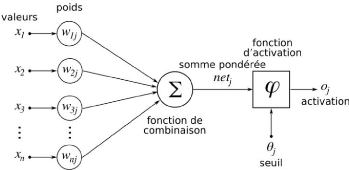

Un neurone formel, au même titre qu'un neurone

biologique, reçoit plusieurs stimuli (xi) d'importances

différentes (les stimuli les plus importants sont munis de poids Wij

plus élevés), les analyse et fournit en sortie un

résultat.

Figure 6 - Structure d'un neurone artificiel j

Description de la structure du neurone artificiel :

l Chaque poids possède une valeur notée . Cette

notation désigne le poids

allant d'un neurone formel i au

neurone formel j ;

l Chaque poids transmet une information/un stimulus provenant

du neurone source i noté ;

Master Data Science - Big Data 15

l Ce stimulus (sa valeur) correspondant à

l'information envoyé par le neurone source i est modulé

par le poids liant les neurones i etj. Mathématiquement cela se traduit

par :

l Ainsi le neurone j reçoit autant de stimuli

que de poids, dont il fait la somme

Si l'on note n le nombre de stimuli en entrée

du neurone j, une notation mathématique plus complète serait :

Cette expression se lit alors comme : la somme de toutes les

multiplications des valeurs des n entrées par les poids

associant ces entrées au neurone j considéré (

i prenant les valeurs : 0, 1, 2, ..., n)

C'est cette somme que le neurone formel j doit alors

traiter. Il utilise pour cela la fonction de transfert.

La fonction d'activation : Biologiquement, l'idée

d'une fonction d'activation vient de

l'idée de mimer le fonctionnement d'un potentiel

d'action d'un neurone biologique : si

l'ensemble des stimuli en entrée d'un neurone

atteignent le seuil d'excitabilité, alors ce neurone fournit une sortie

(il décharge).

Il existe un grand nombre de fonctions d'activation, telles que

:

l Sigmoïde : produit une courbe en forme de S. Bien que

de nature non linéaire, il ne tient toutefois pas compte des

légères variations des entrées, ce qui entraîne des

résultats similaires;

l Fonctions de tangente hyperbolique (tanh): Il s'agit d'une

fonction supérieure comparée à Sigmoïde. Cependant,

elle rend moins bien compte des relations et elle est plus lente à

converger;

l Unité linéaire rectifiée (ReLu): Cette

fonction converge plus rapidement, optimise et produit la valeur

souhaitée plus rapidement. C'est de loin la fonction d'activation la

plus populaire utilisée dans les couches cachées;

l Softmax: utilisé dans la couche de sortie car elle

réduit les dimensions et peut représenter une distribution

catégorique.

Master Data Science - Big Data 16

|